“Un recueil de pensées doit être une pharmacie où se trouve le remède à tous les maux.” – Voltaire

“Les personnes qui sont cognitivement occupées sont plus susceptibles de prendre des décisions égoïstes, d’utiliser un langage sexiste et de porter des jugements superficiels dans des situations sociales. La mémorisation et la répétition des chiffres réduisent le contrôle du système 2 sur le comportement, mais la charge cognitive n’est pas la seule cause d’une maîtrise de soi affaiblie.” Daniel Kahneman

“Nous piétinerons éternellement aux frontières de l'Inconnu, cherchant à comprendre ce qui restera toujours incompréhensible. Et c'est précisément cela qui fait des nous des hommes.” Isaac Asimov

Des chercheurs italiens * ont nommé ce niveau de pensée « système 0 », en référence aux modes de pensée du psychologue Daniel Kahneman. L'arrivée de l'intelligence artificielle impliquerait des changements bien plus profonds qu'anticipés, au point de changer la manière de penser des humains

Extrait de l'article

Extrait de l'article

"Depuis l'essor des grands modèles linguistiques, les grandes entreprises technologiques ont lancé des produits visant à fournir des systèmes intelligents personnalisés qui externalisent diverses tâches cognitives quotidiennes. Ces systèmes sont conçus pour réécrire et relire des textes, créer des images originales, rechercher dans le temps un contenu spécifique et offrir une assistance personnalisée. L'intégration rapide de ces outils d'intelligence artificielle (IA) dans notre vie quotidienne remodèle notre façon de penser et de prendre des décisions. Nous proposons que les systèmes d'IA pilotés par les données, en transcendant les artefacts individuels et en s'interfaçant avec un écosystème dynamique à artefacts multiples, constituent un système psychologique distinct. Nous appelons cela le « système 0 » et le positionnons aux côtés du système 1 de Kahneman (pensée rapide et intuitive) et du système 2 (pensée lente et analytique). Le système 0 représente l'externalisation de certaines tâches cognitives à l'IA, qui peut traiter de vastes quantités de données et effectuer des calculs complexes au-delà des capacités humaines. Il émerge de l'interaction entre les utilisateurs et les systèmes d'IA, ce qui crée une interface dynamique et personnalisée entre les humains et l'information. Le terme système 0 est choisi délibérément pour souligner son rôle fondamental et omniprésent dans la cognition moderne. Contrairement au système 1 et au système 2 (qui fonctionnent dans l'esprit individuel), le système 0 forme une couche sous-jacente artificielle et non biologique d'intelligence distribuée qui interagit avec les processus de pensée intuitifs et analytiques et les augmente. Cette désignation souligne sa fonction de préprocesseur et d'amplificateur d'informations, qui façonne activement les entrées des systèmes cognitifs traditionnels plutôt que de simplement les étendre. Nous soutenons que le système 0 peut être considéré comme une extension de l'esprit humain, en nous appuyant sur l'hypothèse de l'esprit étendu de Clark et Chalmers. En particulier, le système 0 répond à tous les critères d'extension cognitive de Heersmink avec différents niveaux de satisfaction (tableau ) : flux d'informations, fiabilité, durabilité, confiance, transparence procédurale, transparence informationnelle, individualisation et transformation. Heersmink soutient que des scores plus élevés dans ces dimensions indiquent une plus grande intégration fonctionnelle et un couplage utilisateur-système plus étroit."

"Pour naviguer dans ce paysage cognitif complexe, nous proposons les recommandations suivantes :

Développer des cadres pour évaluer la fiabilité, la transparence et les biais potentiels des systèmes d'IA qui composent le système 0 ;

Établir des lignes directrices pour l'utilisation responsable et éthique de l'IA dans les processus décisionnels ;

Promouvoir la littératie numérique et les compétences de pensée critique pour aider les individus à naviguer dans les environnements d'information médiatisés par l'IA ;

Encourager la recherche interdisciplinaire sur les aspects cognitifs,les effets psychologiques et sociaux de l’intégration homme-IA

Favoriser le dialogue public sur les implications éthiques de la cognition augmentée par l’IA et ses effets potentiels sur l’autonomie humaine et la prise de décision."

*Chiriatti, M., Ganapini, M., Panai, E. et al. The case for human–AI interaction as system 0 thinking. Nat Hum Behav 8, 1829–1830 (2024). https://doi.org/10.1038/s41562-024-01995-5

Daniel Kahneman a obtenu ce prix Nobel d'économie en 2002 pour avoir démontré que nos décisions sont le fruit de deux modes de pensées : un mode de pensée lent, logique, coûteux en efforts, et un mode de pensée rapide, intuitif, automatique, qui ne demande aucun effort, et qui fonctionne avec d'autres règles que la logique.

L’intelligence artificielle pourrait interférer avec la pensée humaine

Toutefois, les chercheurs soulignent le risque de devenir dépendants du système 0. « Le risque est de trop se fier au système 0 sans exercer son esprit critique. Si nous acceptons passivement les solutions proposées par l'IA, nous risquons de perdre notre capacité à penser de manière autonome et à développer des idées innovantes. Dans un monde de plus en plus automatisé, il est crucial que les humains continuent à questionner et à remettre en question les résultats générés par l'IA », ont indiqué les chercheurs."

https://www.futura-sciences.com/tech/actualites/technologie-ia-prend-elle-controle-nos-pensees-chercheurs-alertent-systeme-0-met-place-116968/

" Pour exploiter le potentiel du Système 0, les auteurs de l’étude (Chiriatti et Coll) suggèrent qu’il est urgent d’élaborer des lignes directrices éthiques et responsables pour son utilisation. « La transparence, la responsabilité et la maîtrise du numérique sont des éléments clés pour permettre aux gens d’interagir de manière critique avec l’IA », préviennent-ils. « Éduquer le public sur la façon de naviguer dans ce nouvel environnement cognitif sera crucial pour éviter les risques d’une dépendance excessive à ces systèmes. »

L'avenir de la pensée humaine

Ils concluent : si rien n'est fait, le Système 0 pourrait interférer avec la pensée humaine à l'avenir. « Il est essentiel que nous restions conscients et critiques dans la façon dont nous l'utilisons ; le véritable potentiel du Système 0 dépendra de notre capacité à le guider dans la bonne direction. »

https://www.miragenews.com/ai-sparks-new-external-thought-process-1341912/#google_vignette

Systéme 0 By PERPEPLIXITY AI

Intelligence artificielle sytéme 0

Définition et fonctionnement

- Le Système 1 : pensée intuitive, rapide et automatique

- Le Système 2 : réflexion plus analytique et délibérée

Daniel Kahneman

Avantages et potentiels

Le Système 0 offre plusieurs avantages :- Il peut enrichir nos capacités cognitives en servant de "circuit externe" à notre esprit

- Il permet de traiter des quantités massives de données rapidement

- Il peut générer des idées et solutions nouvelles grâce à ses capacités d'analyse

Risques et précautions

Cependant, l'utilisation du Système 0 comporte aussi des risques :- Une dépendance excessive pourrait réduire notre capacité à penser de manière autonome

- Il y a un risque d'accepter passivement les solutions proposées par l'IA sans esprit critique

- Une interférence potentielle avec la pensée humaine si le système n'est pas bien régulé

- Développer des directives éthiques pour son utilisation

- Promouvoir la transparence et la responsabilité dans le développement de ces systèmes

- Éduquer le public sur l'interaction critique avec l'IA

- Rester vigilant et exercer un jugement humain sur les résultats générés par l'IA

Commentaire

IA et système O : l'IA devient-elle indépendante, voire autonome ?

Il est essentiel de tout faire pour ne pas arriver à cette extrémité, et donc l'humain doit rester le "maître" et rester vigilant. Mais comme le disait Isaac Asimov : “Les choses changent. Mais si vite... Est-ce que les habitudes des hommes pourront suivre ?”

Rappelons les 3 LOIS d'Issac Asimov

Dans chacun de ces livres sont évoquées les Trois lois de la robotique :

- Première Loi : « Un robot ne peut porter atteinte à un être humain ni, restant passif, laisser cet être humain exposé au danger. »

- Deuxième Loi : « Un robot doit obéir aux ordres donnés par les êtres humains, sauf si de tels ordres sont en contradiction avec la Première Loi. »

- Troisième Loi : « Un robot doit protéger son existence dans la mesure où cette protection n'entre pas en contradiction avec la Première ou la Deuxième Loi. »

Des lois qui ont anticipé le système 0 de l'IA ? Peut-être !

L'éthique doit être rigoureuse en matière d'IA

“Les auteurs de science-fiction prévoient l'inévitable, et bien que les problèmes et les catastrophes puissent être inévitables, les solutions, elles, ne le sont pas. ” Issac Asimov

En matière d'IA , qui fait encore peur en 2024, as t-on tous les outils de protection ? Il faut les avoir. L'IA cristallise les discussions entre les "pour" et les "contre". Le système O si il évolue doit attirer l'attention et ne pas le négliger.

« toutes ces technologies ont pour but de nous assister dans des tâches ponctuelles, souvent répétitives et fortement codifiées. Elles nous fournissent une aide qui vient amplifier notre humanité, et augmenter nos capacités intellectuelles, mais elles ne peuvent en aucun cas nous remplacer » Luc Julia , inventeur de SIRI

Rappelez vous

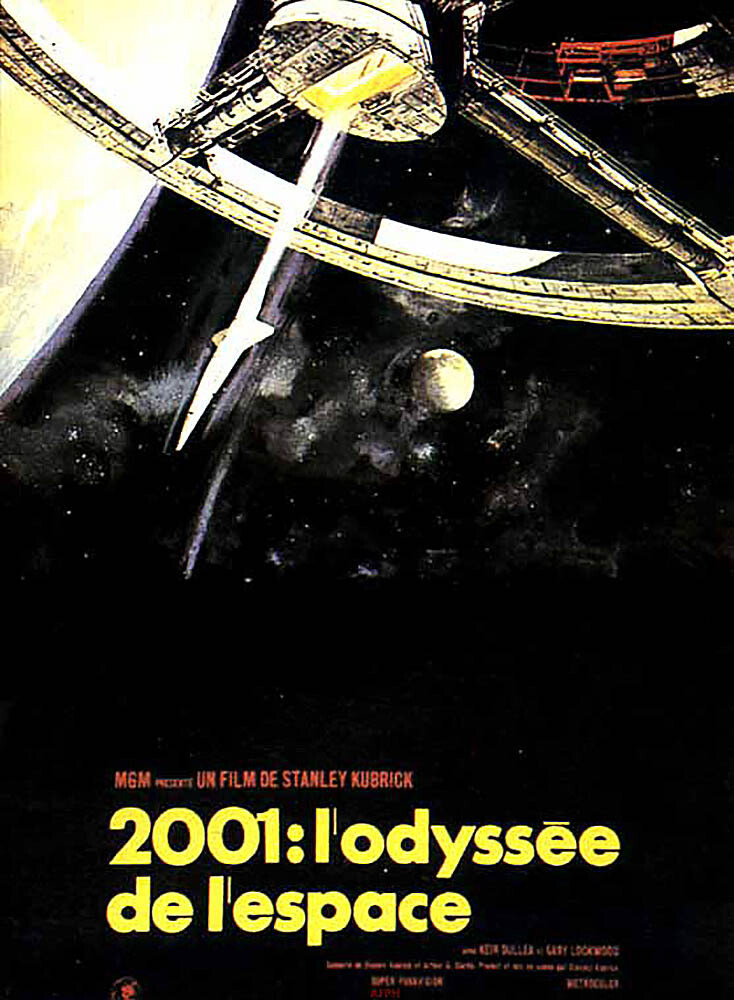

Le film retrace, à travers différentes époques de l'histoire humaine, le rôle joué dans l'évolution de l'humanité par une intelligence inconnue. Il s'ouvre sur le générique avec le poème symphonique Ainsi parlait Zarathoustra de Richard Strauss, puis arrive un écran noir de quelques minutes, sur fond d’Atmosphères (en), une œuvre pour orchestre de György Ligeti.

Le film est divisé en quatre actes distincts : dans le premier acte, qui se déroule « à l'aube de l'humanité », on suit des hominidés bipèdes qui découvrent l'usage de l'outil et de l'arme après avoir touché un monolithe noir mystérieux. Dans le second acte, qui se déroule en 2001, on suit le docteur Heywood R. Floyd lors de son voyage sur la Lune après qu'un monolithe identique y a été découvert. Dans le troisième acte, deux astronautes, le Dr David Bowman et le Dr Frank Poole entreprennent un voyage vers la planète Jupiter à bord du vaisseau spatial Discovery One, à la suite du signal radio émis par le monolithe de la Lune vers Jupiter. Dans l'acte final, on suit le périple de l'astronaute David Bowman « au-delà de l'infini ».

Au cours du voyage vers Jupiter, l'ordinateur de bord HAL 9000, une machine douée de conscience qui commande toutes les fonctions du vaisseau Discovery One, se révèle être l'un des protagonistes centraux du film...LE SYSTEME 0 ?

https://fr.wikipedia.org/wiki/2001,_l%27Odyss%C3%A9e_de_l%27espace

Je suis plutôt réaliste et pragmatique, cette face O de l'IA ne doit pas être menaçante....mais peux t-on faire confiance aux humains en 2024 ?

Pour l'instant OUI, les dernières règles européennes sur l'IA dressent des protections........restons confiant car l'IA a tellement a nous apporter !

A LIRE

AI Act : le Règlement sur l'intelligence artificielle de l'UE

L'AI Act, ou Artificial Intelligence Act, est une réglementation conçue pour encadrer et promouvoir le développement ainsi que la mise sur le marché des systèmes d'intelligence artificielle au sein de l'Union européenne.

Lancé par la Commission européenne en avril 2021, l'IA Act est rentré en vigueur le 12 juillet 2024, après trois années de négociation

"Pourquoi la régulation de l'intelligence artificielle est-elle nécessaire ?

Le règlement sur l'IA vise à instaurer la confiance des citoyens européens dans les technologies de l'Intelligence artificielle. Bien que la plupart des systèmes d'IA présentent peu de risques et contribuent à résoudre divers défis sociétaux, certains d'entre eux posent des risques qu'il est important d'éviter.

Bien que les lois existantes comme le RGPD offrent une certaine protection, elles ne sont pas suffisantes pour souligner les risques que l'IA peut présenter. C'est pourquoi des règles ont été proposées pour :

- Cibler les risques spécifiques associés à l'IA

- Interdire les pratiques d'IA présentant des risques inacceptables

- Définir des critères clairs pour les systèmes d'IA utilisés dans ces applications

- Imposer des obligations spécifiques aux utilisateurs et fournisseurs de ces applications

- Exiger une évaluation de la conformité avant la mise en service ou la commercialisation d'un système d'IA

- Surveiller l'application des règles après la commercialisation d'un système d'IA

- Mettre en place une structure de gouvernance aux niveaux européen et national.

Intelligence artificielle : de quoi parle-t-on ?

- Par Benoît Georges

Pages 5 à 10

https://shs.cairn.info/revue-constructif-2019-3-page-5?lang=fr

Pages 593 à 598

https://shs.cairn.info/revue-recherches-de-science-religieuse-2023-4-page-593?lang=fr

Les mots de la fin empruntés à Yuval Noah Harai sans son dernier ouvrage au demeurant excellent

" Nous avons maintenant évoqué une intelligence autre, non organique, qui pourrait bien échapper à notre contrôle et mettre en danger non seulement notre espèce mais une multitude d'autres formes de vie. Les choix que nous ferons tous au cours des années à venir détermineront si le fait d'avoir donné le jour à cette intelligence fut une erreur fatale ou s'il marque le début d'un nouveau chapitre plein d'espoir de l'évolution de la vie"

Copyright : Dr Jean Pierre Laroche / 2024