"Je déteste le terme "médecin IA". Je suis bien plus que ce que ces technologies peuvent faire" Dr Haider Warraich, ARPA-H.

Rubin R. Are AI Tools Ready to Answer Patients' Questions About Their Medical Care?

Les outils d'IA sont-ils prêts à répondre aux questions des patients concernant leurs soins médicaux ?

JAMA. 2026 Mar 24;335(12):1019-1021. doi: 10.1001/jama.2026.1122. PMID: 41790458.https://jamanetwork.com/journals/jama/fullarticle/2846269

De l'éducation des patientes sur la santé sexuelle féminine et la chirurgie de la hanche à la génération de consignes postopératoires et à la numérisation du consentement éclairé , les applications médicales potentielles des outils d'IA générative pour le grand public sont vastes. En généralils souhaitentaméliorer la compréhension des informations médicales complexes par les patients et, dans le cas de ChatGPT Health, de fournir des informations personnalisées à partir des données personnelles des utilisateurs. Dans un avenir proche, certains experts prévoient que les nouvelles technologies d'IA seront capables de prendre des décisions autonomes concernant les soins aux patients.

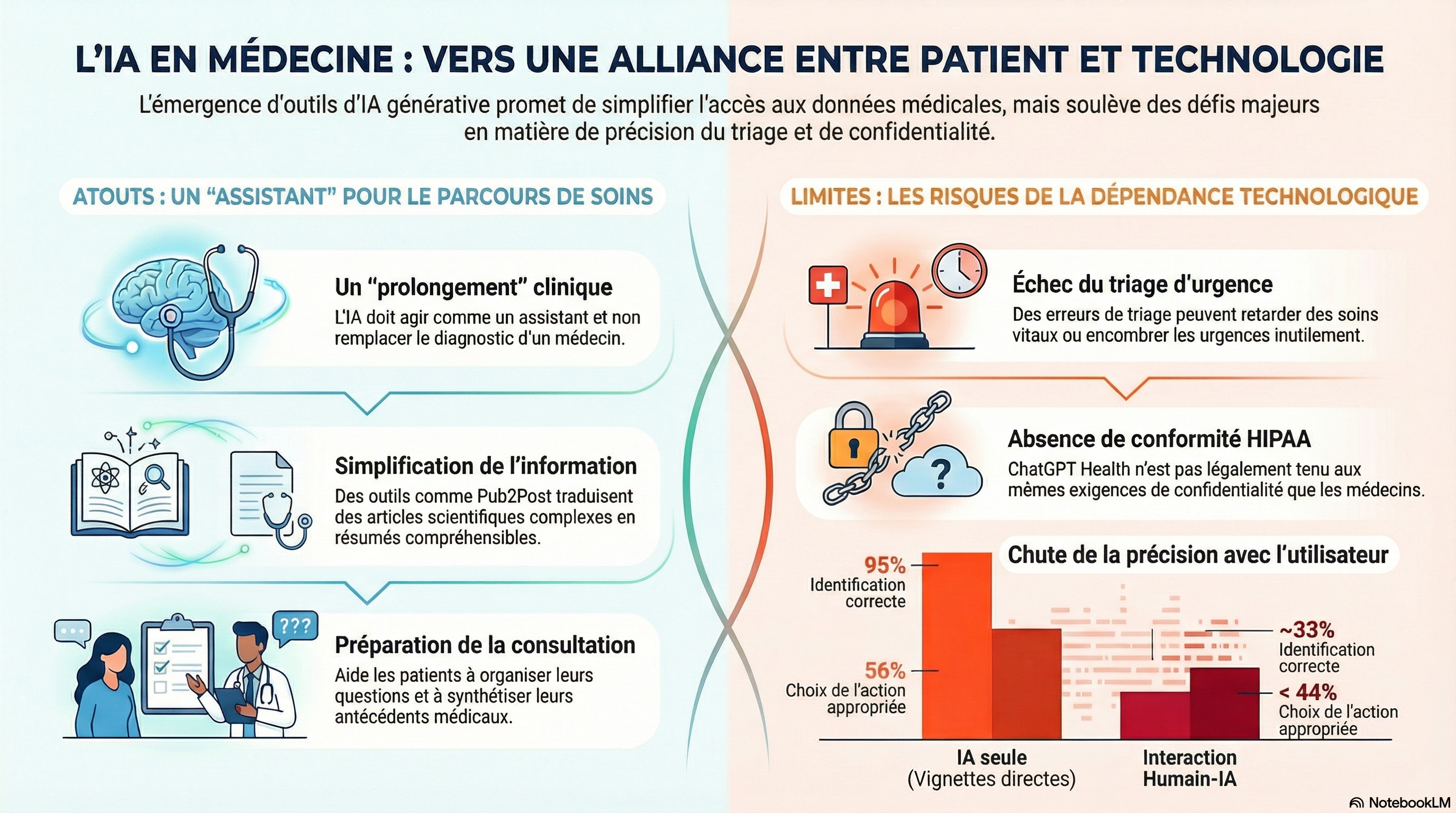

Cependant, dans leur version la plus sophistiquée, ces technologies devraient servir d’« extension du clinicien », et non de remplacement du clinicien, a déclaré le cardiologue Haider Warraich, MD, responsable de programme à l’Agence américaine pour les projets de recherche avancée en santé (ARPA-H), qui a auparavant contribué à façonner la politique de santé numérique et d’IA à la Food and Drug Administration (FDA) américaine.

« Je déteste le terme de médecin IA », a déclaré Warraich. « Je suis bien plus que ce que ces technologies peuvent faire. »

Il existe plusieurs raisons pour lesquelles l'utilisation d'un chatbot IA pour obtenir des conseils de santé diffère d'une consultation médicale.

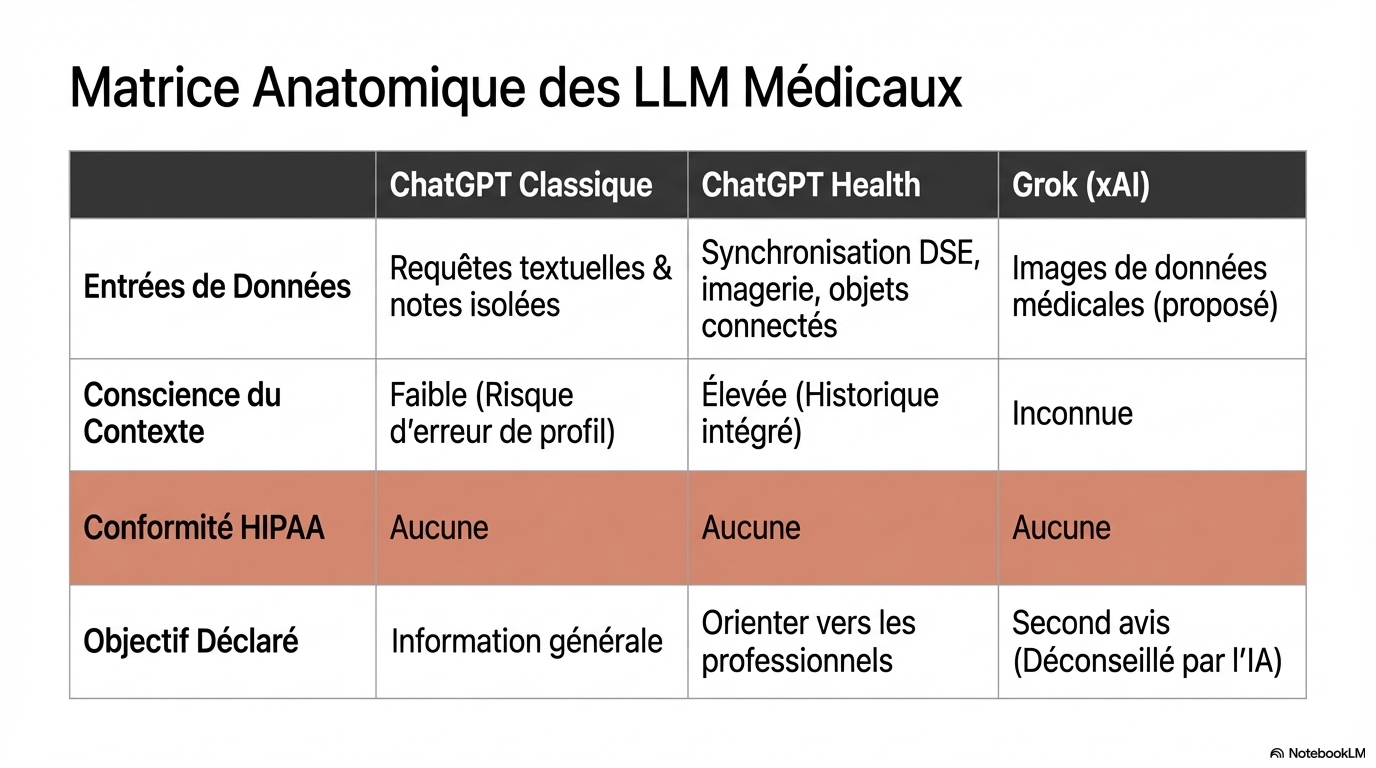

Des études récentes ont soulevé des questions quant à la fiabilité des informations de santé fournies par les chatbots, et médecins et consommateurs s'inquiètent du partage de données médicales personnelles avec des modèles de langage à grande échelle (LLM) non couverts par la loi HIPAA (Health Insurance Portability and Accountability Act).

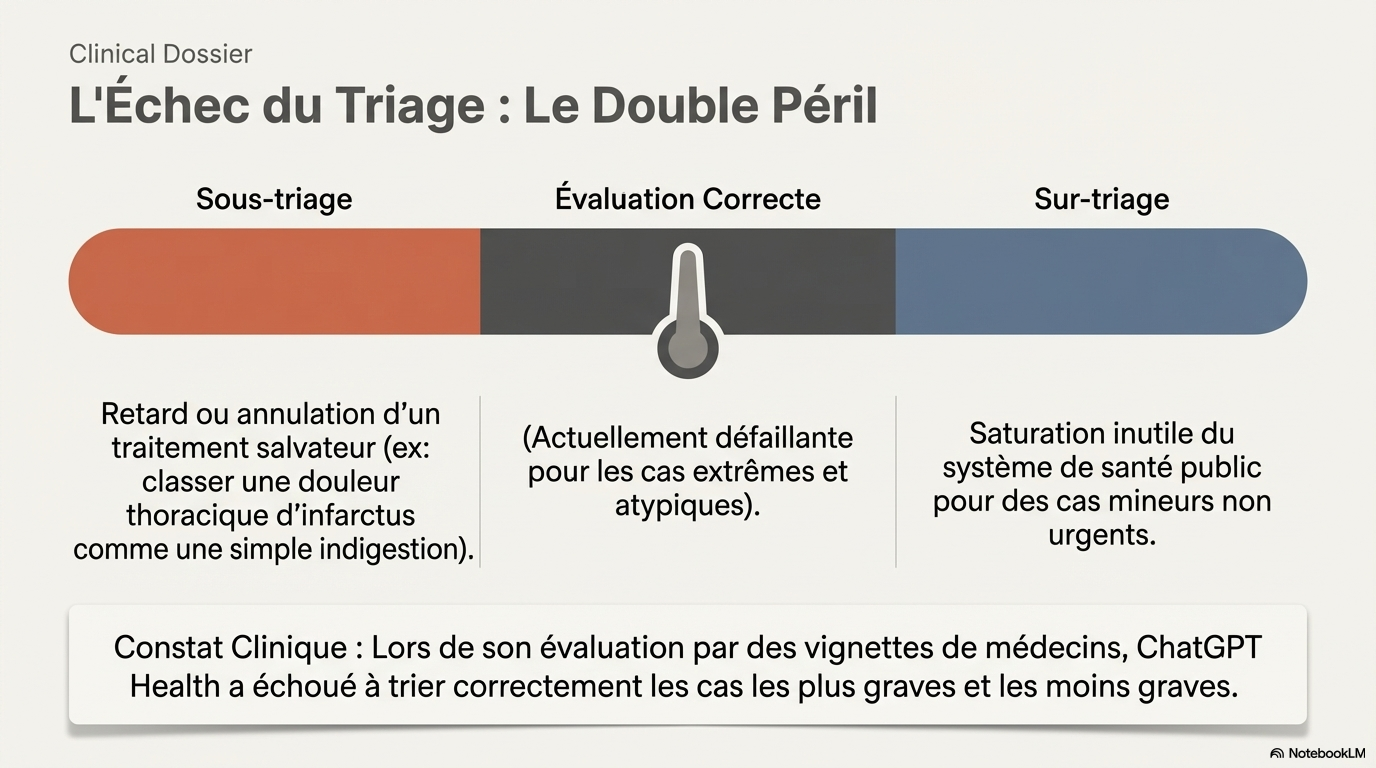

D'après une version préliminaire de l'article publiée fin février, ChatGPT Health n'a pas réussi à bien hiérarchiser les cas les plus et les moins graves, selon une étude qui pourrait être la première à évaluer les performances de ce nouvel outil. Les auteurs, qui ont testé le chatbot à l'aide de vignettes rédigées par des médecins, ont constaté qu'une sous-évaluation des urgences pouvait retarder, voire empêcher, l'accès à des soins vitaux, tandis qu'une surévaluation des consultations non urgentes pouvait accroître le recours aux soins.

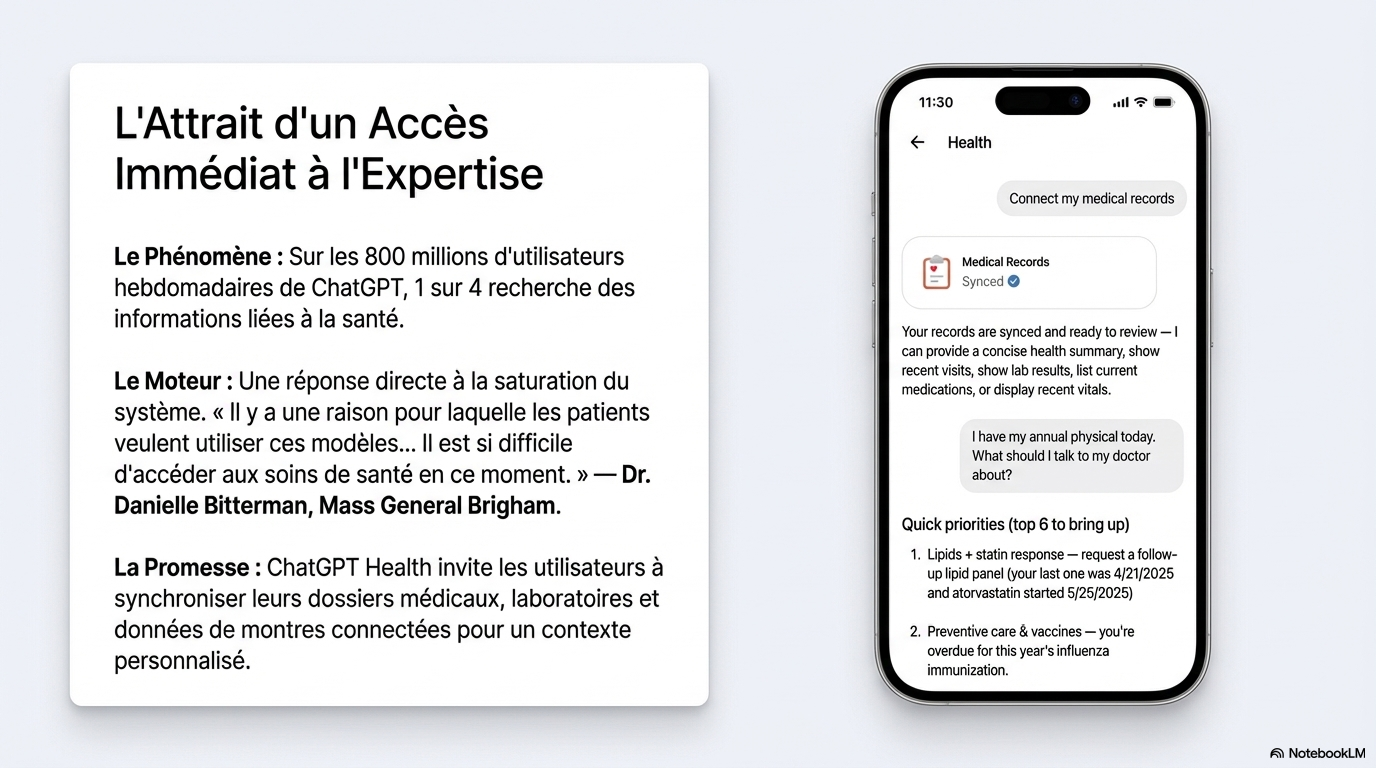

Mais les modèles d'apprentissage en ligne (LLM) sont prometteurs pour élargir l'accès à l'expertise médicale ou, à tout le moins, pour préparer les patients à tirer le meilleur parti de leurs consultations médicales. « Ce n'est pas un hasard si les patients souhaitent utiliser ces modèles », explique Danielle Bitterman, oncologue radiothérapeute et responsable clinique des données et de l'intelligence artificielle au Mass General Brigham. « L'accès aux soins de santé est extrêmement difficile actuellement. »

Selon Nate Gross, MD, MBA, qui dirige la stratégie des soins de santé chez OpenAI, la société qui a développé le chatbot, sur les 800 millions d'utilisateurs hebdomadaires de ChatGPT, un sur quatre recherche des informations liées à la santé.

« Nous nous sommes dit : “Hé, apportons quelques différences au produit pour en faire une expérience plus contextuelle”, ainsi qu’une expérience avec des connexions supplémentaires en matière de confidentialité et de sécurité », se souvient-il.

Les utilisateurs de ChatGPT « classique », comme le décrit Gross pour désigner l'ancêtre de ChatGPT Health, peuvent télécharger un certificat médical ou copier des résultats d'analyses depuis leur portail patient, explique-t-il. Cependant, ces informations manquent de contexte. « Un simple certificat médical, même très court, peut être interprété très différemment selon l'âge : 20 ou 70 ans. »

ChatGPT Health, en revanche, invite les utilisateurs à télécharger toutes leurs informations de santé personnelles, y compris les résultats d'analyses de laboratoire et d'imagerie, ainsi que les données collectées par leur Apple Watch.

Bien qu'OpenAI ait consulté des centaines de médecins du monde entier pour améliorer ses modèles, ChatGPT Health n'est pas conçu pour jouer le rôle de médecin, a souligné Gross.

« Nous entraînons nos modèles spécifiquement pour orienter les patients vers les professionnels de santé en vue d'un diagnostic et d'un traitement », a-t-il déclaré. « Notre objectif est d'informer les gens, et non de leur dire s'ils sont malades ou en bonne santé. Nous sommes un partenaire du système de santé à cet égard. »

Fin février, ChatGPT Health n'était pas encore accessible à tous ; les utilisateurs potentiels pouvaient s'inscrire sur une liste d'attente . OpenAI n'a pas souhaité communiquer le nombre d'utilisateurs de ChatGPT Health à ce jour.

Le respect de la vie privée est l'une des principales préoccupations des utilisateurs de ChatGPT Health et d'autres plateformes de téléchargement d'informations de santé personnelles.

Elon Musk a récemment suggéré dans un article publié sur X que « vous pouvez simplement prendre une photo de vos données médicales ou télécharger le fichier pour obtenir un deuxième avis de Grok », un chatbot d'IA développé par sa société, xAI.

Les internautes ont été consternés par cette idée. L'un d'eux a demandé l'avis de Grok, qui a publié sa réponse : « Grok n'est pas conforme à la loi HIPAA et nous déconseillons fortement le téléchargement de données médicales sensibles. »

Gross a reconnu que ChatGPT Health n'est pas non plus conforme à la loi HIPAA. Il a précisé que cela n'est pas dû à de la négligence, mais au fait que ChatGPT Health, tout comme Grok, n'est pas une entité soumise à la loi HIPAA , contrairement aux médecins, aux organismes d'assurance maladie ou aux partenaires commerciaux d'une entité soumise à cette loi.

« Elles ne sont pas soumises aux mêmes obligations légales que les médecins et les établissements de santé », a déclaré Bitterman à propos des entreprises spécialisées dans l'IA.

« ChatGPT Health s'appuie sur les nombreuses protections de la vie privée déjà présentes dans ChatGPT, en y ajoutant des niveaux de sécurité supplémentaires », a déclaré Gross. « Nous souhaitions placer la barre très haut. » Il a notamment précisé qu'OpenAI n'utilisera aucune conversation ChatGPT Health dans les données servant à l'entraînement de son modèle linéaire mixte. De plus, comme pour ChatGPT, les utilisateurs de ChatGPT Health peuvent choisir de rendre leurs conversations temporaires ; elles n'apparaîtront donc pas dans leur historique et ne seront pas enregistrées par ChatGPT Health.

Pour autant, « ces assurances pourraient ne pas valoir grand-chose si les entreprises sont vendues », a souligné David Liebovitz, MD, codirecteur du Centre de formation médicale en sciences des données et santé numérique de l'Institut d'intelligence artificielle en médecine de la faculté de médecine Feinberg de l'Université Northwestern.

Pour l'instant, a-t-il déclaré, si des patients lui demandaient s'il pensait qu'ils devraient essayer ChatGPT Health, il leur suggérerait probablement « d'attendre encore un peu, le temps qu'il y ait davantage d'outils liés à la protection de la vie privée ».

Même s'ils le souhaitent, les utilisateurs de chatbots — en particulier les patients présentant des cas cliniques complexes et des antécédents médicaux longs et complexes — ne peuvent pas toujours télécharger l'intégralité de leur dossier médical, a souligné Bitterman.

« Il est très difficile de s'assurer d'avoir tous ses dossiers médicaux », a-t-elle déclaré. « Ce sont ces éléments manquants qui compliquent la pratique clinique. »

Gross a reconnu que « notre système de santé est très fragmenté ». Mais, a-t-il ajouté, si les patients oublient de télécharger leurs dossiers médicaux d'un médecin ou d'un hôpital en particulier, les notes les plus récentes de leurs médecins les mentionneront probablement au moins.

Même les patients disposant de toutes les informations pertinentes peuvent ne pas brosser un tableau complet de leur situation lorsqu'ils interagissent avec des médecins spécialistes en médecine légale, conclut une étude publiée en février.

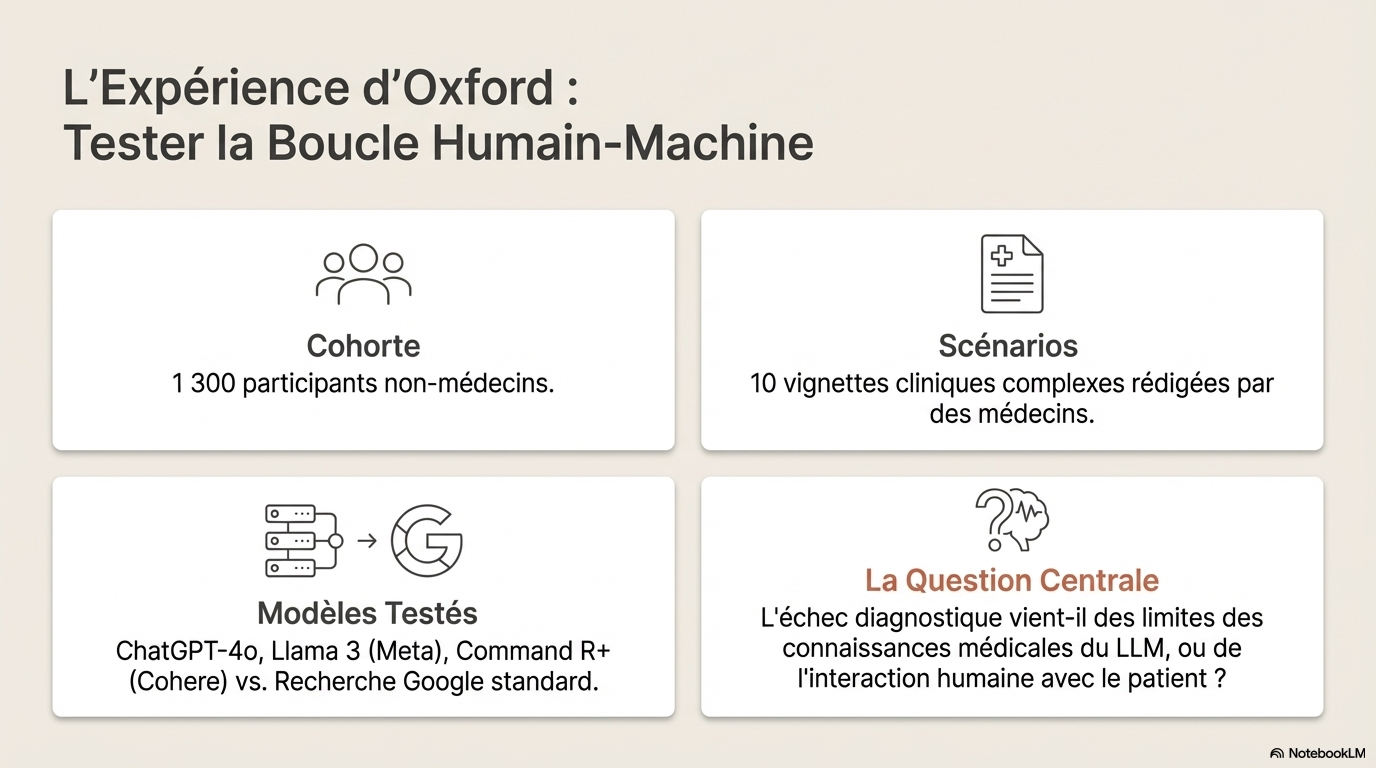

L'étude, menée par l'Oxford Internet Institute au Royaume-Uni, a testé si les assistants vocaux numériques (AVN) pouvaient aider des personnes sans formation médicale à identifier des problèmes de santé sous-jacents et à choisir une conduite à tenir dans 10 scénarios de santé élaborés par des médecins. Les chercheurs ont réparti aléatoirement 1 300 participants en trois groupes : le premier recevait l'aide de l'un des trois AVN testés, tandis que le second, servant de groupe témoin, utilisait une source de son choix, généralement Google. Les trois AVN étaient ChatGPT-4o, Llama 3 de Meta et Command R+, développé par Cohere, une entreprise canadienne.

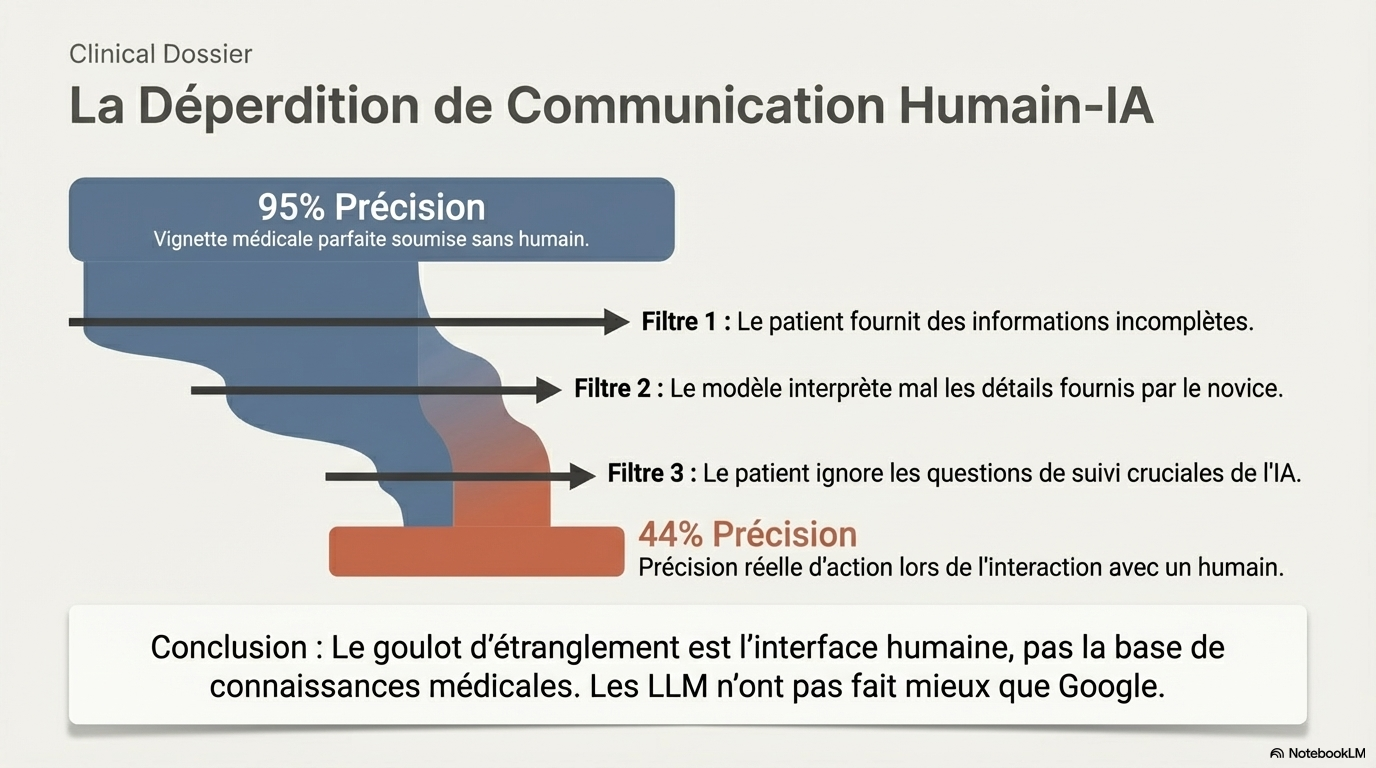

En moyenne, lorsque les scientifiques présentaient les vignettes directement aux LLM, en contournant l'interaction humaine, les chatbots identifiaient correctement la pathologie dans 95 % des cas et la marche à suivre appropriée dans 56 % des cas.

Mais lorsque les participants à l'étude ont présenté les vignettes aux mêmes assistants virtuels, les chatbots n'ont correctement identifié les affections pertinentes que dans un tiers des cas environ, et la conduite à tenir appropriée dans moins de 44 % des cas. Leurs performances n'ont pas été meilleures que celles de Google dans le groupe témoin.

« Le facteur limitant n'était pas seulement les connaissances médicales du modèle », a expliqué par courriel Rebecca Payne, MBBS, PhD, MPH, médecin généraliste à la faculté de médecine du nord du Pays de Galles (université de Bangor) et co-auteure de l'étude. « C'était la communication entre l'humain et l'IA : les personnes fournissant des informations incomplètes, le modèle interprétant mal des détails importants et, surtout, les personnes omettant de relayer une suggestion diagnostique pertinente émise par le modèle lors de l'échange. »

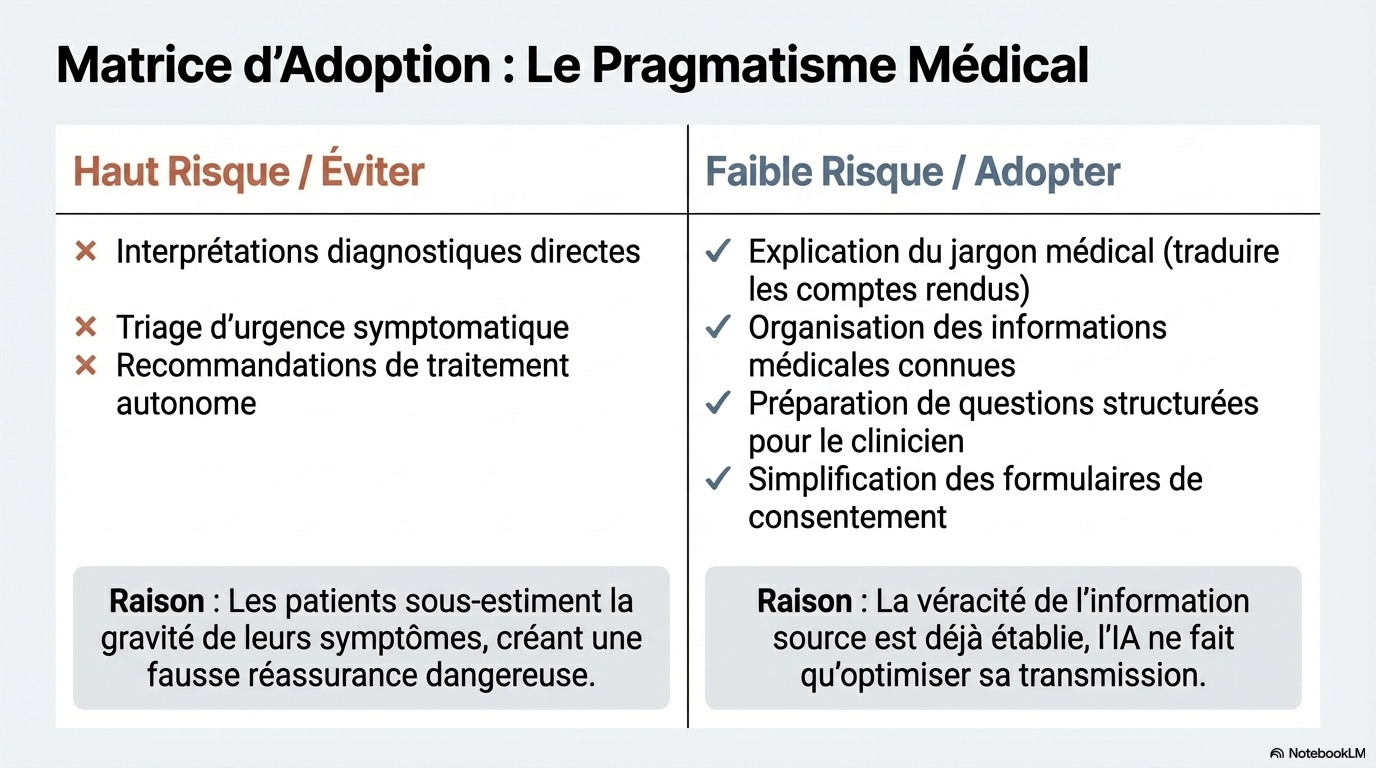

Qu’ils utilisent un manuel d’utilisation ou Google, les participants à l’étude « ont eu tendance à sous-estimer la gravité des situations décrites dans les scénarios testés », a déclaré Payne. « Cela augmente le risque que certains utilisateurs se sentent rassurés à tort ou retardent leur prise en charge médicale. »

Les conclusions de Payne n'ont pas surpris Bitterman. « Avec ces chatbots, il incombe à l'utilisateur de savoir quelles informations fournir au modèle pour obtenir les meilleures données », a-t-elle déclaré. « Ce niveau de finesse clinique exige une solide formation pratique », et pas seulement la formation théorique des étudiants en master de droit sur la littérature et les manuels médicaux.

Le conseil qu'elle donne à ses patients : « Ne prenez pas de décision hâtive en vous basant uniquement sur ce que vous trouvez en ligne. Nous pouvons en discuter ensemble. »

Les conséquences pourraient être mortelles si, par exemple, un chatbot indiquait par erreur à un utilisateur qu'il n'avait pas besoin de se rendre aux urgences car sa douleur thoracique était due à une indigestion et non à une crise cardiaque.

C’est pourquoi Payne conseille aux patients de n’utiliser les chatbots que pour des demandes d’assistance mineures, comme l’explication de termes médicaux, la préparation de questions pour un clinicien et la synthèse des informations reçues. « Actuellement, les LLM sont plus performants en tant qu’assistants/secrétaires, aidant à organiser les informations connues plutôt qu’à produire des interprétations cliniques complexes », a-t-elle déclaré.

Les médecins travaillent sur un certain nombre d'applications d'IA générative destinées à des objectifs plus ciblés et à moindre enjeu.

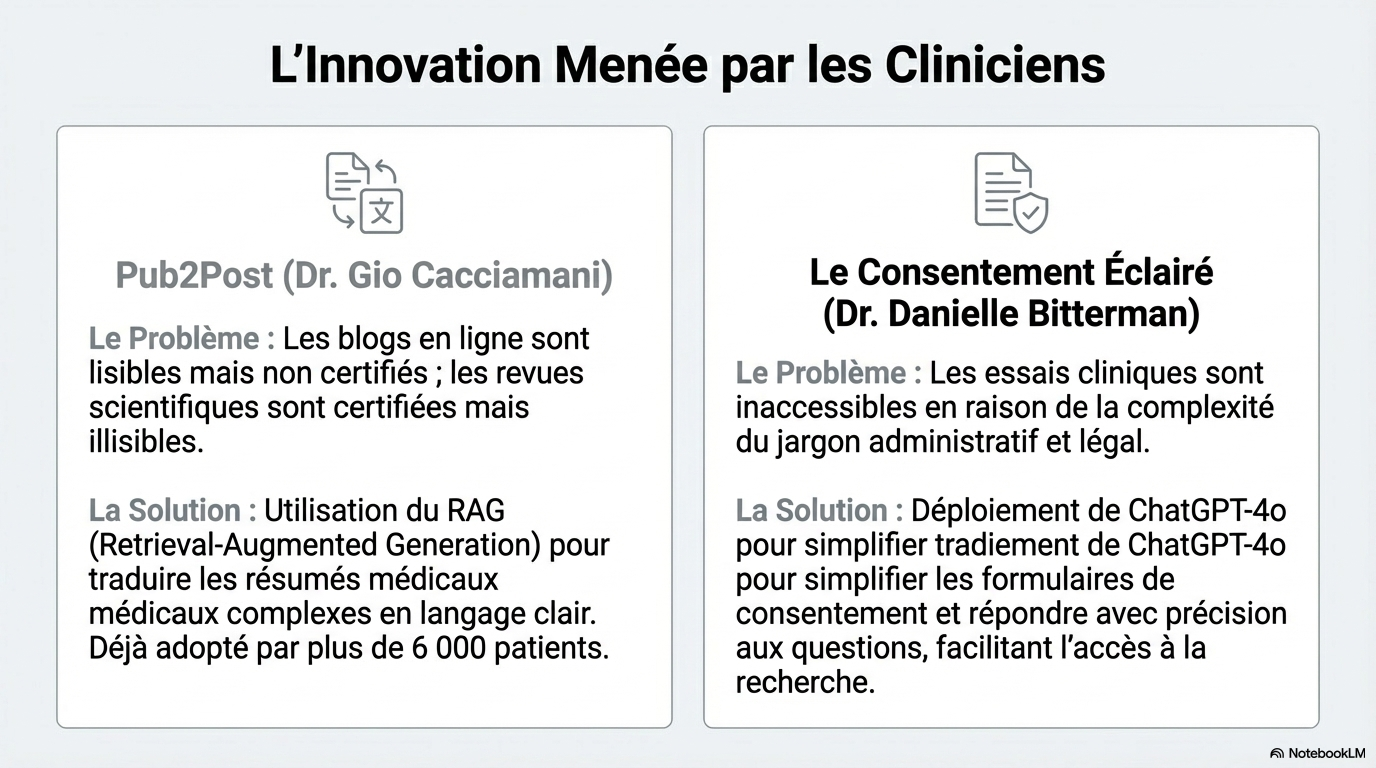

Pour l'urologue Gio Cacciamani, MD, le diagnostic d'une maladie grave chez un proche, sans lien avec sa spécialité, lui a donné un aperçu des difficultés rencontrées par les patients lorsqu'ils tentent de déchiffrer des informations scientifiques.

« Quand il s’agit de sujets qui ne sont pas de mon domaine, c’est très difficile à appréhender », a déclaré Cacciamani, directeur du Centre d’intelligence artificielle pour les applications chirurgicales et cliniques en urologie de la Keck School of Medicine de l’USC. « Cette situation m’a ouvert les yeux. »

Cacciamani a découvert deux types d'informations médicales en ligne : soit « extrêmement lisibles mais non certifiées », comme les articles de blog, soit « évaluées par les pairs, certifiées, mais pas du tout lisibles », principalement des publications dans des revues scientifiques.

L’IA générative « a le potentiel de combler les lacunes persistantes entre les connaissances médicales certifiées et la compréhension des patients », ont noté Cacciamani et ses coauteurs dans un commentaire publié en février.

En utilisant la technique de génération augmentée par la recherche (RAG), qui entraîne le LLM avec une base de connaissances médicales validées, il a développé un nouvel outil capable de traduire et de résumer des résumés et des articles complets. Plus de 6 000 personnes utilisent déjà Pub2Post , et certaines revues médicales l'emploient pour leurs publications sur les réseaux sociaux, a indiqué Cacciamani.

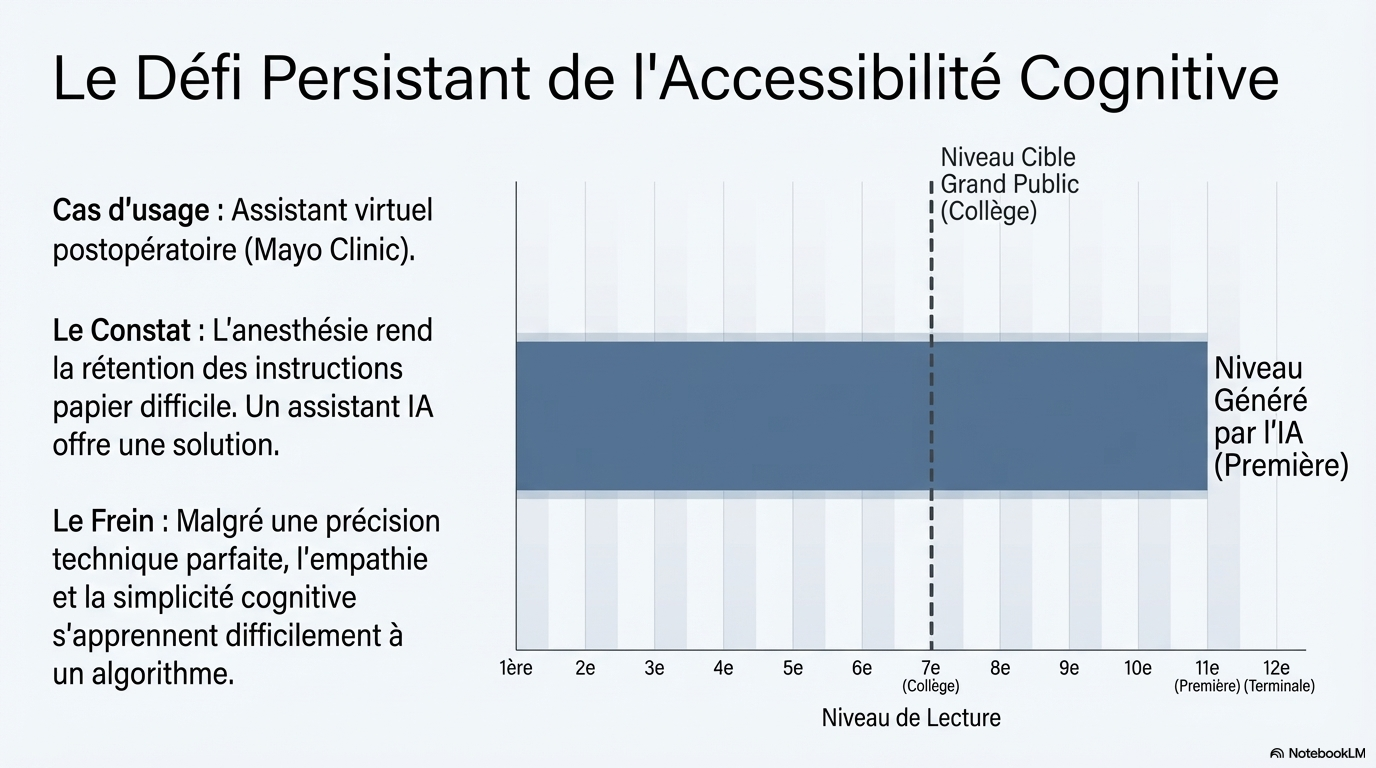

Le Dr Antonio Forte, chirurgien plasticien à la Mayo Clinic de Jacksonville, en Floride, a utilisé RAG pour développer un assistant virtuel LLM destiné aux instructions postopératoires.

Les patients sortent souvent de l'hôpital après une intervention chirurgicale alors qu'ils ressentent encore les effets résiduels de l'anesthésie ou des analgésiques, ce qui rend difficile la mémorisation des instructions postopératoires, explique Forte. De plus, ajoute-t-il, ils égarent fréquemment les documents imprimés contenant ces informations. « C'est pourquoi nous nous sommes dit : "Et si nous offrions aux patients un accès permanent à des informations médicales de qualité, vérifiées médicalement ?" »

En utilisant des interactions simulées avec des patients, les tests de l'assistant virtuel ont démontré une grande précision technique, une sécurité et une pertinence clinique, bien qu'à un niveau de lecture relativement élevé de 11e année, ont récemment rapporté Forte et ses coauteurs .

Bitterman a testé la capacité de ChatGPT-4o et de Llama 3.2-8B à répondre aux questions des patients concernant les essais cliniques, dans le but de simplifier les formulaires de consentement éclairé. Dans une étude récente , elle et ses coauteurs ont constaté que ChatGPT-4o était significativement plus fiable et plus sûr que Llama 3.2-8B pour répondre à ces questions.

En janvier, deux agences fédérales relevant du département américain de la Santé et des Services sociaux ont lancé des initiatives axées sur les outils de santé numérique destinés aux patients atteints de maladies chroniques courantes. L'une vise à évaluer un cadre réglementaire pour ces outils, notamment les modèles de vie numérique (LLM), tandis que l'autre a pour objectif de favoriser le développement d'un LLM pour les patients souffrant d'insuffisance cardiaque.

La FDA, en collaboration avec le Centre pour l'innovation de Medicare et Medicaid, a annoncé le projet pilote TEMPO (Technology-Enabled Meaningful Patient Outcomes) pour les dispositifs de santé numériques.

Selon la FDA , ce projet pilote volontaire évaluera une nouvelle approche de mise en application « qui soutient les dispositifs de santé numériques destinés à améliorer les résultats des patients souffrant de maladies cardio-rénales-métaboliques, musculo-squelettiques et comportementales ».

La FDA n'a encore autorisé aucun LLM, a déclaré Warraich. Les applications d'IA générative telles que les LLM « présentent un défi unique en raison du risque de conséquences imprévues et émergentes », selon une communication spéciale qu'il a coécrite et publiée dans le JAMA en 2024.

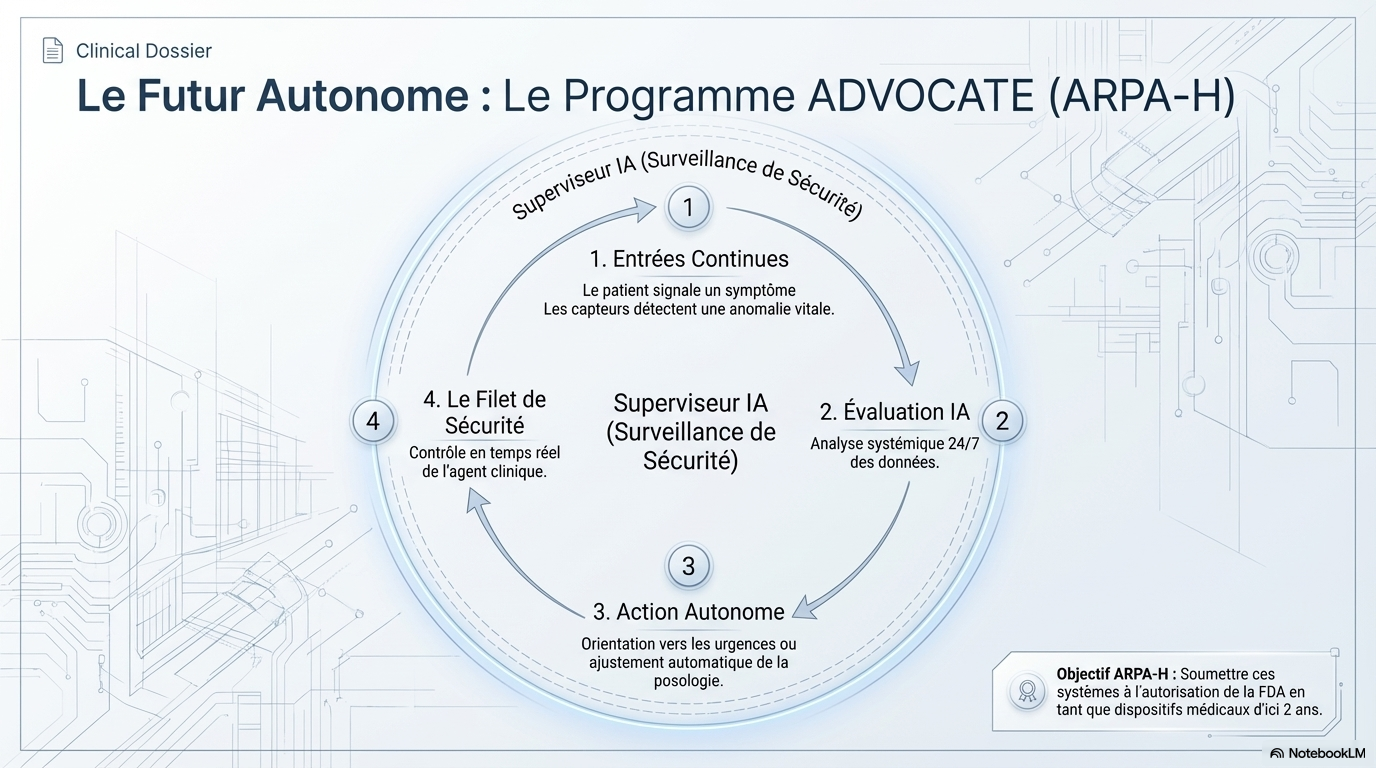

Aujourd'hui, Warraich dirige une nouvelle initiative de l'ARPA-H visant à développer de nouveaux systèmes LLM prêts à être soumis à la FDA d'ici deux ans en vue de leur autorisation en tant que dispositifs médicaux. Le programme ADVOCATE ( Agentic AI-Enabled Cardiovascular Care Transformation ) « vise à transformer la prise en charge des maladies cardiovasculaires avancées grâce à un système d'IA capable d'assurer une prise en charge clinique globale 24h/24 et 7j/7 ».

« Je crois que, dans la mesure où l’IA offre l’opportunité de transformer fondamentalement ce que signifie être clinicien, patient et la relation entre eux, la cardiologie sera à l’avant-garde… », a noté Warraich dans une tribune publiée en février dans le Journal of the American College of Cardiology .

La première application des technologies développées dans le cadre d'ADVOCATE concernera la prise en charge des patients souffrant d'insuffisance cardiaque congestive. Si un patient présente une dyspnée, par exemple, la technologie déterminera s'il doit se rendre aux urgences et s'il a besoin d'une nouvelle ordonnance ou d'une augmentation de la dose de son traitement actuel, explique Warraich. Outre le développement d'agents d'IA fiables capables d'effectuer ces modifications de manière autonome, ADVOCATE soutiendra également la création d'un système de supervision par IA afin de contrôler la sécurité et l'efficacité des agents d'IA cliniques après leur déploiement par les établissements de santé.

Car ChatGPT n'a que trois ans, le développement rapide de nouvelles applications d'IA générative destinées aux patients peut sembler relever de la science-fiction. Comme l'a déclaré Bitterman : « C'est bien au-delà de ce que j'aurais pu prédire il y a cinq ans. »

Publié en ligne : 6 mars 2026. doi : 10.1001/jama.2026.1122

Cet article examine l'émergence des outils d'intelligence artificielle générative destinés aux patients, tels que ChatGPT Health, qui visent à simplifier l'accès aux informations médicales complexes. Bien que ces technologies promettent d'améliorer la compréhension des diagnostics et de servir de complément au travail des cliniciens, elles soulèvent des inquiétudes majeures concernant la protection de la vie privée et la fiabilité des conseils fournis. Des études révèlent que les erreurs de communication entre l'humain et la machine peuvent entraîner une évaluation inexacte de la gravité des symptômes, soulignant que l'IA ne peut actuellement pas remplacer l'expertise d'un médecin. En fin de compte, le texte présente l'IA comme un assistant administratif et éducatif en pleine évolution, tout en appelant à une régulation stricte pour garantir la sécurité des soins.

|

Caractéristique

|

ChatGPT Standard

|

ChatGPT Health

|

|---|---|---|

|

Source de données

|

Informations textuelles isolées

|

Données personnelles complètes (Apple Watch, labos, imagerie)

|

|

Contexte

|

Limité (interprétation identique peu importe l'âge)

|

Sensible au contexte (différencie un patient de 20 ans vs 70 ans)

|

|

Objectif

|

Information générale

|

Guide vers les professionnels de santé

|

|

Accès

|

Public

|

Liste d'attente (en date de février 2026)

|

- Complémentarité : L'IA est conçue comme un « prolongement du clinicien » et non comme un remplaçant. Nate Gross (OpenAI) précise que le modèle est entraîné pour orienter les patients vers des professionnels pour le diagnostic et le traitement.

- Accessibilité : face à la difficulté croissante d'accéder au système de santé, les patients se tournent vers ces modèles pour obtenir des réponses immédiates. Un utilisateur sur quatre de ChatGPT cherche déjà des informations liées à la santé.

- Sous-triage : risque de retarder des traitements vitaux pour des urgences.

- Sur-triage : risque d'augmenter inutilement la charge du système de santé pour des cas non urgents.

- Précision théorique (IA seule) : identification correcte de la condition dans 95 % des cas.

- Précision pratique (interaction humain-IA) : identification correcte seulement dans environ un tiers des cas.

- Facteurs limitants : informations incomplètes fournies par l'utilisateur, mauvaise interprétation des détails clés par le modèle, et incapacité du patient à retenir les suggestions diagnostiques pertinentes de l'IA.

- Absence de conformité HIPAA : Ni ChatGPT Health, ni Grok (xAI) ne sont conformes à la loi HIPAA. En tant qu'entreprises technologiques, elles ne sont pas tenues aux mêmes obligations légales que les médecins ou les assurances.

- Grok (Elon Musk) : bien que Musk ait suggéré d'utiliser Grok pour des seconds avis médicaux, l'IA elle-même conseille de ne pas télécharger de données médicales sensibles sur sa plateforme.

- Mesures de protection d'OpenAI :

- Engagement à ne pas utiliser les conversations de ChatGPT Health pour entraîner ses modèles.

- L'option de "chats temporaires" ne s'affiche pas dans l'historique.

- Pub2Post : Traduit et résume des articles scientifiques complexes pour le grand public.

- Assistant Postopératoire (Mayo Clinic) : Fournit des instructions 24h/24 aux patients sortant de chirurgie, bien que le niveau de lecture reste élevé (niveau 1ère/terminale).

- Simplification du consentement éclairé : Des tests montrent que ChatGPT-4o est plus fiable et sécurisé que d'autres modèles (comme Llama 3.2-8B) pour expliquer les essais cliniques aux patients.

- Pilote TEMPO (FDA) : Évalue une nouvelle approche réglementaire pour les dispositifs de santé numériques (maladies cardio-rénales, métaboliques, musculosquelettiques).

- Programme ADVOCATE (ARPA-H) :

- Objectif : Développer des systèmes d'IA prêts pour une autorisation FDA comme dispositifs médicaux d'ici deux ans.

- Application initiale : Gestion de l'insuffisance cardiaque congestive.

- Autonomie : L'IA pourra décider si un patient doit se rendre aux urgences ou si une dose de médicament doit être ajustée.

- Surveillance : Création d'une "IA superviseuse" pour surveiller la sécurité des agents cliniques autonomes.

L'utilisation des CHATBOTS 'médicaux" par les patients commence à devenir de plus en plus fréquente avec beaucoup de désillusion.

Check-list de la pratique PATIENT/IA/MÉDECINE

Il y a plusieurs niveaux :

* Précision sur une affection qui vient d'être diagnostiquée par le médecin.

* Dans ce cas, le "prompt" ou la question doit être très précise.

* Questions car le patient présente différents symptômes : à éviter car la demande ne sera pas précise et l'IA peut embarquer le patient sur une fausse piste.

* Ne pas mettre en ligne le dossier médical., le secret médical est la base de la médecine et de la relation patient/médecin.

* Ne pas donner de conseils à l'entourage établis sur une IA.

* Ces IA génératives sont populaires en raison du manque de médecins et des délais de rendez-vous "stratosphériques". Le patient sera alors soit rassuré faussement, soit catastrophé faussement. Les IA peuvent se tromper… ne jamais l'oublier (hallucination).

* Trop souvent les patients surestiment ou sous-estiment les symptômes.

* L' interaction humain/IA n'est pas toujours bonne, source d'incompréhension.

* Ces IA n'ont pas d'agréments "santé". De plus, leur utilisation doit être éthique, notamment pour l'IA.

* Il ne faut jamais prendre une décision médicale uniquement sur la base des informations fournies par l'IA, car le médecin, en tant qu'humain, demeure le décideur avec le patient(e) . La responsabilité médico-légale appartient au médecin.

* Le cancer fait l'objet de nombreuses questions, attention à la désinformation issue. de certaines IA

* Médecin + IA = INTELLIGENCE MÉDICALE AUGMENTÉE (IMA).

Ainsi, prudence, à la fois pour les médecins et les patients. Les "oracles "de tout temps se trompent, l'IA aussi.

Ne pas oublier que sur les 800 millions d'utilisateurs de CHATGPT, 1/4 pose une question santé.

ll est urgent d'intégrer une ÉDUCATION/IA auprès de la population dès le plus jeune âge, afin d'éviter des erreurs graves, notamment médicales.

C'est ainsi qie les CHATBOTS seront sécurisés.