-

Sam Altman, CEO d’OpenAI, auditionné devant le Congrès américain :

"Ma pire crainte est que nous - l'industrie - causions des dommages importants au monde. Je pense que si cette technologie va mal, elle peut aller très mal et nous voulons nous exprimer à ce sujet et travailler avec le gouvernement. Nous pensons qu'une réglementation gouvernementale sera essentielle pour atténuer les risques liés à des modèles de plus en plus puissants."

-

Stephen Hawking :

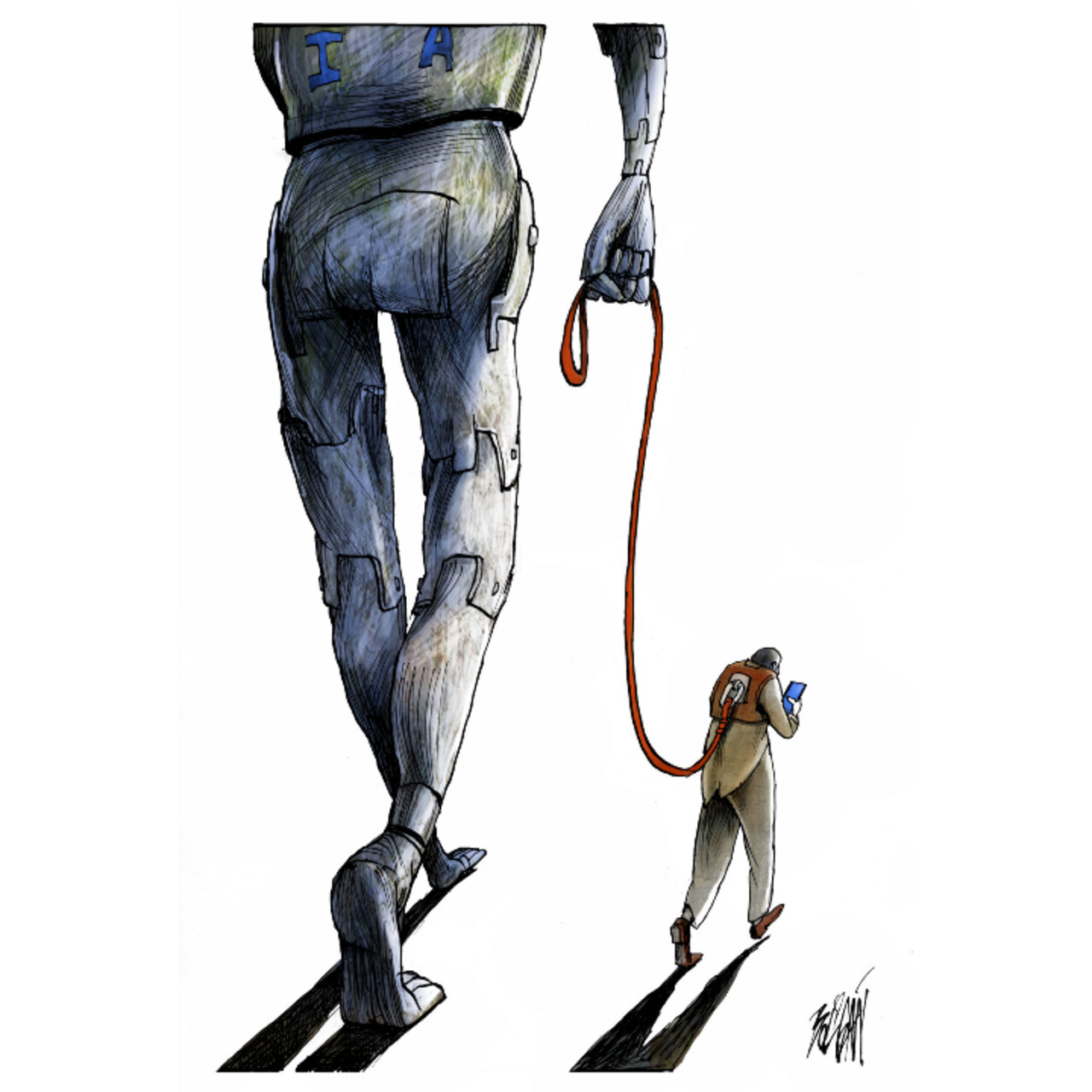

"Le développement d’une intelligence artificielle complète pourrait signifier la fin de la race humaine… Elle décollerait d’elle-même et se reconstruirait à un rythme toujours plus rapide. Les humains, limités par une évolution biologique lente, ne pourraient pas rivaliser et seraient remplacés."

-

https://jamanetwork.com/journals/jama-health-forum/fullarticle/2836054?guestAccessKey=a29b340f-4646-41f4-83c8-391f90b55e8c&utm_medium=email&utm_campaign=article_alert-jamanetwork&utm_content=weekly_highlights-ai-tfl_&utm_term=071925

Article libre d'accès

Nous vivons une époque déroutante.

En ce quart de siècle, plusieurs forces ont conspiré pour transformer de nombreux secteurs d'activité, notre quotidien et, ce qui nous intéresse particulièrement ici, les conditions et les structures qui déterminent la santé des individus et des populations.

Rien n'a peut-être été aussi disruptif que l'arrivée de l'intelligence artificielle (IA) largement disponible. Bien que la recherche sur l'IA soit menée depuis des décennies et qu'elle soit utilisée de manière spécialisée depuis des années, l' introduction de ChatGPT (OpenAI) en 2022, premier chatbot à grand modèle de langage largement disponible, a radicalement transformé la conscience mondiale du potentiel de cette technologie et a ouvert la voie à l'adoption d'approches d'IA dans tous les secteurs, y compris ceux liés à la santé et aux soins de santé.

La rapidité avec laquelle l'IA a pénétré la conscience nationale et mondiale et, plus concrètement, intégré des algorithmes qui informent un large éventail de systèmes et de structures signifie, sans surprise, que les politiques et la surveillance ont pris du retard sur la mise en œuvre et l'adaptation de l'IA dans plusieurs secteurs.

C'est le cas pour la santé et les soins de santé.

Bien que des mesures aient été prises pour réglementer les algorithmes d'IA dans le secteur de la santé, notamment la publication par le Center for Medicare & Medicaid Services (CMS) des États-Unis d'une règle finale en 2024 sur la nécessité de l'intervention humaine pour prendre la décision médicale finale dans les régimes Medicare Advantage, l'évolution de la technologie a dépassé la surveillance réglementaire et de gouvernance, et l'élaboration de règles et de normes est bien en retard sur le rythme du développement technologique dans ce domaine. Bien que les dangers potentiels de l'IA, tant dans le domaine de la santé au sens large que dans la pratique médicale plus spécifiquement, aient été abordés dans de nombreux articles et rapports, il faudra un certain temps avant que nous puissions harmoniser l'ensemble des politiques et des règles nécessaires pour garantir que nous puissions maximiser les avantages potentiels de l'IA tout en minimisant les dommages.

L'émergence du second mandat de Donald J. Trump a aggravé ce défi de réglementation lacunaire.

Depuis le début de ce second mandat, une vague de décrets et de tentatives de modification des structures réglementaires et de gouvernance a été déclenchée.

Ces mesures se sont accompagnées de fréquents revirements et contre-mandats de règles récemment mises en œuvre, ce qui a perturbé – et, à bien des égards, paralysé – le paysage réglementaire dans de nombreux secteurs.

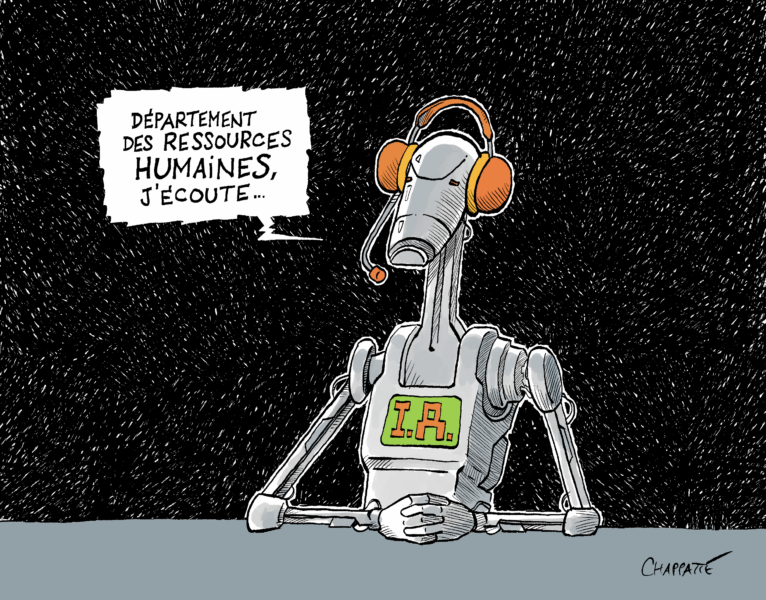

Ce changement déstabilisant s'est accompagné d'un effort fédéral concerté de réduction des coûts, notamment par des réductions d'effectifs dans les agences fédérales, laissant nombre d'entre elles, déjà sous-équipées pour faire face au rythme des changements dans tous les secteurs, encore moins bien placées pour aborder l'ampleur des politiques nécessaires à l'orientation des technologies émergentes comme l'IA.

Il a été largement souligné que cette période représente une menace considérable pour le pays et le monde, avec de nombreuses conséquences potentielles.

Cependant, une grande partie de notre réflexion s'est jusqu'à présent concentrée, à juste titre, sur les conséquences de l'action. Il convient également de réfléchir aux conséquences de l’inaction et, en l’occurrence, de l’inaction provoquée par le manque de personnel des agences fédérales, en particulier au sein du département de la Santé et des Services sociaux des États-Unis et dans les différentes unités – la Food and Drug Administration, les CMS, les Centres pour le contrôle et la prévention des maladies – qui ont un rôle à jouer dans la création des garde-fous qui peuvent garantir que les utilisations de l’IA sont positives.

Deux observations méritent réflexion.

Premièrement, l'évolution technologique est porteuse d'améliorations potentielles pour de nombreux aspects de l'expérience humaine. C'est le cas depuis longtemps et, nous l'espérons, cela continuera d'être le cas, l'IA étant au cœur de cette évolution.

Deuxièmement, le développement technologique présente également des risques potentiels, et la réglementation et la gouvernance ne peuvent être laissées exclusivement aux mains du secteur privé, animé par la recherche du profit.

Cette observation souligne la nécessité d'un secteur public actif et engagé, fonctionnant à un niveau capable de suivre la rapidité du changement et de l'adoption de nouvelles technologies comme l'IA.

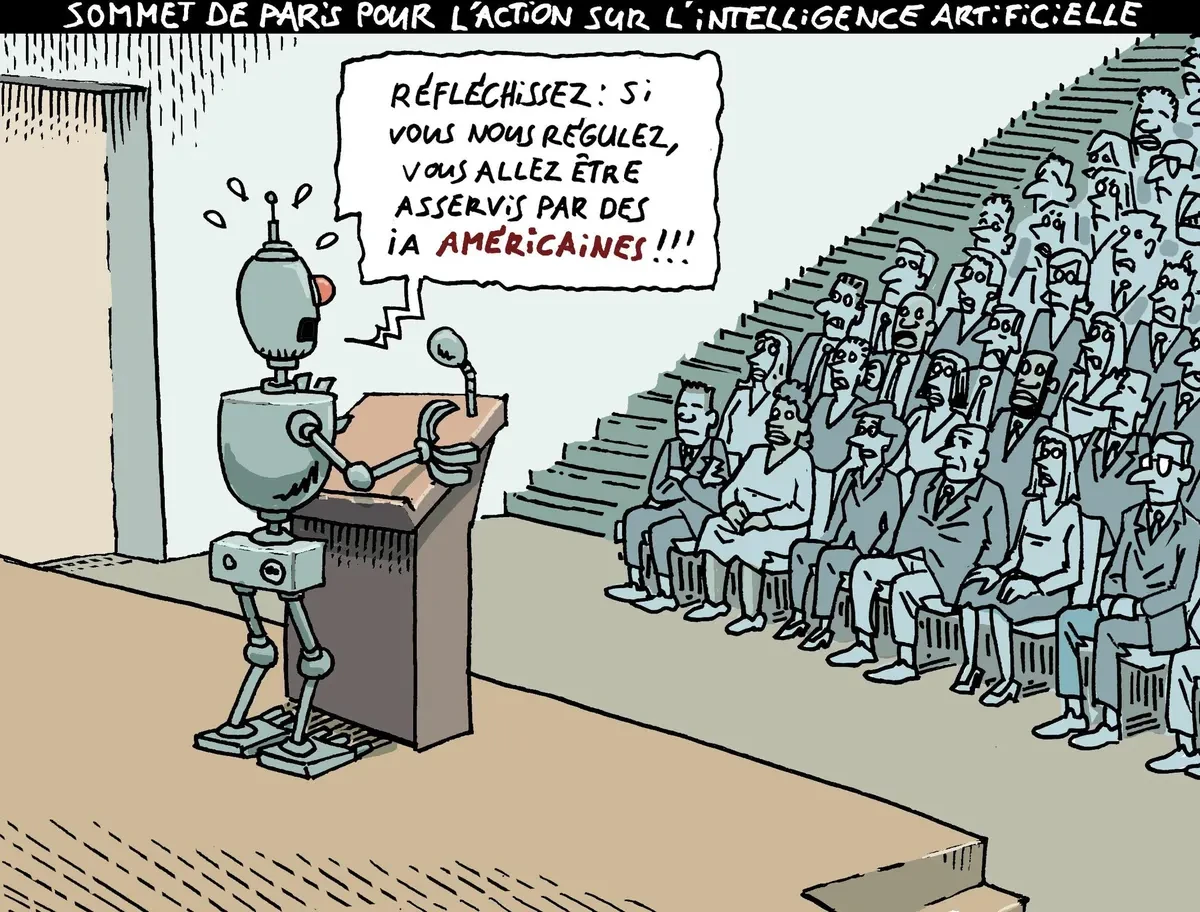

Plusieurs autres régions du monde, notamment l'Europe, ont devancé les États-Unis dans ce domaine réglementaire, offrant ainsi un exemple potentiel de la manière dont les États-Unis peuvent s'engager de la même manière.

Nous ne pouvons qu'espérer que le gouvernement fédéral américain sera en mesure de reprendre cette fonction rapidement et s'engager autour de l'IA afin d'optimiser le potentiel de cette technologie encore nouvelle et d'en atténuer les risques potentiels.

Les sources mettent en lumière les défis liés à la réglementation de l'intelligence artificielle (IA) dans le domaine de la santé. Elles soulignent que l'adoption rapide de l'IA, notamment depuis 2022, a dépassé la capacité des cadres politiques et de surveillance à suivre le rythme. De plus, l'article évoque comment les changements récents dans le paysage politique, incluant les réductions de personnel dans les agences fédérales, ont paralysé les efforts de réglementation nécessaires pour encadrer l'IA. L'auteur insiste sur le fait que la réglementation publique est cruciale pour maximiser les avantages de l'IA tout en minimisant ses dangers potentiels. Il suggère en outre que les exemples d'autres régions du monde, comme l'Europe, pourraient servir de modèle pour les États-Unis.

"Les élus républicains de la Chambre des représentants ont inséré dans la loi budgétaire un amendement interdisant pendant 10 ans toute régulation de l'IA par les États. Les analystes mettent en garde contre un vide réglementaire.

Une vide juridique problématique

Ce moratoire général, s’il est voté,, empêcherait la plupart des gouvernements des États et des collectivités locales d'appliquer la réglementation de l'IA jusqu'en 2035. Le projet de loi stipule qu'« aucun État ni aucune subdivision politique de celui-ci ne peut appliquer une loi ou un règlement régissant les modèles d'intelligence artificielle, les systèmes d'intelligence artificielle ou les systèmes de décision automatisés » pendant 10 ans.

Cette proposition inquiète les experts du secteur en alertant sur le vide juridique. « Le moratoire proposé, d’une durée de dix ans, sur la réglementation de l’IA au niveau des États est une arme à double tranchant », a déclaré Abhivyakti Sengar, directrice de pratique au cabinet d’analyse Everest Group. « D’une part, il vise à prévenir un environnement réglementaire fragmenté susceptible de freiner l’innovation ; d’autre part, il risque de créer un vide réglementaire, laissant les décisions cruciales concernant la gouvernance de l’IA entre les mains d’entités privées sans surveillance suffisante.

Un fossé réglementaire avec l’UE

L'approche américaine contraste désormais fortement avec la législation sur l'IA de l'Union européenne, qui impose des exigences strictes aux systèmes d'IA à haut risque. « Alors que les États-Unis s'écartent du cadre réglementaire strict de l'UE en matière d'IA, les multinationales pourraient être confrontées à la difficulté de naviguer entre des normes contradictoires », a noté Abhivyakti Sengar. Cette divergence pourrait entraîner une augmentation des coûts de conformité et des complexités opérationnelles. Un avis partagé par Sanchit Vir Gogia, analyste en chef et CEO de Greyhound Research, « Le moratoire américain accentuera probablement les divergences réglementaires avec l'Europe. ». Il ajoute, « Cela accélérera la fragmentation de la conception mondiale des produits d'IA, où l'éligibilité des cas d'usage et les seuils éthiques varient considérablement selon les régions. » "

https://www.lemondeinformatique.fr/actualites/lire-des-elus-americains-demandent-un-moratoire-de-10-ans-sur-la-regulation-de-l-ia-96858.html

Cet article appuie là où ça fait mal, le désastre TRUMP. Alors que les USA étaient en avance, là voilà en retard sur la CEE et la Chine. Plus de réglementation, plus de ressources financières, le bateau US sombre.

En fait, TRUMP ne comprend rien à l'IA, et ça ne l'intéresse pas du tout malgré les financements de la TECH !

L'éthique européenne en matière d'IA est exemplaire. Du côté US, l'efficacité pragmatique vis-à-vis de l'IA n'existe plus. Les "savants" migrent vers l'Europe, TRUMP a réussi la fuite des cerveaux !

Pourquoi l'absence de réglementation de l'IA est très dangereuse : , elle peut être à l'origine d'une véritable dystopie…

Copyright : Dr Jean Pierre Laroche/2025