« Nous menons notre vie quotidienne sans presque rien comprendre au monde qui est le nôtre. Nous accordons peu de pensées à la machine qui engendre la lumière du Soleil, rendant ainsi la vie possible, à la gravité qui nous colle à une Terre qui, autrement, nous enverrait tournoyer dans l'espace, ou aux atomes dont nous sommes faits et dont la stabilité assure notre existence. À l'exception des enfants (qui n'en savent pas assez long pour poser les questions importantes), peu d'entre nous passent beaucoup de temps à se demander pourquoi la nature est telle qu'elle est. » Stephen Hawking

Préambule : les dangers de l'IA par une IA (Chat GPT)

Il est important de développer et de mettre en œuvre des pratiques d'IA responsables pour atténuer ces dangers.

Giuliano Liguori

Giuliano Liguori@ingliguori

Giuliano Liguori

Giuliano Liguori@ingliguori

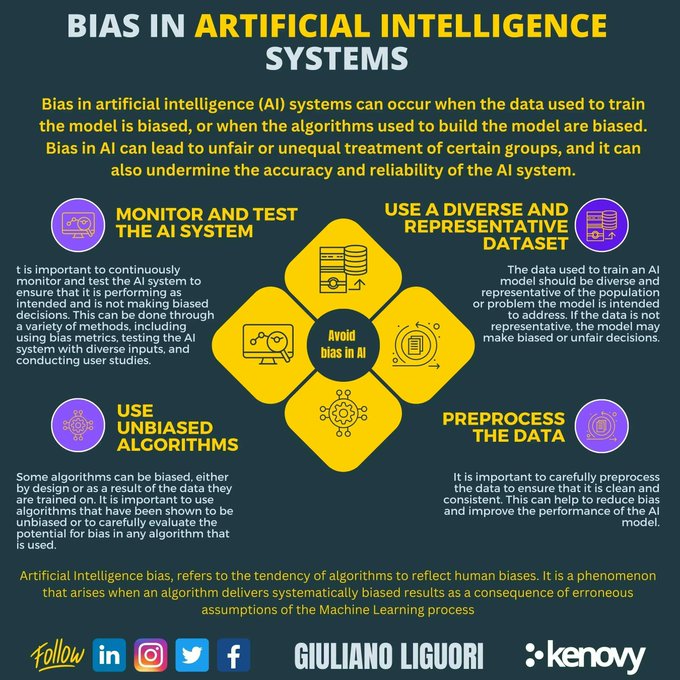

Biais dans l'intelligence artificielle qu'est-ce que c'est ? (Chat GPT)

Le biais dans l'intelligence artificielle (IA) fait référence à la présence d'erreurs ou d'inexactitudes systématiques dans les processus de prise de décision des algorithmes d'IA qui entraînent un traitement inégal ou injuste de certains individus ou groupes. Ces biais peuvent être introduits dans les systèmes d'IA à différents stades de développement, notamment la collecte de données, la conception d'algorithmes et le déploiement.

L'une des principales causes de biais dans l'IA est l'utilisation de données biaisées ou incomplètes pour former des modèles d'apprentissage automatique. Si les données utilisées pour former un algorithme ne sont pas représentatives de la population qu'il est censé servir, l'algorithme peut faire des prédictions ou des décisions inexactes pour certains groupes. Par exemple, un système d'IA formé sur des données historiques peut perpétuer les préjugés sociétaux et discriminer certains individus ou groupes, tels que les personnes de couleur, les femmes ou les personnes handicapées.

Une autre source de biais est la conception de l'algorithme lui-même. Par exemple, si l'algorithme utilise certaines fonctionnalités pour faire des prédictions qui sont corrélées avec des caractéristiques protégées (telles que la race ou le sexe), cela peut entraîner des résultats discriminatoires. De plus, si l'algorithme n'est pas transparent ou interprétable, il peut être difficile d'identifier ou de corriger les biais dans sa prise de décision.

Pour lutter contre les biais dans l'IA, l'accent a été mis de plus en plus sur le développement d'ensembles de données de formation plus diversifiés et représentatifs, ainsi que sur le développement d'algorithmes plus transparents et interprétables. De plus, il existe un intérêt croissant pour l'intégration de considérations éthiques et sociales dans le développement et le déploiement de systèmes d'IA afin de s'assurer qu'ils ne perpétuent pas les préjugés sociétaux ou ne nuisent pas aux groupes vulnérables.

Giuliano Liguori

Giuliano Liguori@ingliguori

IA et dignité humaine

"Les droits humains sont "gravement menacés" par l'intelligence artificielle, selon l'ONU

"Je suis profondément troublé par le potentiel de nuisance des récentes avancées en matière d'intelligence artificielle", a déclaré samedi le Haut-Commissaire des Nations unies dans un bref communiqué."

L'intelligence artificielle promet une révolution dans la recherche sur internet et d'autres usages encore à inventer. Mais les experts avertissent qu'elle présente aussi des risques (violations de la vie privée, algorithmes biaisés...) qui nécessiteront une régulation, difficile à mettre en place alors que ces technologies progressent rapidement.

https://www.francetvinfo.fr/internet/les-droits-humains-sont-gravement-menaces-par-l-intelligence-artificielle-selon-l-onu_5666339.html#xtor=CS2-765-%5Bautres%5D-

IA : position David Gruson

David Gruson

Directeur Programme Santé LUMINESS / Fondateur ETHIK-IA

https://www.youtube.com/watch?v=5fV4h7RqcAU

Le progrès est donc là mais avec lui, comme aurait dit Raymond ARON, ses risques de « désillusions ». Les enjeux éthiques associés à l’IA en santé sont, en effet, majeurs. Le médecin risque de déléguer sa décision à la machine. Et le patient, habitué à l’efficacité des services numériques dans la vie de tous les jours, pourra de facto déléguer sa faculté à consentir aux soins.

Comment l’intelligence artificielle se comportera-t-elle en situation de gestion de crise sanitaire s’il faut protéger le plus nombre en faisant le choix d’en sacrifier quelques-uns ?

Tocqueville en avait décrit les tenants et aboutissants dès La Démocratie en Amérique. L’IA en porte la logique à un point d’extrapolation extrême. Avec un élément puissant que Tocqueville avait déjà pressenti : la satisfaction émolliente associée à l’efficacité du service rendu. Si la Machine améliore la qualité et l’efficacité du système de santé, le risque est grand que nous ne nous apercevions simplement pas de corollaires éthiques péjoratifs qui pourraient être associés à cette marche vers l’automatisation.

https://www.les-philosophes.fr/intelligence-artificielle/la-machine-le-medecin-moi.html

IA et médecine, la bonne solution....

"Il y a de nombreuses raisons d’espérer en l’évolution de la médecine, à l’âge de l'IA, mais tout autant de la craindre. De nombreuses questions restent sans réponse. Il nous appartiendra donc de rester optimiste et de ne pas freiner le développement de l'IA, mais aussi de nous montrer prudents dans les processus que nous utiliserons pour l’évaluer et l’utiliser. Au-delà de cette thématique. Nous devons également veiller à ce que le développement de l'IA ne favorise pas une médecine à deux vitesses où seuls des patients, les plus aisés pourront bénéficier des toutes dernières technologies." Jean Emmanuel Bidault