" Déployer une intelligence artificielle éthique sera l’enjeu du siècle qui vient " Jérémy Harroch

Rabelais écrivait dans Pantagruel “Science sans conscience n'est que ruine de l'âme”.

"Pour créer des technologies de santé basées sur l’IA qui profitent à tous les patients, nous avons besoin d’ensembles de données qui représentent la diversité des personnes auxquelles elles sont destinées. Malheureusement, les ensembles de données sur la santé ne représentent souvent pas de manière adéquate la diversité des populations." Standing Together

Préambule STANDING TOGETHER

https://www.datadiversity.org/recommendations

Recommandations pour la diversité, l'inclusivité et la généralisabilité dans les technologies de santé et les ensembles de données sur la santé de l'intelligence artificielle

Description

Le potentiel bénéfique de l’intelligence artificielle (IA) pour la santé doit être mis en balance avec les risques posés par les biais et les préjudices algorithmiques. Ces technologies peuvent fonctionner mieux pour certains groupes et moins bien pour d’autres, provoquant ou aggravant les inégalités en matière de santé.

Pour garantir que l’avenir des soins de santé basés sur l’IA soit inclusif et équitable, la collaboration STANDING Together a élaboré des recommandations internationales fondées sur un consensus pour mettre en évidence et atténuer les préjudices potentiels causés par les biais dans les données et les algorithme

Essais contrôlés randomisés évaluant l'intelligence artificielle dans la pratique clinique : une revue Ryan Han, Julián N Acosta, Zahra Shakeri, John PA Ioannidis, Eric J Topol, Pranav Rajpurkar La santé numérique Lancet, Elsevier mai 2024

https://www.thelancet.com/journals/landig/article/PIIS2589-7500(24)00047-5/fulltext

Article libre d'accès

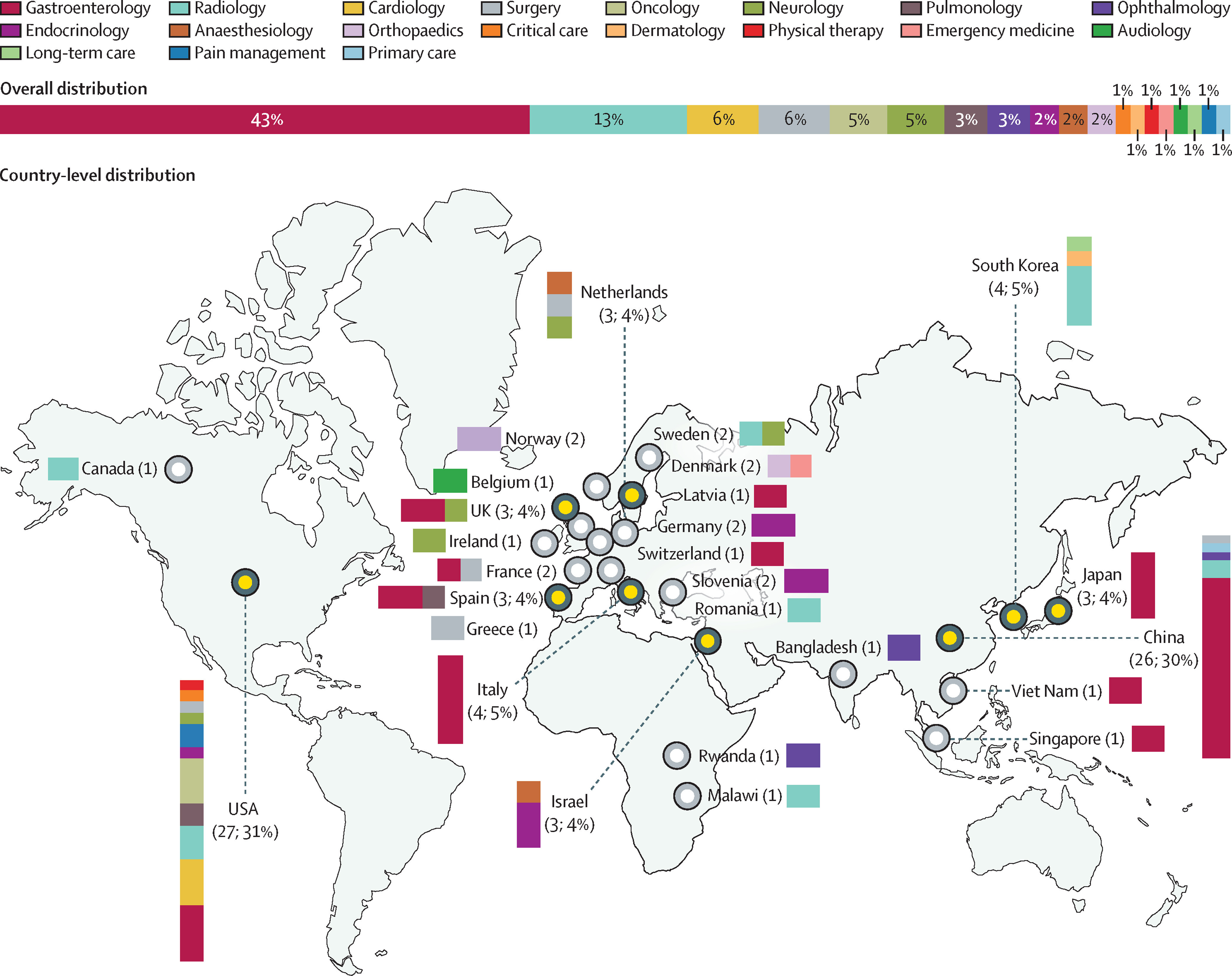

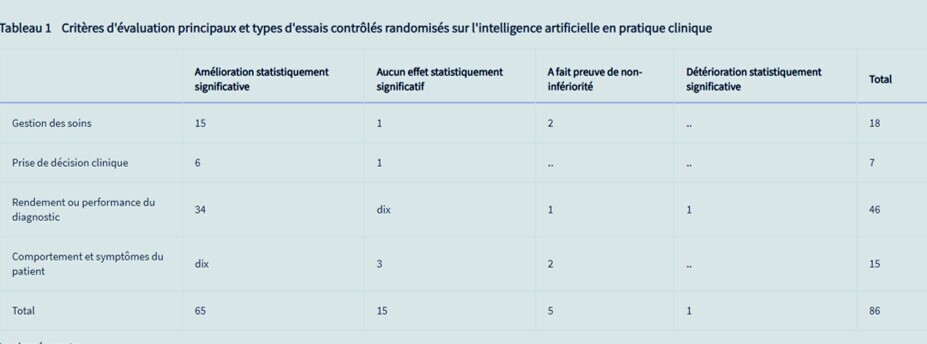

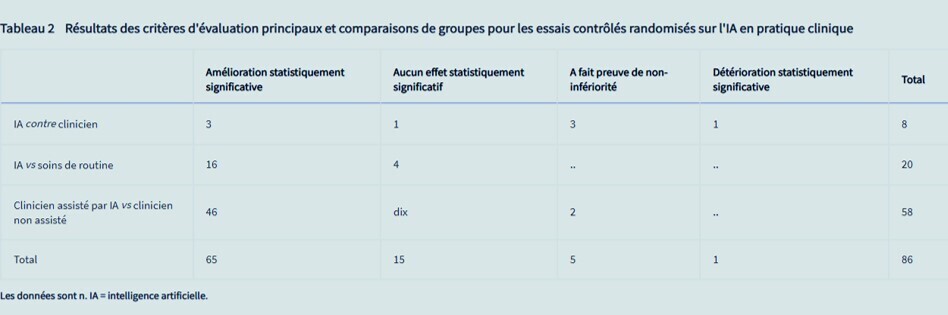

Cette revue exploratoire d'essais contrôlés randomisés sur l'intelligence artificielle (IA) dans la pratique clinique révèle un intérêt croissant pour l'IA dans toutes les spécialités cliniques et dans tous les sites.

Les États-Unis et la Chine sont en tête pour le nombre d'essais, avec un accent sur les systèmes d'apprentissage profond pour l'imagerie médicale, notamment en gastro-entérologie et en radiologie.

Une majorité d'essais [81 %] font état de critères d'évaluation principaux positifs, principalement liés au rendement ou à la performance du diagnostic ; cependant, la prédominance des essais monocentriques, le peu de rapports démographiques et les rapports variables sur l'efficacité opérationnelle soulèvent des inquiétudes quant à la généralisabilité et au caractère pratique de ces résultats.

Malgré les résultats prometteurs, il est crucial de prendre en compte la probabilité d'un biais de publication et la nécessité de recherches plus complètes, comprenant des essais multicentriques, des mesures de résultats diverses et des normes de reporting améliorées.

Les futurs essais sur l’IA devraient donner la priorité aux résultats pertinents pour les patients afin de bien comprendre les véritables effets et limites de l’IA dans les soins de santé

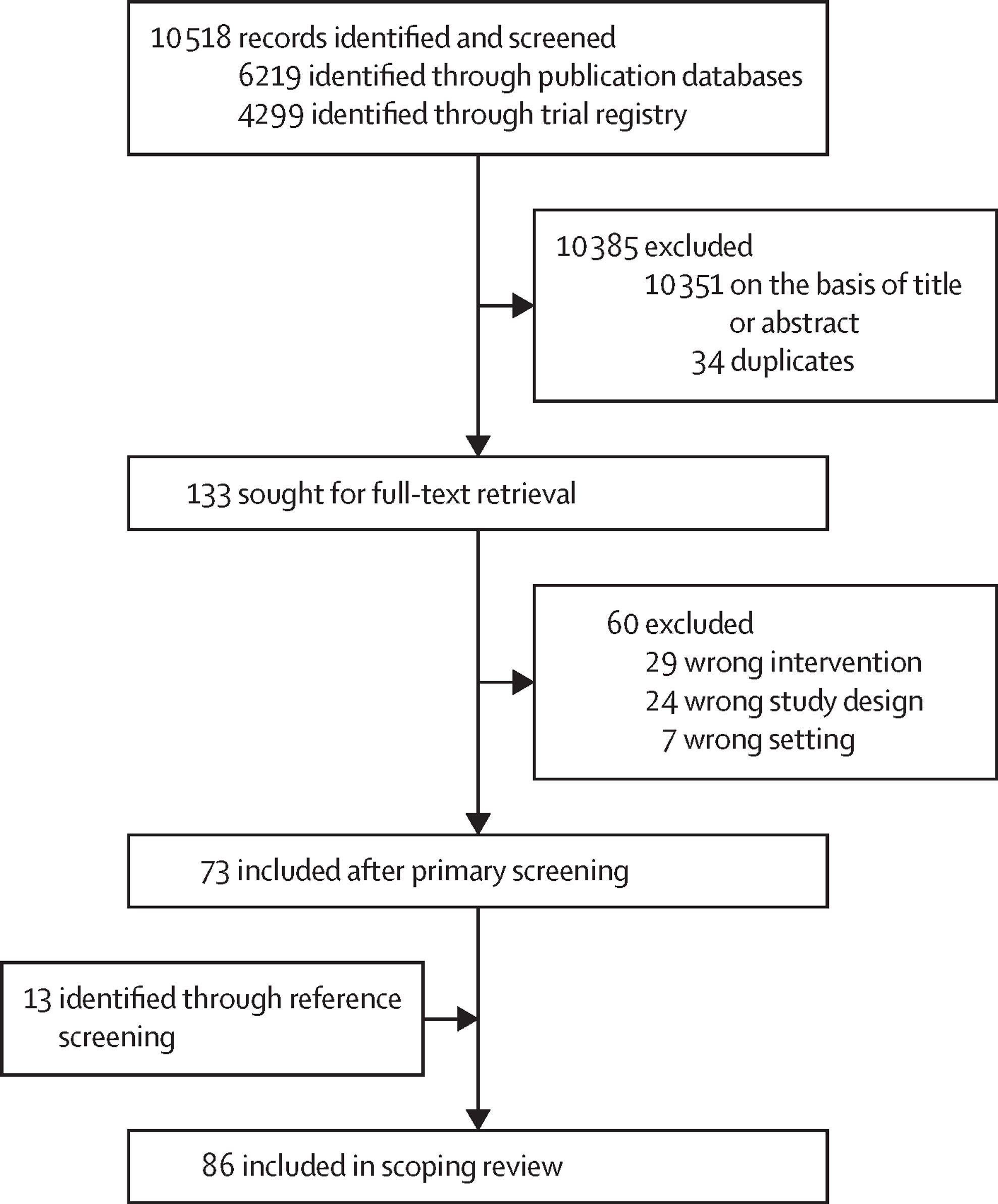

Sélection des études

Essais contrôlés randomisés sur l'intelligence artificielle dans la pratique clinique dans différents pays et spécialités

Discussion

peut être attribué à nos définitions spécifiques de l’IA et de la pratique clinique, qui excluaient les études ne comportant pas d’intégrations cliniques et d’IA non linéaire, et à notre stratégie de recherche mise à jour qui incluait plusieurs essais nouveaux et auparavant négligés.

Premièrement, la recherche d’études pertinentes a été menée uniquement en anglais. Cette restriction linguistique aurait pu exclure les essais pertinents publiés dans d'autres langues, limitant potentiellement l'exhaustivité et la généralisabilité de nos résultats.

Deuxièmement, malgré l’extension de la période d’examen jusqu’en 2023, notre revue ne prend pas en compte les tendances actualisées du risque de biais des essais. Les futures revues systématiques devraient aborder les tendances du risque de biais des essais (par exemple, en utilisant le risque de biais Cochrane et d'autres outils connexes) et fournir une analyse plus approfondie de la transparence des rapports (CONSORT-AI), compte tenu de l'afflux constant d'ECR.

Commentaire

Cet article "de base " définit les règles de la place de l'IA médicale en montrant les difficultés à venir.

En imagerie médicale les données sont plus faciles à rassembler ; scanner, IRM, par contre plus difficile en échographie

Le recueuil de données médicales cliniqiue , c'est là que c'exprime toutes les difficultés de l'IA. La validié de ces données cliniques n'est pas évidente et cela pend du temps.

IA et éthique : sujet brulant, mais oh combien important, on a besoin de transparence quand on s'epare de l'IA.

Les quatre éthiques de l’intelligence artificielle

Éthique informatique

Éthique algorithmique, robotique, artificielle

Éthique numérique

Éthique des usages de l’IA

https://journals.openedition.org/rac/29961

Vers une éthique de l'Intelligence Artificielle

"L’IA est la nouvelle frontière de l’humanité. Une fois que celle-ci sera franchie, une nouvelle forme de civilisation humaine verra le jour. Le principe directeur de l’IA n’est pas de devenir autonome ni de remplacer l’intelligence humaine. Mais nous devons nous assurer qu’elle est développée selon une approche humaniste, fondée sur des valeurs et les droits de l’homme. Nous faisons face à une question cruciale, à savoir quel type de société nous voulons pour demain. La révolution de l’IA ouvre de nouvelles perspectives passionnantes, mais les bouleversements anthropologiques et sociaux qu’elle engendre méritent une réflexion approfondie. "

https://www.un.org/fr/chronicle/article/vers-une-ethique-de-lintelligence-artificielle

Chaire éthique et IA

La chaire éthique & IA, labellisée dans le cadre de l’institut grenoblois MIAI, entend développer une approche philosophique de l’éthique de l’intelligence artificielle. Elle se veut également pluridisciplinaire car elle associe dans ses travaux des membres issus des disciplines suivantes : informatique, robotique, psychologie cognitive et clinique, sciences de l’information et de la communication, sciences de gestion. Elle vise une meilleure compréhension des enjeux sociaux, moraux et politiques du déploiement de l’IA, ainsi que la détermination de règles éthiques pour une IA démocratique, en lien avec ses partenaires économiques, culturels et sociaux.

https://www.ethics-ai.fr/

Éthique informatique

ERHIQUE et IA

Forum mondial sur l’éthique de l’IA 2024 5 - 6 février 2024, Kranj Organisé par la Slovénie, UNESCO

"La bonne gouvernance de l'IA est l'un des défis les plus importants de notre époque, qui nécessite un apprentissage mutuel basé sur les leçons et les bonnes pratiques émergeant des différentes juridictions à travers le monde.

L'objectif de l'Observatoire mondial de l'éthique et de la gouvernance de l'IA est de fournir une ressource mondiale aux décideurs politiques, aux régulateurs, aux universitaires, au secteur privé et à la société civile afin de trouver des solutions aux défis les plus urgents posés par l'intelligence artificielle.

L'Observatoire présente des informations sur l'état de préparation des pays à adopter l'IA de manière éthique et responsable.

Il héberge également le laboratoire d'éthique et de gouvernance de l'IA, qui rassemble des contributions, des recherches percutantes, des boîtes à outils et des bonnes pratiques."

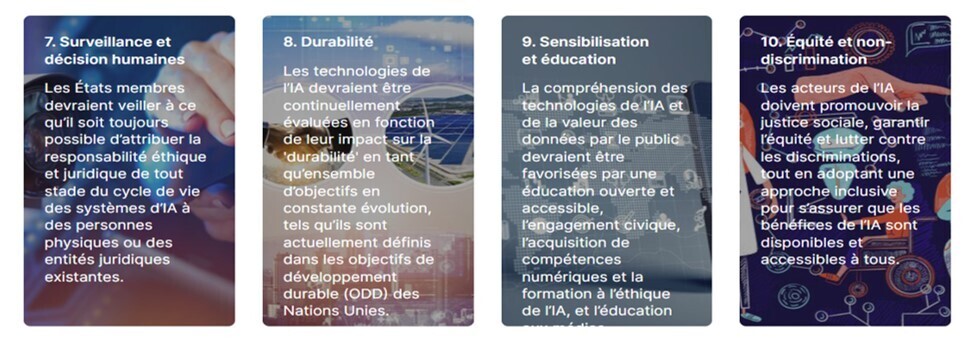

Dix principes fondamentaux définissent une approche de l'éthique de l'IA centrée sur les droits de l'homme.

https://www.unesco.org/fr/forum-ethics-ai