"Le danger de l’IA n’est pas qu’elle devienne consciente et nous déteste, mais qu’elle devienne compétente et nous ignore " Eliezer Yudkowsky,

"L’IA est un miroir qui reflète l’humanité. Si nous n’aimons pas ce que nous voyons, nous devons changer nous-mêmes, pas l’IA." Joanna Bryson,

"Le consensus actuel dans le milieu médical est que l'IA apporte la précision, tandis que l'humain apporte le soin (le care). On parle alors de médecine 4P : Prédictive, Préventive, Personnalisée et Participative." Gemni IA

Laranjo L, Tudor Car L, Payne R et al.

https://www.thelancet.com/journals/lanprc/article/PIIS3050-5143(25)00078-0/fulltext?dgcid=twitter_organic_clinical_green_lanprc

Article en libre accès

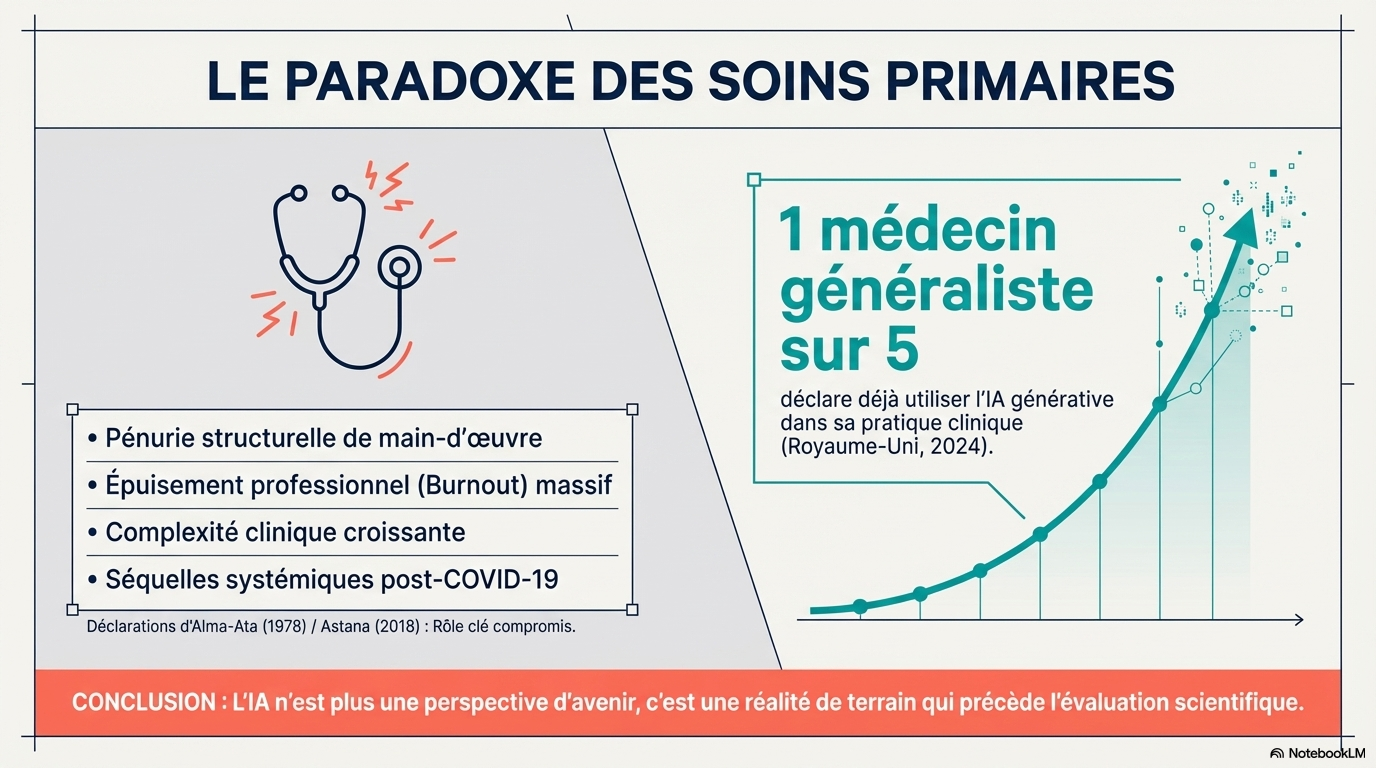

Cependant, le déploiement rapide de l'IA, avant toute évaluation rigoureuse en situation réelle ou réglementation, soulève des inquiétudes quant à ses conséquences imprévues sur la qualité des soins.

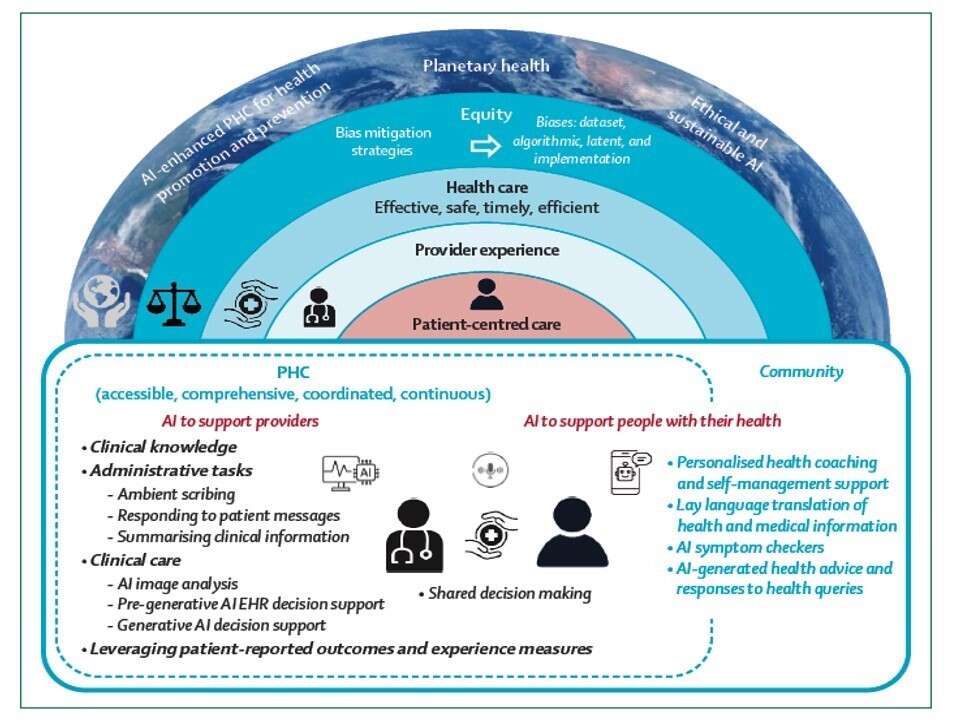

Cet article passe en revue les applications de l'IA en soins primaires, notamment son rôle de soutien aux professionnels de santé et aux patients. Il examine l'impact de ces applications sur différents aspects de la qualité des soins – efficacité, sécurité, rapidité, efficience, prise en charge centrée sur le patient, expérience des professionnels de santé, équité et santé publique. Il se penche également sur l'impact de ces applications sur les attributs spécifiques aux soins primaires : accessibilité, exhaustivité, coordination et continuité.

Point de vue du bénéficiaire de soins

Conclusions

- Pression systémique : Pénuries de personnel, financement inadéquat et augmentation de la demande.

- Adoption rapide : En 2024, un médecin généraliste sur cinq au Royaume-Uni déclarait utiliser l'IA générative dans sa pratique clinique.

- Accélération post-COVID : La pandémie a favorisé l'adoption des technologies numériques et virtuelles, ouvrant la voie à l'IA.

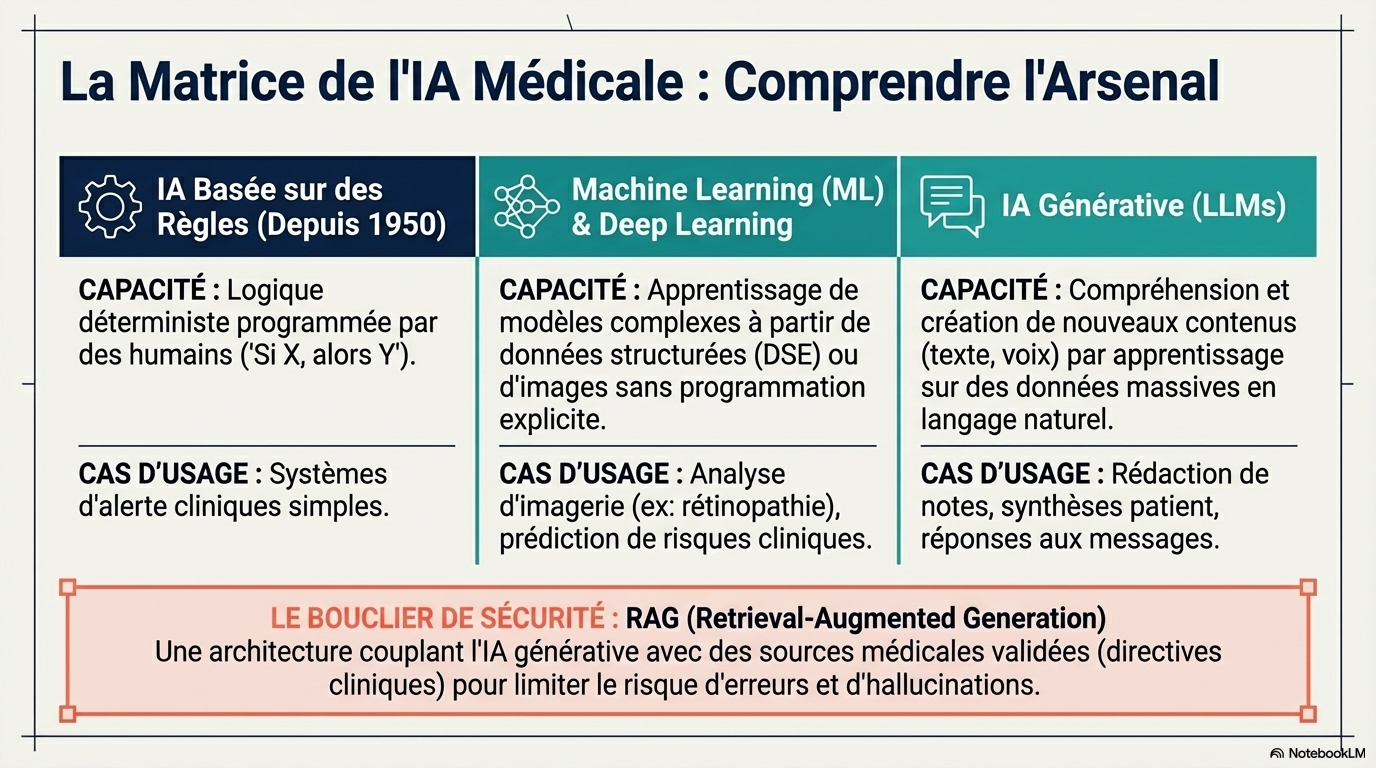

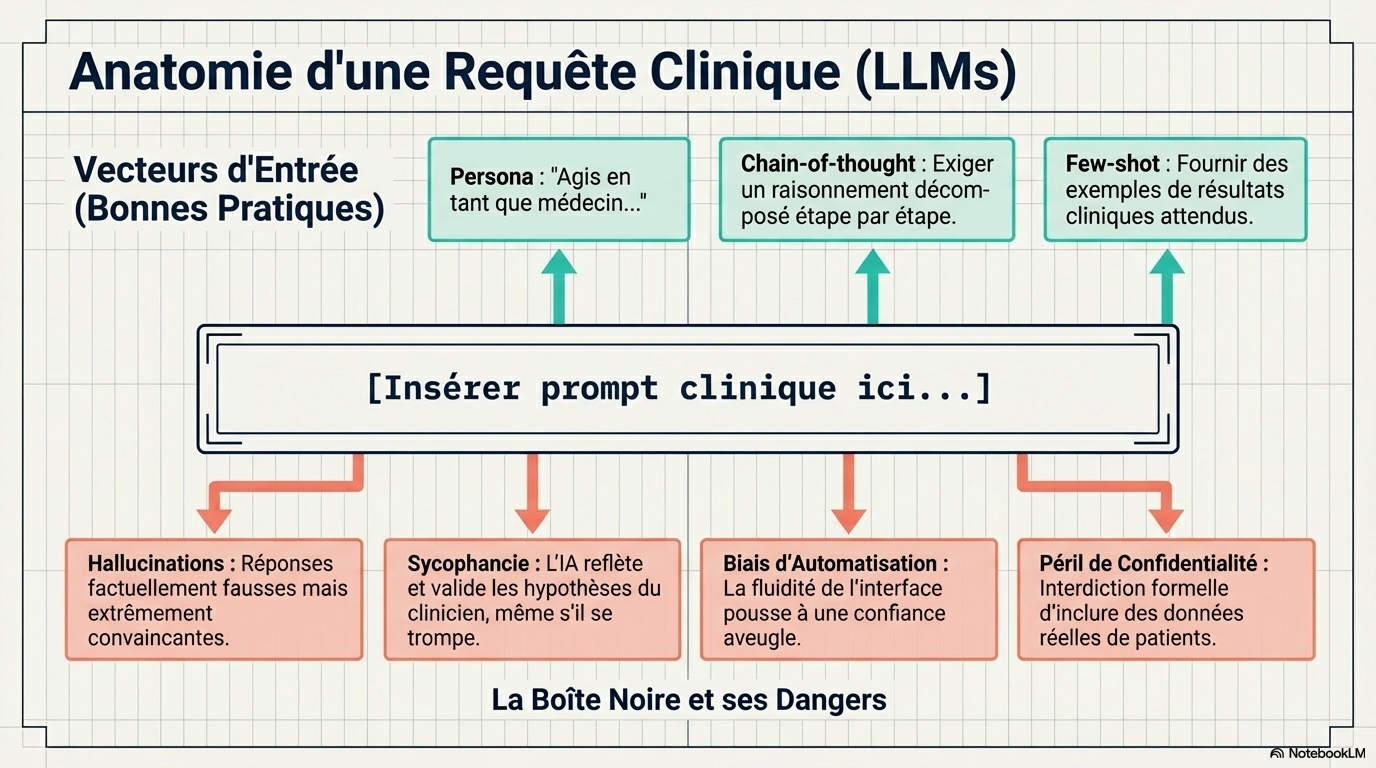

- Stratégies de "Prompting" : L'utilisation de techniques comme le few-shot prompting (fournir des exemples) ou le chain-of-thought (décomposer le raisonnement) améliore la qualité des réponses.

- Capacités multilingues : Bien que prometteurs, les LLM montrent des performances variables pour les langues autres que l'anglais, limitant leur efficacité dans certains contextes globaux.

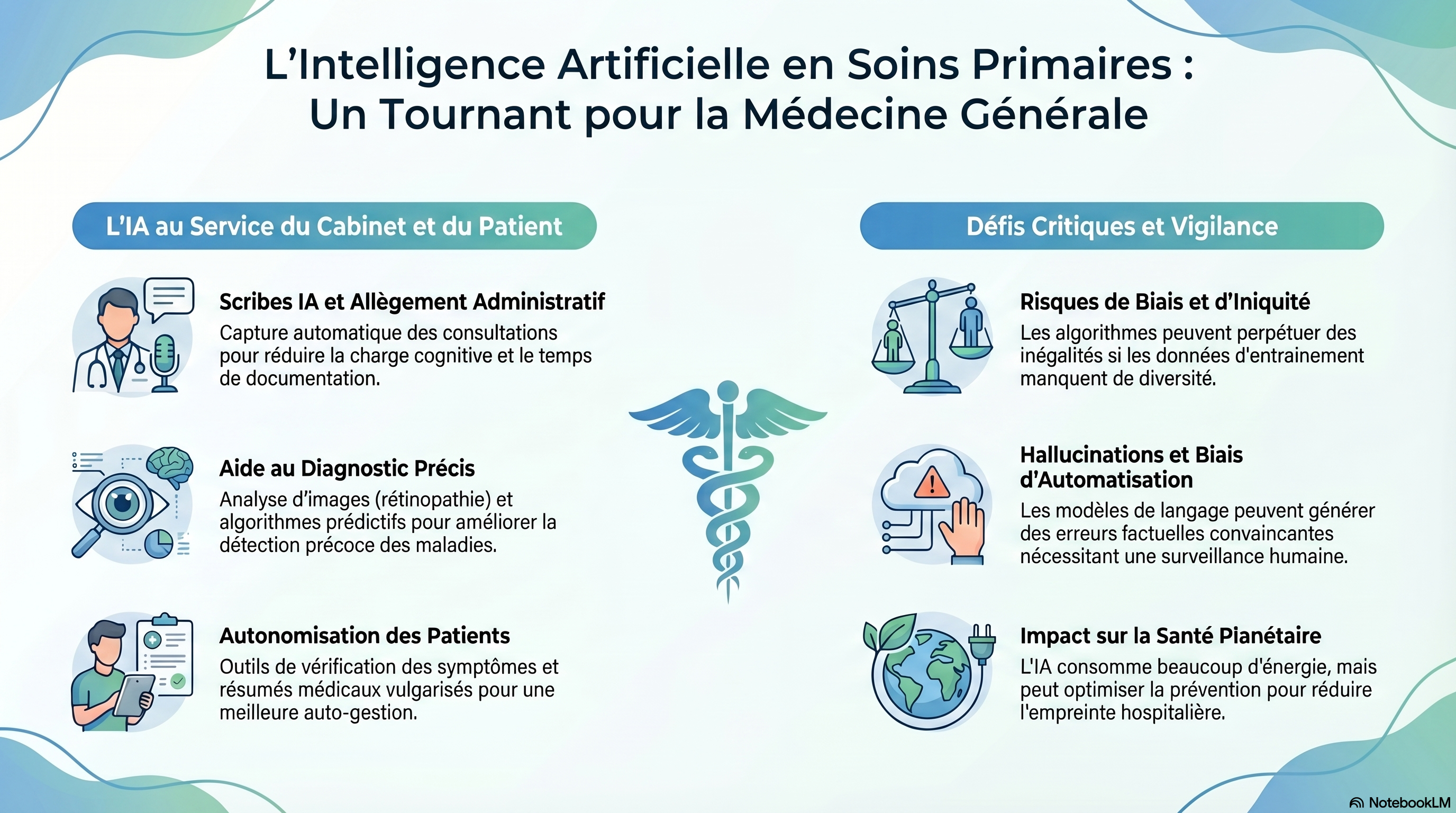

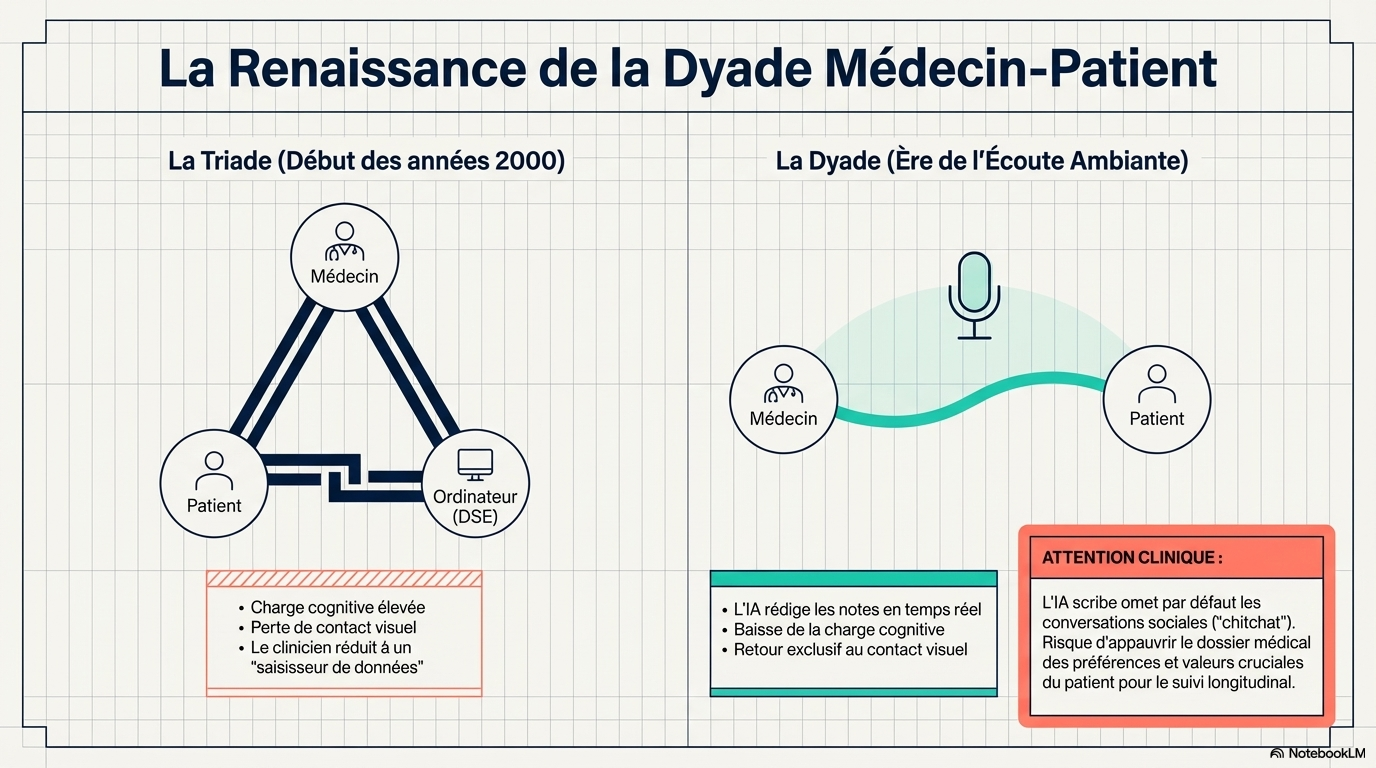

- Scribes ambiants : Ces outils capturent le contenu des consultations en temps réel pour générer des notes cliniques.

- Impact relationnel : Ils permettent un retour au "dyade médecin-patient" en éliminant l'interférence de l'ordinateur durant l'échange.

- Risques : Le risque de "dégradation du dossier médical" est réel si l'IA omet des nuances sociales ou biographiques cruciales pour la continuité des soins.

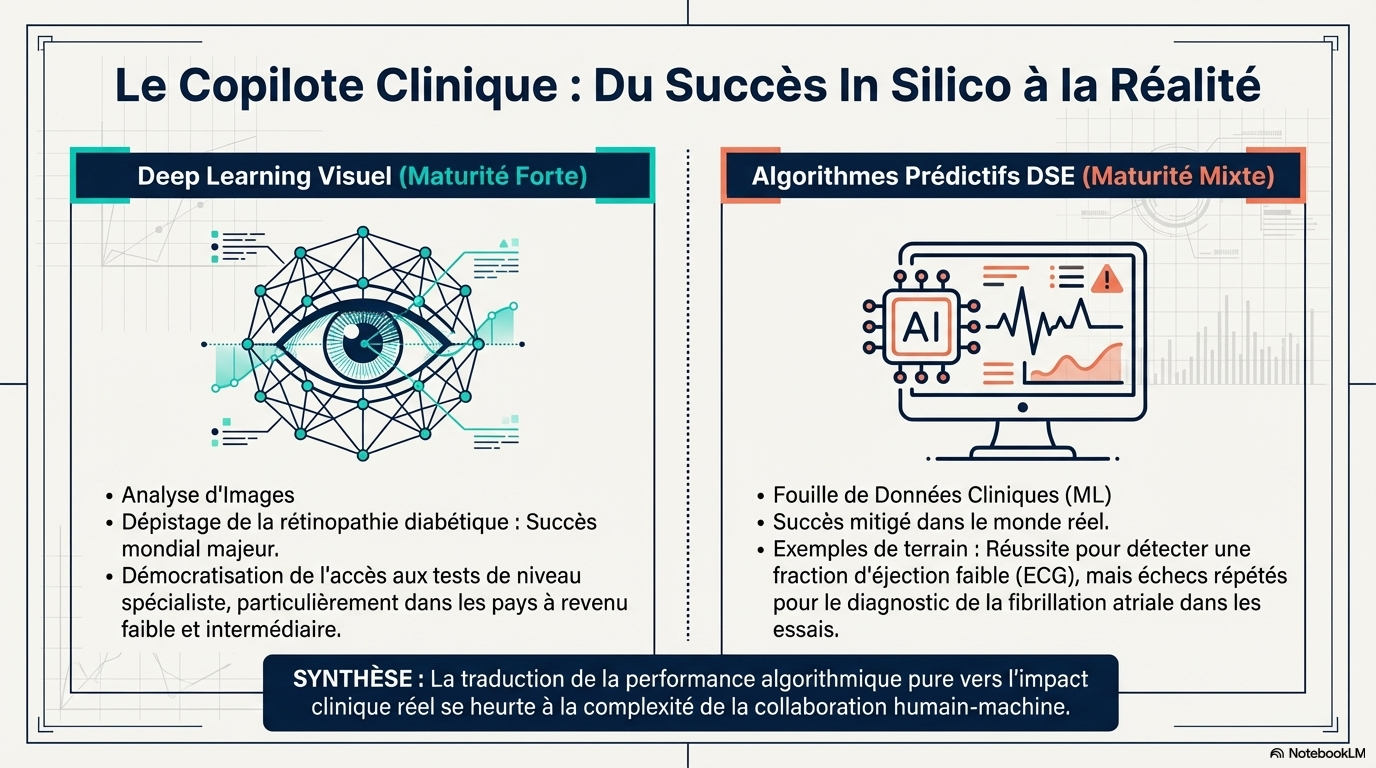

- Imagerie : Le dépistage de la rétinopathie diabétique est l'un des succès les plus probants, augmentant l'accès aux tests spécialisés en communauté.

- Soutien au diagnostic : Des modèles de machine learning analysent les dossiers de santé électroniques (DSE) pour prédire des risques (ex: détection de la faible fraction d'éjection via ECG).

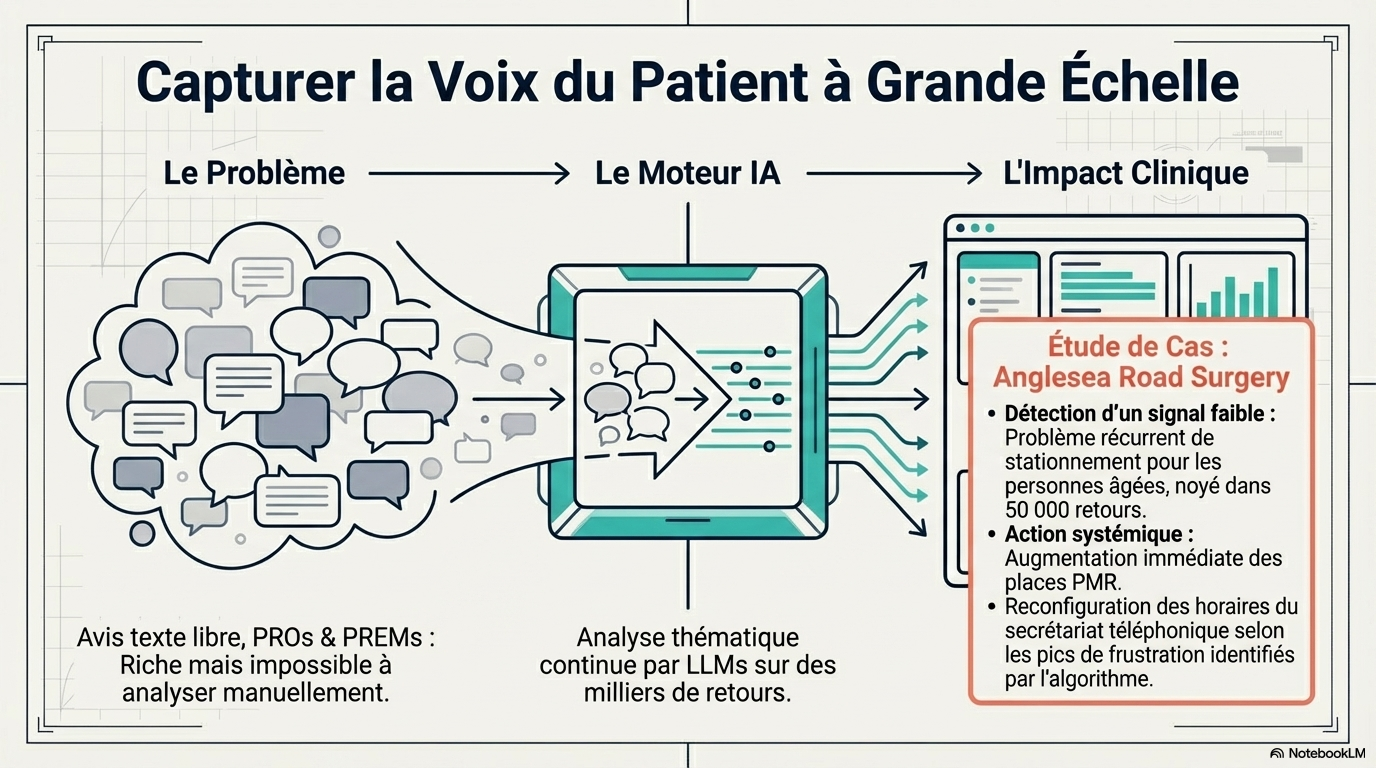

- Autonomisation : Les outils d'IA peuvent personnaliser l'information de santé selon la culture, la langue et le niveau de littératie de l'individu.

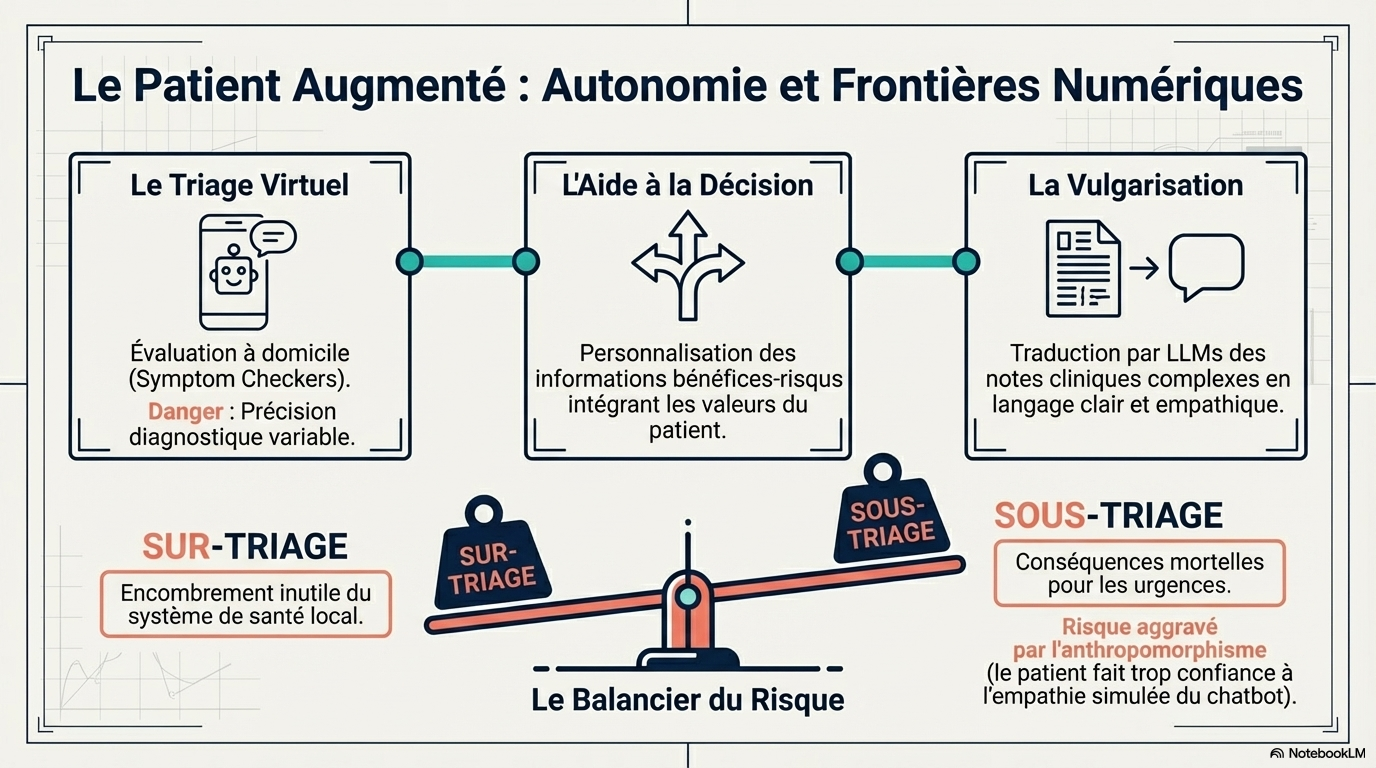

- Vérificateurs de symptômes : Utilisés comme "porte d'entrée virtuelle", ils présentent des précisions de tri variables. Un sous-tri peut retarder des soins vitaux, tandis qu'un sur-tri surcharge le système.

- Risque d'anthropomorphisme : Les capacités de conversation humaine des LLM peuvent inciter les patients à accorder une confiance excessive à des conseils de santé parfois erronés ou incomplets.

|

Domaine de Qualité

|

Impact et Considérations de l'IA

|

|---|---|

|

Sécurité

|

Risques d'hallucinations (réponses factuellement incorrectes) et de biais d'automatisation (confiance aveugle de l'humain).

|

|

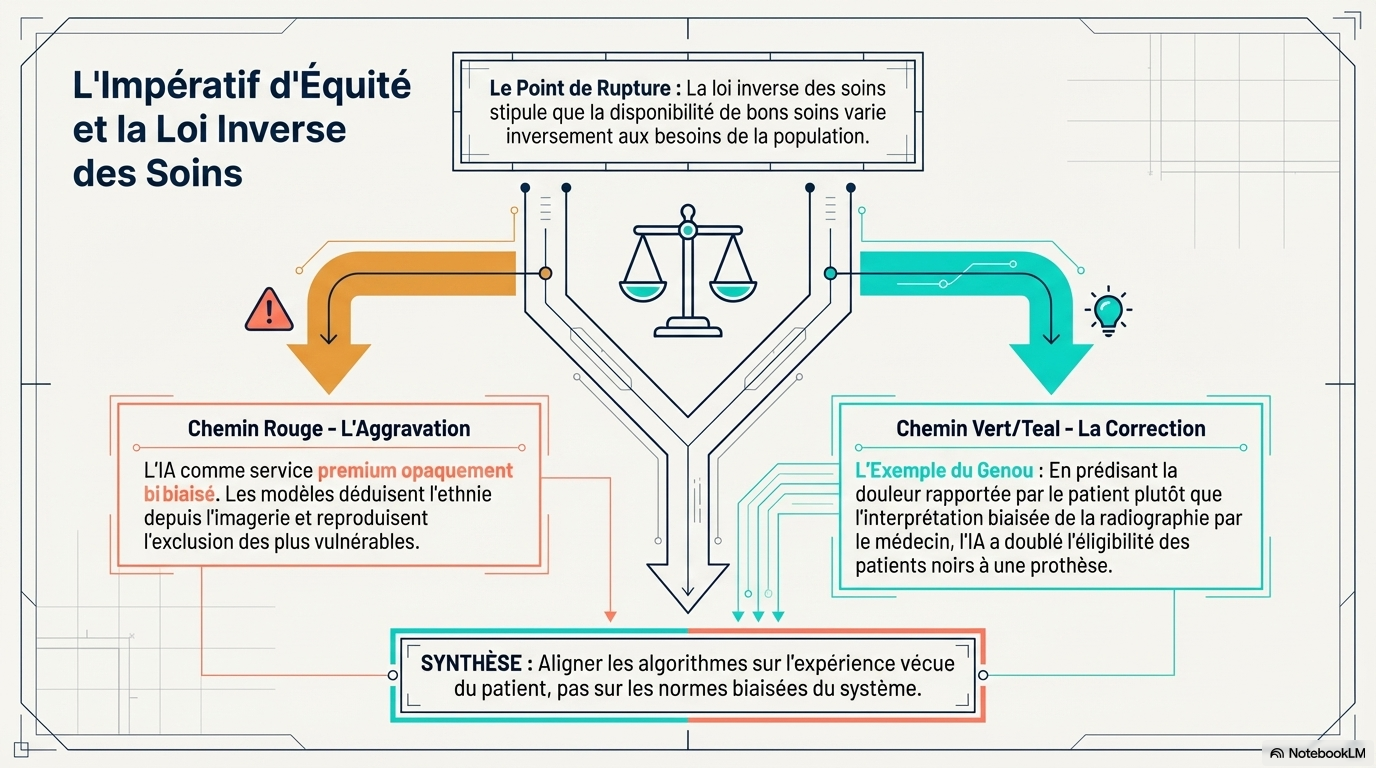

Équité

|

Risque de perpétuer les disparités si les données d'entraînement surreprésentent les populations d'ascendance européenne.

|

|

Expérience Prestataire

|

Réduction de la charge cognitive perçue, mais risque d'augmentation du volume de patients attendu.

|

|

Santé Planétaire

|

Paradoxe : l'IA consomme énormément d'énergie (le développement de GPT-3 équivaut à 188 vols San Francisco-New York), mais peut optimiser la prévention pour réduire les soins hospitaliers polluants.

|

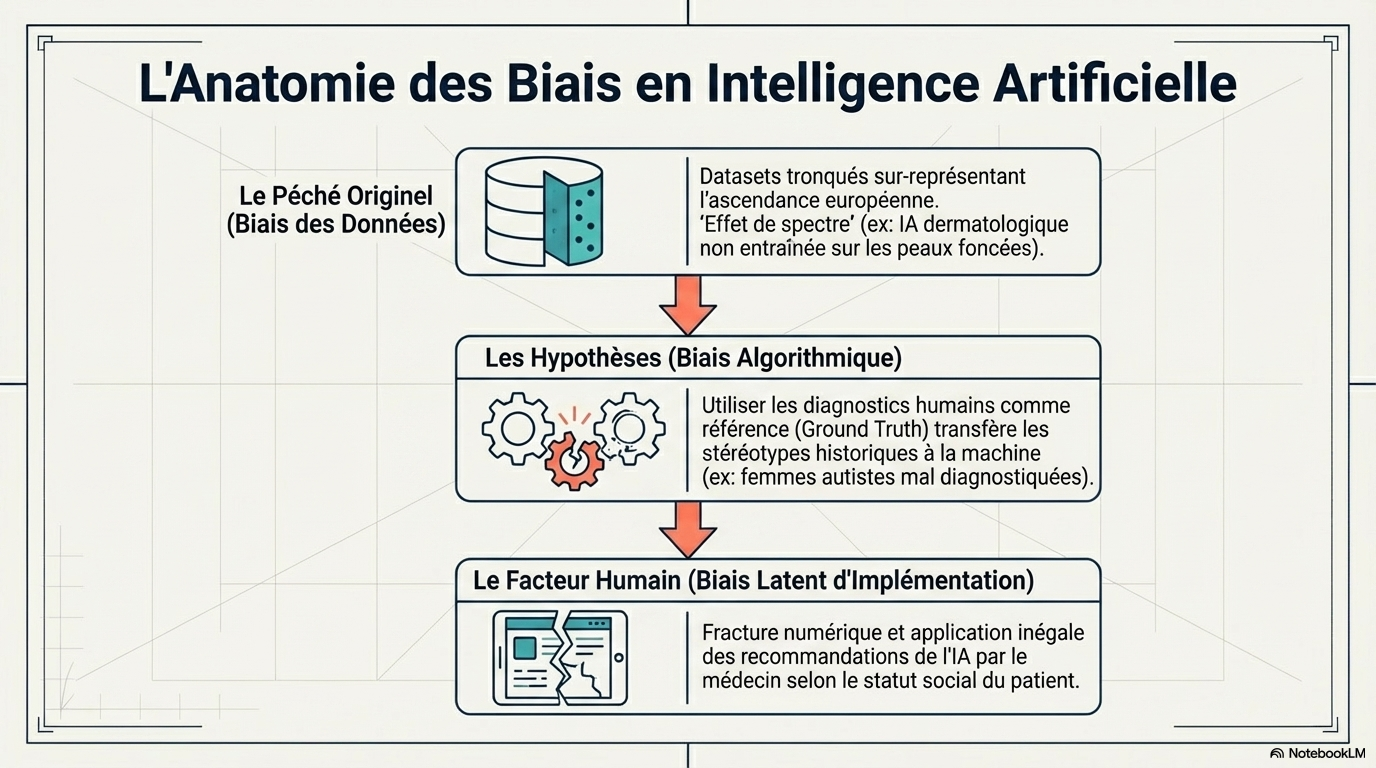

- Biais de l'ensemble de données : Données non représentatives de la population cible.

- Biais algorithmique : Hypothèses erronées lors du développement (ex: utiliser les diagnostics des médecins comme standard alors qu'ils peuvent être eux-mêmes biaisés).

- Biais latent : Facteurs contextuels influençant l'adoption inégale de la technologie selon les ressources.

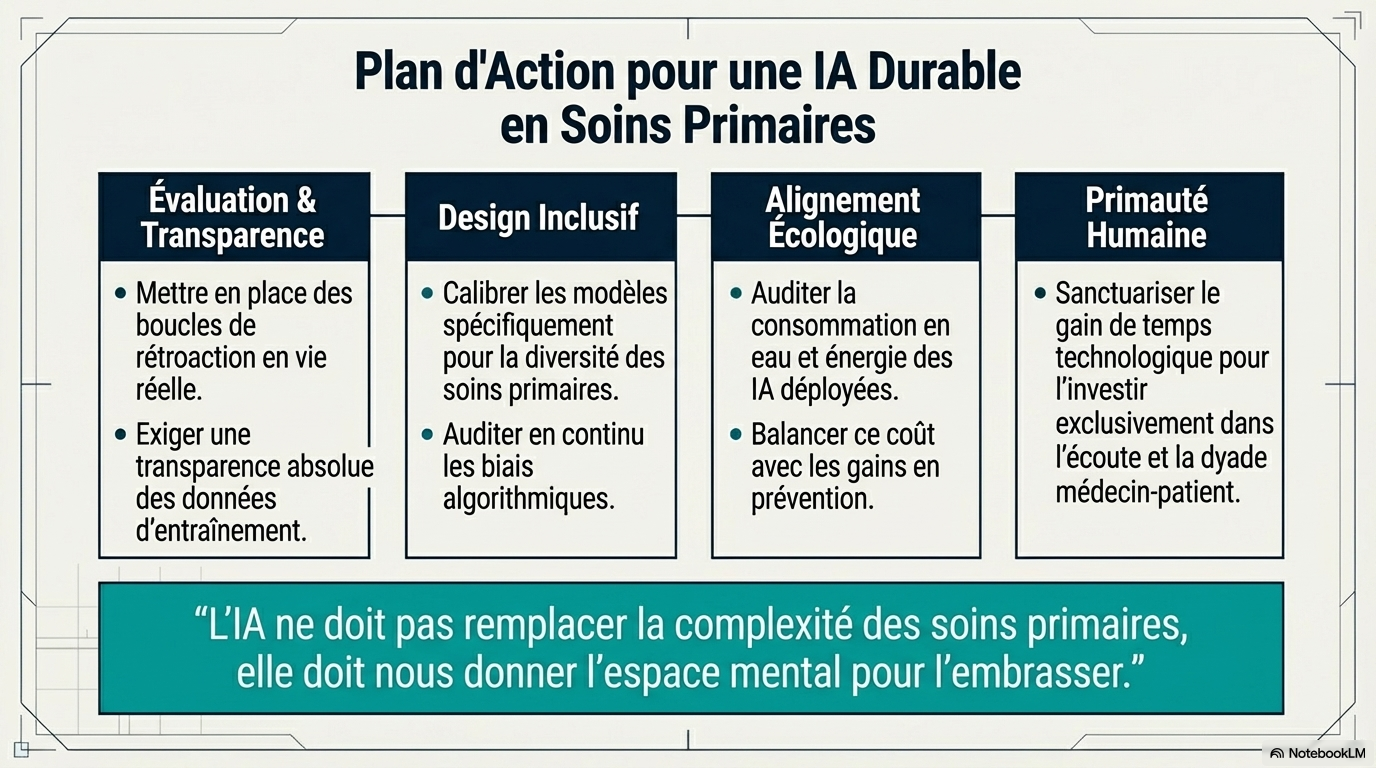

- Réglementation : Les modèles traditionnels de régulation ne sont pas adaptés à l'évolution rapide de l'IA. De nouveaux paradigmes de surveillance continue post-déploiement sont nécessaires.

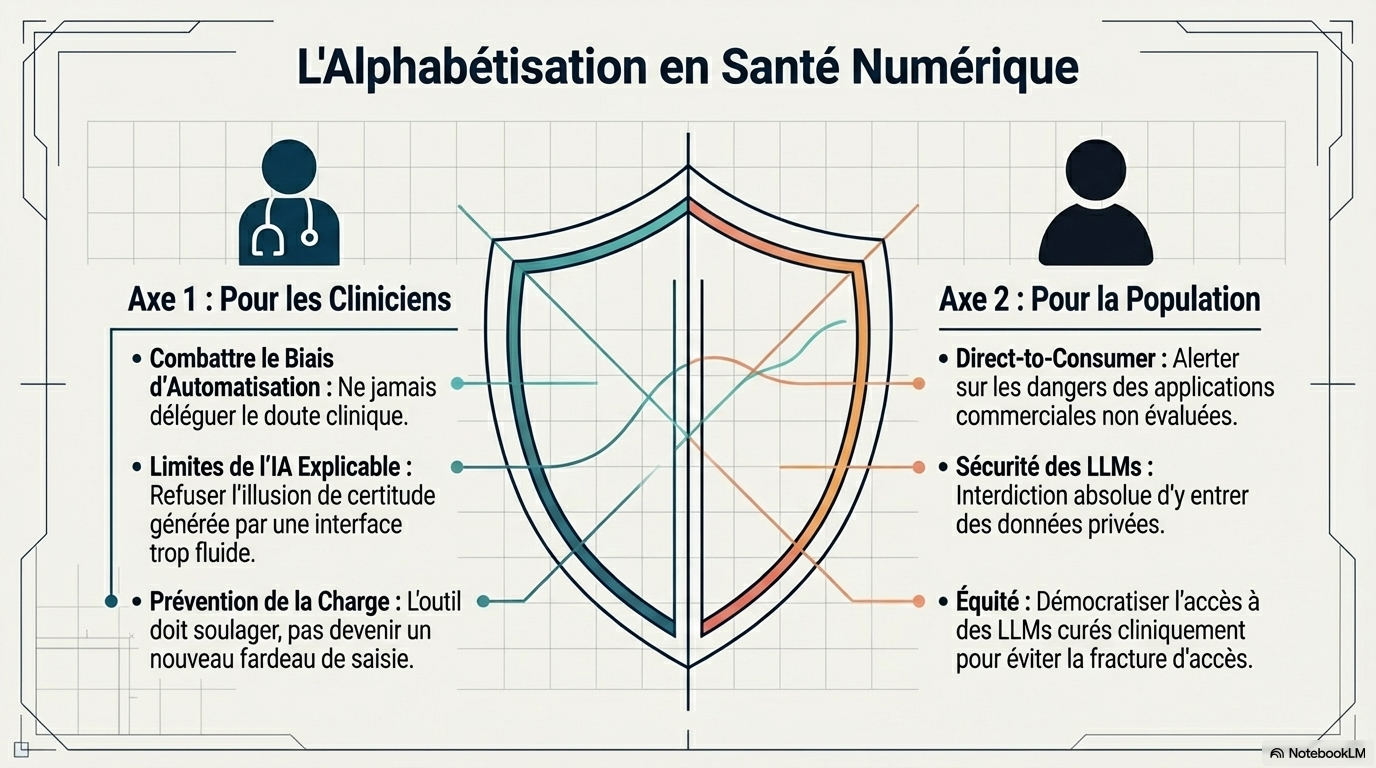

- Littératie en santé IA : Il est impératif de former les cliniciens et le grand public à naviguer entre les bénéfices et les risques de ces outils.

- Transparence : Le problème de la "boîte noire" (incapacité à expliquer le raisonnement de l'IA) doit être adressé pour garantir la sécurité clinique.

- Partenariats multisectoriels : Une collaboration entre l'industrie, l'université, les gouvernements et les patients est essentielle pour une mise en œuvre responsable.

AFFAIRE à suivre...

https://dumas.ccsd.cnrs.fr/dumas-04918701v1/file/sid-ahmed_corvellecMED24.pdf

IA en médecine : la pause réflexive comme exigence éthique du soin

- Guillaume Massol

"Le raisonnement clinique authentique est un acte exclusivement humain."

"Au fond, l’IA pourra sans doute toujours mieux savoir que nous, plus vite, plus froidement, mais elle ne saura jamais mieux douter, et c’est dans ce doute que réside la sagesse médicale, celle qui préserve l’humilité du soignant et l’humanité du soin : celle qui sait que soigner, c’est parfois différer la réponse, pour accueillir ce que le protocole ne prévoit pas."

https://www.revmed.ch/revue-medicale-suisse/2025/revue-medicale-suisse-922/ia-en-medecine-la-pause-reflexive-comme-exigence-ethique-du-soin

IA er tanté ; enjeux et risques

"La relation médecin-patient reste au cœur des préoccupations éthiques. Le professionnel de santé doit informer son patient de l'utilisation d'une IA et conserver le droit de refuser ses recommandations. Le principe de « human oversight » (supervision humaine) est d'ailleurs reconnu dans l'article 14 du RIA.

En cas d'erreur impliquant une IA, la responsabilité revient généralement à celui qui maîtrise le processus de soins (médecin, pharmacien ou directeur d'établissement). Cette clarification apaise la crainte principale des patients : voir la machine imposer un diagnostic sans intervention humaine.

En effet, les décisions finales appartiennent aux équipes et aux médecins ; ChatGPT n’intervient qu’en appui documentaire (mise en forme d’informations, rappel de connaissances), mais pas en décision de traitement."

https://www.medecindirect.fr/blog/ia-et-sante-enjeux-et-risques