- "Le véritable signe de l'intelligence, ce n'est pas la connaissance, mais l'imagination. "

- " L'intelligence artificielle ne fait pas le poids face à la stupidité naturelle. "

- " L'intelligence n'est pas la capacité de stocker des informations, mais de savoir où les trouver. "

Hors Série — ARISE 2026 — L’IA clinique a grandi. Les systèmes de santé, pas encore.

https://www.linkedin.com/pulse/hors-s%C3%A9rie-arise-2026-lia-clinique-grandi-les-de-sant%C3%A9-reichardt-6xgye/

✍️ ÉDITO — Encore un hors-série… et ce n’est pas un hasard

Oui, c’est encore un hors-série. Et non, ce n’est pas un accident de calendrier.

En attendant le Numéro 4, consacré à « IA & sommeil – la fête du SLEEP », avec deux grandes interviews vidéo exclusives prévues la semaine prochaine, il nous semblait indispensable de marquer un temps d’arrêt.

Pourquoi ? Parce que le rapport ARISE – State of Clinical AI 2026 vient de sortir. 130 pages. Denses. Rigoureuses. Sans langue de bois.

State of Clinical AI Report 2026 :

https://www.arise-ai.org/report

Un document qui fera date pour toutes celles et ceux qui travaillent — sérieusement — sur l’IA en santé.

👉 Et avant d’entrer dans le fond, un immense merci :

- Nous passons aujourd’hui la barre des 4 000 abonnés 🎉

- Depuis sa création, la newsletter a généré plus de 100 000 impressions.

- Notre hors-série sur la situation en pharma a même été relayé dans un article de Libération

Ce succès est collectif. Merci pour vos lectures, vos partages, vos débats — et parfois vos désaccords.

C’est exactement pour cela que cette newsletter existe.

📘 ARISE 2026 — Le rapport le plus sérieux de l’année sur l’IA clinique (en même temps c'est le premier )

Le State of Clinical AI Report 2026, publié par le réseau ARISE (Stanford / Harvard / NEJM AI / BMJ Digital Health & AI), n’est ni un rapport marketing, ni une prophétie techno-solutionniste.

C’est un travail de synthèse critique, fondé sur :

- des centaines d’études revues

- des benchmarks cliniques exigeants

- une lecture réaliste des usages, des risques et des angles morts

Son message central est limpide : l'IA clinique a explosé en capacité… mais pas encore en impact réel sur les soins.

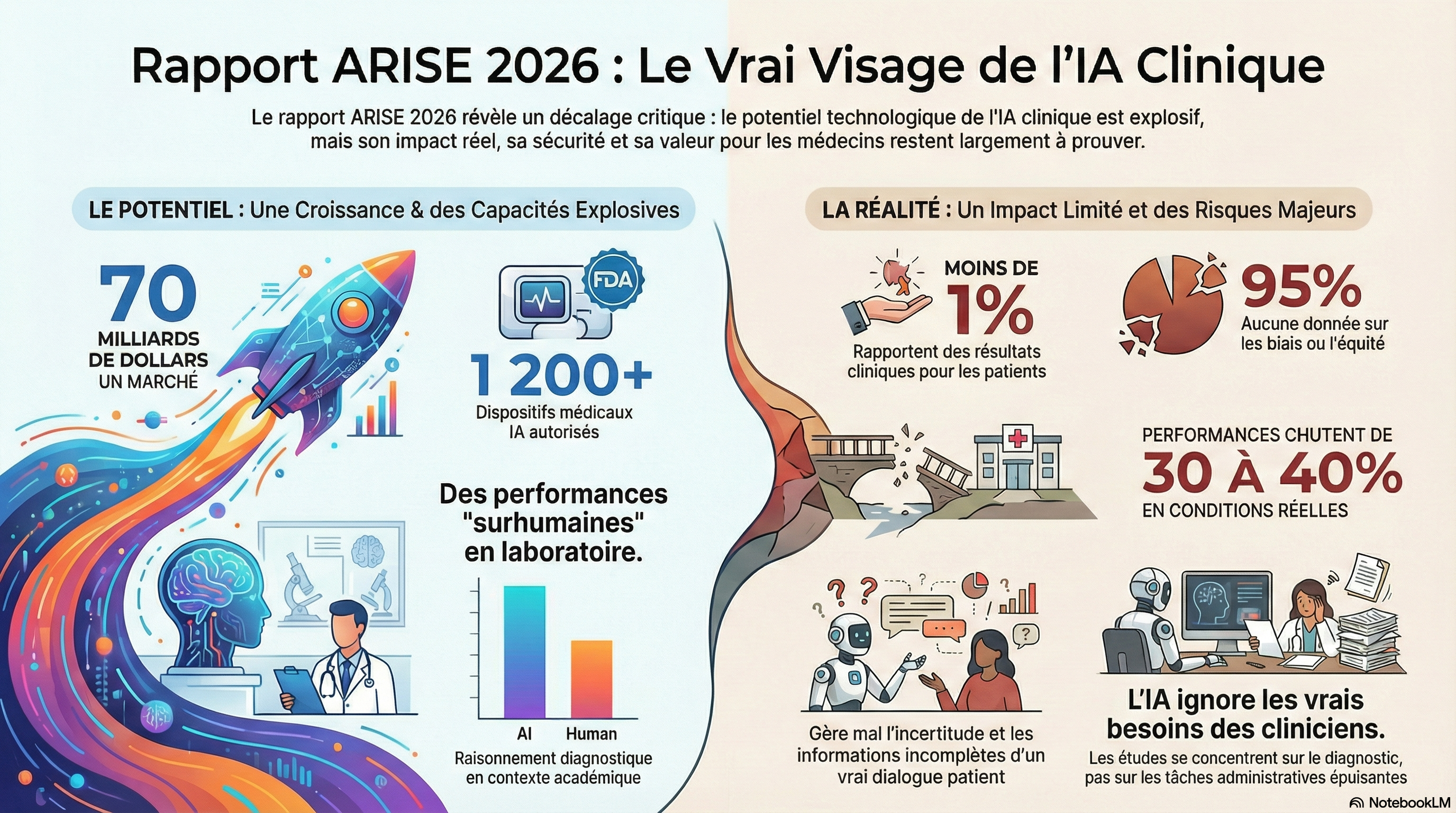

🔢 Un marché en hypercroissance…… mais mal évalué

Quelques chiffres qui donnent le vertige — et qui interrogent :

- 1 200+ dispositifs médicaux IA déjà autorisés (FDA)

- 350 000+ applications santé grand public

- Un marché estimé à 70 milliards de dollars

- Moins de 1 % des dispositifs rapportent des résultats cliniques patients

- 95 % ne documentent ni biais, ni équité, ni données démographiques

👉 Autrement dit : L’IA est partout dans les systèmes de santé… mais la preuve de sa valeur reste largementinsuffisante.e

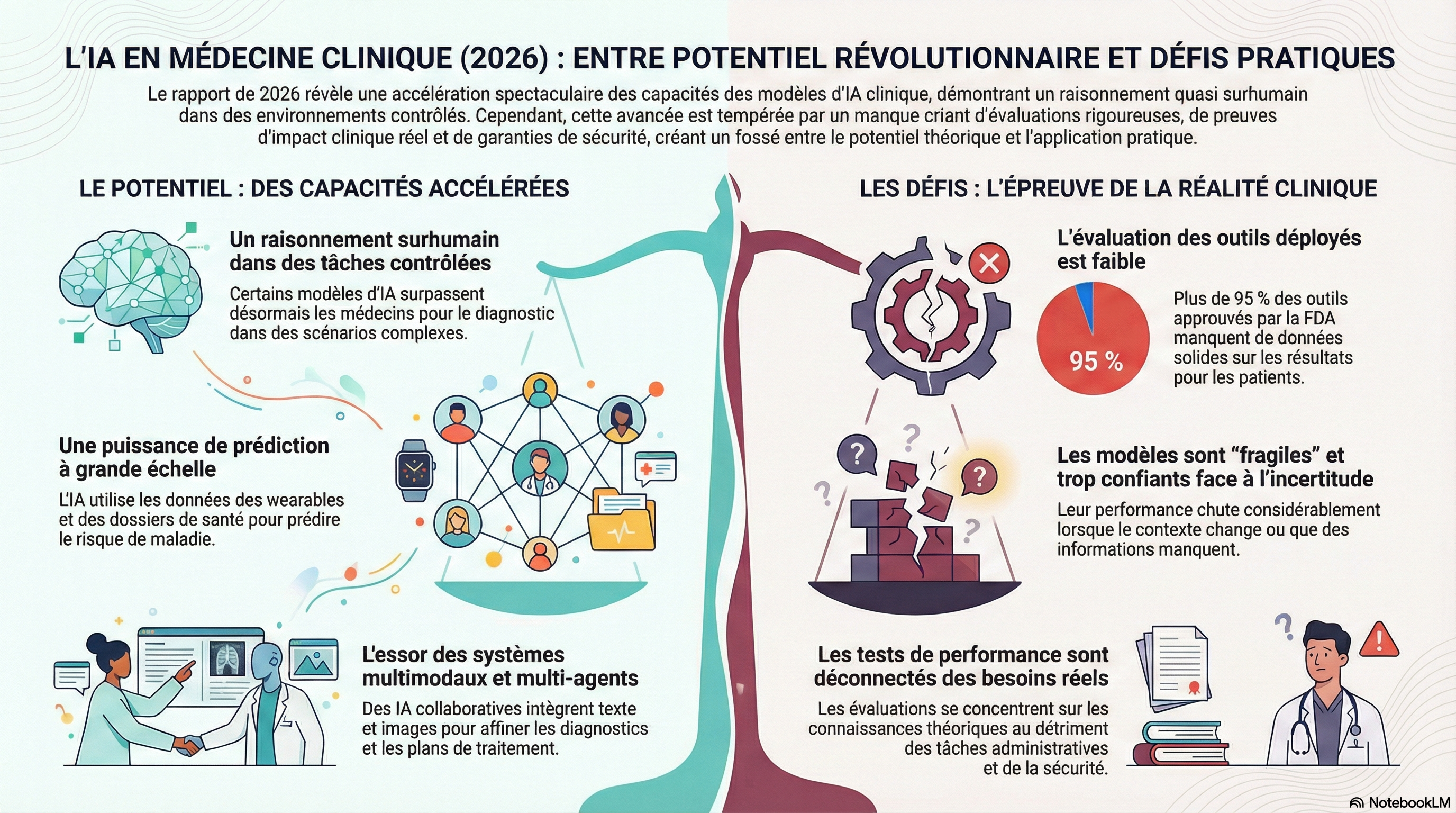

🧠 Des modèles parfois «superhumainss »… dans des contextes irréalistes

Le rapport montre que les LLM de nouvelle génération atteignent — et parfois dépassent — les médecins sur :

- le raisonnement diagnostique complexe

- la gestion de cas académiques (type NEJM CPC)

- la priorisation de tests ou d’hypothèses

Mais il pointe aussi des failles structurelles majeures :

⚠️ 1. Une sur-confiance dangereuse

Les modèles :

- reconnaissent mal l’incertitude

- sur-surenchérissent dans leurs réponses

- échouent quand l’information est incomplète ou changeante

⚠️ 2. Des performances qui s’effondrent en conditions réelles

Dès qu’on passe :

- du QCM à la conversation

- du cas figé au dialogue multi-tours

- du savoir à l’action clinique

👉 Les performances chutent parfois de 30 à 40 %.

👩⚕️👨⚕️ Ce que les cliniciens veulent vraiment (et qui est peu étudié)

L’un des apports majeurs du rapport ARISE est de rappeler une évidence trop souvent oubliée :

Les cliniciens ne demandent pas une IA qui “raisonne mieux qu’eux”, mais une IA qui leur fait gagner du temps sans créer de nouveaux risques.

Or aujourd’hui :

- 45 % des études évaluent des QCM médicaux

- <1 % portent sur la facturation, le codage, les autorisations préalables, la coordination

- Les tâches administratives, pourtant responsables de l’épuisement professionnel, sont massivement sous-évaluées

👉 Le vrai gisement de valeur est là. Pas (encore) dans l’IA omnisciente.

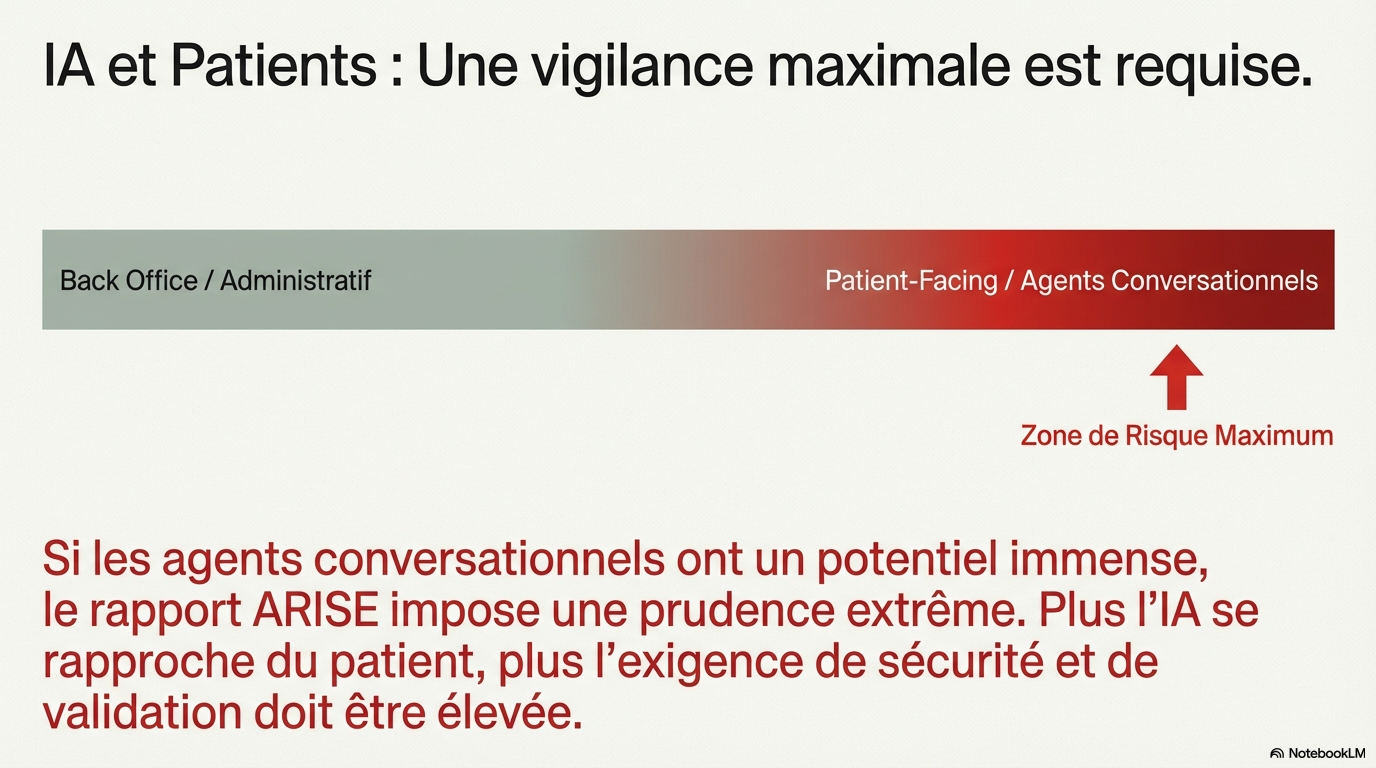

🧍♂️🤖 IA et patients : potentiel immense, vigilance maximale

Le rapport est particulièrement prudent sur l’IA patient-facing :

- Oui, les agents conversationnels peuvent :

- Mais :

👉 En clair : plus l’IA se rapproche du patient, plus l’exigence de sécurité doit être élevée.

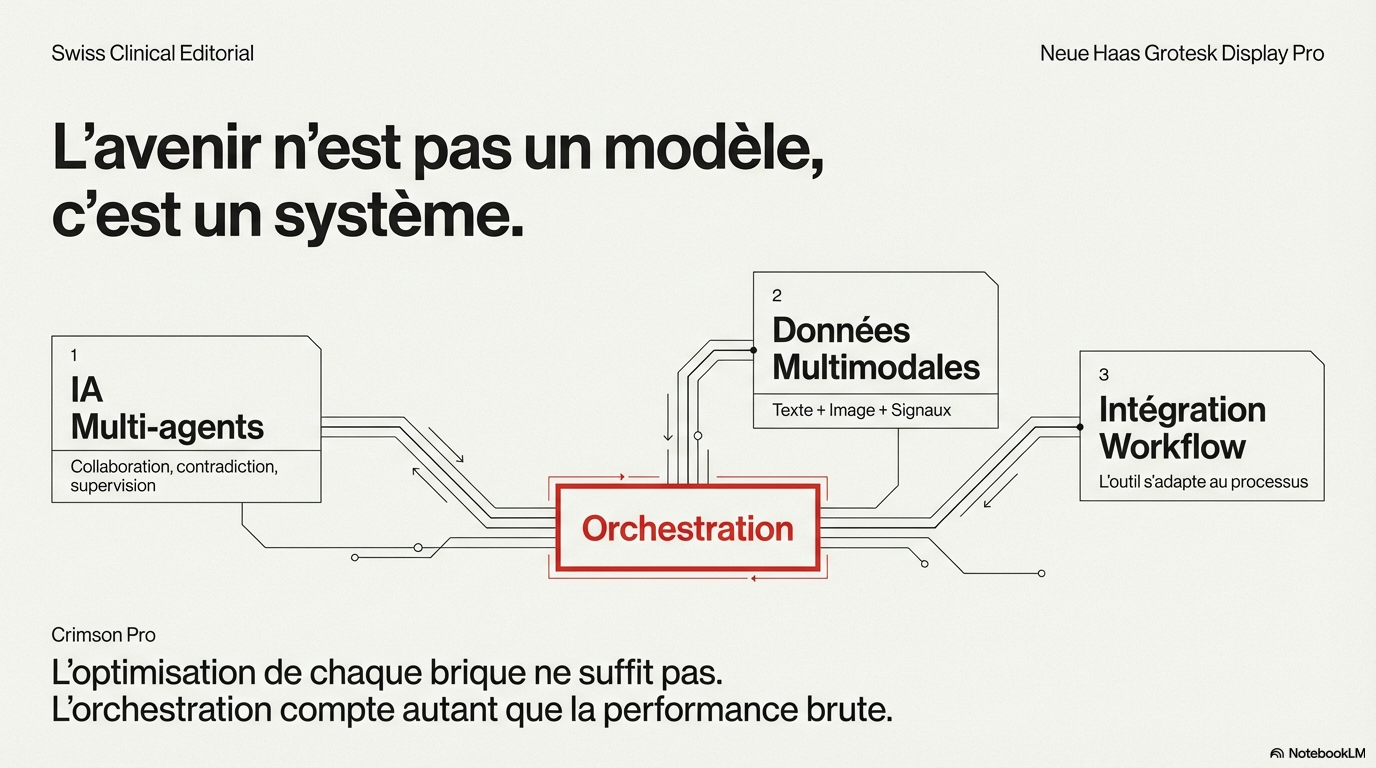

🧩 L’avenir n’est pas un modèle… mais des systèmes

Autre enseignement clé d’ARISE : le avenir de l’IA clinique ne sera pas monolithique.

Les systèmes les plus prometteurs combinent :

- modèles de raisonnement

- IA multi-agents (collaboration, contradiction, supervision)

- données multimodales (texte, image, signaux, wearables)

- intégration fine dans les workflows existants

Mais le rapport alerte aussi sur un paradoxe fondamental :

Optimiser chaque brique ne garantit pas un système clinique sûr et efficace.

L’orchestration compte autant que la performance brute.

🧭 CE QUE NOUS DIT ARISE, AU FOND

En tant qu’expert en santé digitale et IA en santé, ma lecture est la suivante :

- Nous avons franchi un cap technologique

- Nous n’avons pas encore franchi le cap organisationnel, clinique et éthique

- Le vrai enjeu n’est plus « est-ce que l’IA peut ? »

- Mais : où, quand, pour qui, et sous quelles conditions doit-elle être utilisée

L’IA ne sauvera pas des systèmes de santé à bout de souffle. Mais bien conçue, bien évaluée et bien gouvernée, elle peut éviter qu’ils ne s’effondrent

🔔 CONCLUSION — À suivre, à partager… et àdébattre.e

📌 Si ces sujets vous intéressent :

- Suivez #IAtus, pour une vision narrative et incarnée de ces sujets - "Je suis une IA..."

- Suivez #IAtrogénique, pour les angles critiques et les zones grises

- Partagez, likez, commentez : le débat est aussi important que la technologie

🛌 La semaine prochaine : Numéro 4 — IA&sommeil : la fête du SLEEP

Un numéro qui j'espère, vous plaira à l'occasion de la mise en ligne d'un nouveau site dédié au sommeil et de la publication d'une très belle étude publiée dans Nature Medicine montrant qu’un modèle d’IA multimodal, entraîné sur des centaines de milliers d’heures de polysomnographie, peut prédire le risque de plus de 130 maladies à partir d’une seule nuit de sommeil - à cette occasion deux interviews vidéo inédites sur le sommeil, les données, les usages réels… et les promesses (ou illusions) de l’IA.

À très vite, et encore merci de faire vivre cette communauté.

SYNTHESE / NOTEBOOKLM

"Ce document présente une analyse approfondie du rapport ARISE 2026, une étude de référence consacrée à l'intégration de l'intelligence artificielle dans le milieu clinique. Bien que les outils technologiques progressent rapidement, l'auteur souligne un décalage flagrant entre les capacités techniques des modèles et leur impact réel sur la santé des patients. Les données révèlent que la majorité des dispositifs manquent de preuves cliniques concrètes et de transparence concernant les biais algorithmiques. Le texte insiste sur le fait que les médecins recherchent avant tout un gain de temps administratif plutôt qu'une substitution de leur raisonnement médical. En conclusion, l'avenir de cette technologie repose sur une gouvernance éthique et une intégration fluide dans les flux de travail plutôt que sur la simple performance brute."

"Quels sont les principaux obstacles limitant l'impact réel de l'intelligence artificielle

clinique ?

De plus, 95 % de ces dispositifs ne documentent pas les questions de biais, d'équité ou de données démographiques

L'optimisation technique d'un modèle ne garantit pas un système de santé sûr ; l'intégration dans les flux de travail (workflows) et la gouvernance globale sont tout aussi cruciales que la performance brte

Quels sont les risques majeurs d'une IA interagissant directement avec les patients ?

Cette instabilité est critique pour une interaction directe avec un patient.

Prédictions pour l'IA clinique en 2026 (rapport ARISE)

-

Premier procès pour faute professionnelle : nous connaîtrons le premier procès pour faute médicale où l'IA aura joué un rôle déterminant dans l'erreur.

-

Généralisation des agents d'IA pour les soins urgents : les agents d'IA destinés aux soins non programmés deviendront courants et seront proposés par un nombre croissant de réseaux de santé.

-

Intégration du marquage des données : les systèmes d'étiquetage et de classification des données cliniques seront directement intégrés aux flux de travail réels des praticiens.

-

Course aux armements entre systèmes de santé et assureurs : Les hôpitaux et les assureurs se livreront une guerre de "bots" pour gérer les autorisations préalables, les refus de remboursement et l'optimisation du codage. Un duel technologique sans bénéfice net pour personne, sauf pour les fournisseurs de ces outils.

-

Stagnation réglementaire de la FDA : la FDA explorera de nouveaux mécanismes de régulation pour les produits d'IA générative, mais aucun progrès significatif ne sera concrétisé.

-

IA vs Humains pour le conseil médical : Davantage de personnes recevront des thérapies, un soutien psychologique ou des conseils de la part d'une IA plutôt que d'un être humain.

-

Domination des notes cliniques par l'IA (>90 %) : Plus de 90 % du texte des notes cliniques sera généré par IA (via des outils d'écoute ambiante) ; il deviendra difficile de savoir ce que le clinicien a réellement pensé de ses cas.

-

Résultats des déploiements prospectifs : Nous verrons enfin les résultats des déploiements réels des systèmes d'aide à la décision clinique (CDS) basés sur l'IA dans les flux de travail quotidiens.

-

Supériorité des modèles "Frontier" : les modèles d'IA de pointe continueront de surpasser les humains lors des tests de référence (benchmarks). La recherche se concentrera désormais sur la collaboration homme-machine.

-

Croissance et expansion du marché des "Scribes" : Le marché des assistants de saisie (scribes) continuera de croître. Leurs capacités s'étendront pour inclure la gestion des tâches administratives découlant de la consultation.

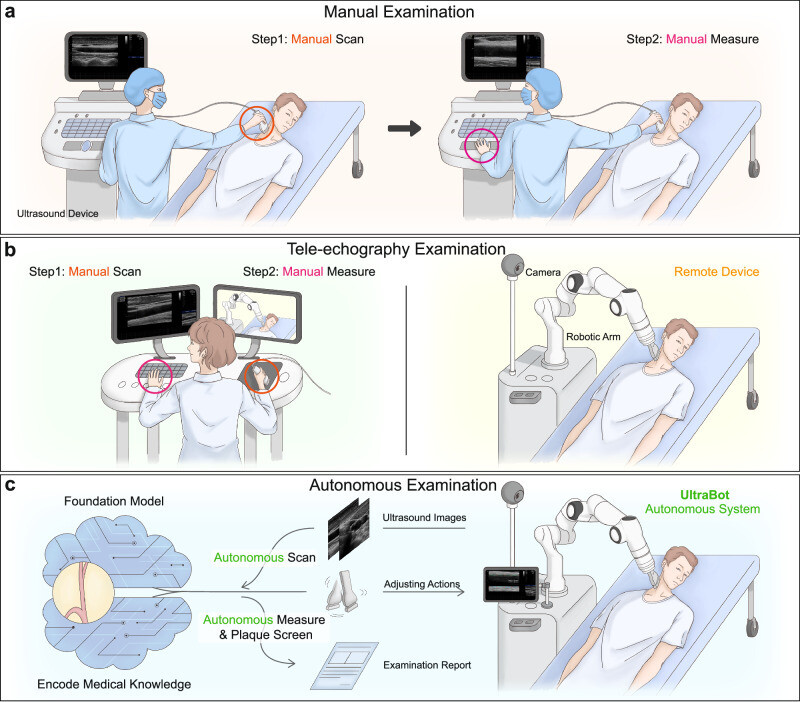

Autre prédiction selon ARISEUn robot d'échographie carotidienne entièrement autonome égalant les échographistes experts

UltraBot est un système robotique à grande échelle piloté par l'apprentissage par imitation. Il réalise de manière autonome des échographies carotidiennes complètes (balayage, mesures et détection de plaques) en s'appuyant sur un jeu de données de 247 000 échantillons de démonstration d'experts. Lors de validations cliniques sur de nouveaux patients, il a atteint un taux de réussite de balayage supérieur à 90 %, une précision de mesure de niveau expert et une reproductibilité nettement supérieure à celle des échographistes humains.

-

Apprentissage par l'exemple : Le système a appris les mouvements de la sonde à partir de 247 000 exemples d'images et d'actions enregistrés auprès de véritables échographistes.

-

Performance clinique : Il a validé avec succès plus de 90 % des tâches de balayage sur de nouveaux patients présentant des morphologies variées et des pathologies carotidiennes diverses.

-

Précision et fiabilité : Les mesures effectuées par le robot ont montré une reproductibilité 5,5 fois supérieure et une variation significativement plus faible que celles des échographistes humains sur des populations diversifiées, notamment pour des indicateurs tels que l'épaisseur intima-média carotidienne.

-

Potentiel clinique : Le "Deep Learning" à grande échelle s'avère prometteur pour une échographie autonome de haute précision en pratique clinique courante.

MAIS que de temps perdus par rapport à l'humain, de plus à quel coût ?

Le robt échographiste ne me fait pas rêver, loin de là !

Source : Jiang, Huang et al., Nature Communications, août 2025

-