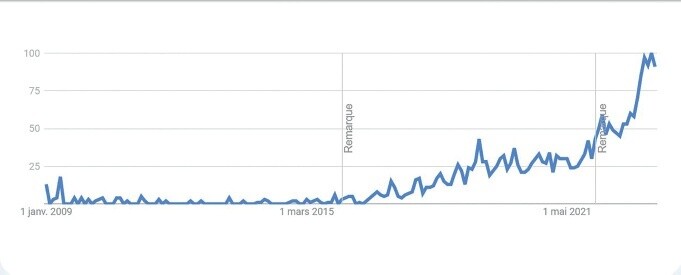

« Déployer une intelligence artificielle éthique sera l’enjeu du siècle qui vient » Jérémy Harroch

"ChatGPT est comme un Shadok qui pompe : il calcule, sans en saisir le sens"

Sylvain Montmory

« L’intelligence de la machine est la dernière invention que l’humanité aura besoin de faire. » Nick Bostrom,

https://jamanetwork.com/journals/jama/fullarticle/2827434?guestAccessKey=f647dabb-4b10-45df-b743b8988ec3c679&utm_source=silverchair&utm_campaign=jama_network&utm_content=article_alert-jama_ai_a&utm_medium=email&adv=000003242730

Article libre d'accès

"Article in extenso"

Alors que les outils intégrant l’intelligence artificielle (IA) font rapidement leur entrée dans la pratique clinique, les mécanismes permettant de garantir leur sécurité et leur efficacité restent sous-développés.

Par exemple, les établissements de santé et les cliniciens disposent de peu de conseils pour s’y retrouver dans les complexités de la mise en œuvre de l’IA dans les soins de routine.

Pour garantir que l’intégration de systèmes basés sur l’IA dans les soins de santé transforme la prise de décision clinique et améliore les résultats pour les patients, les risques connus et inconnus de l’IA doivent être atténués.

Les premières applications d’IA basées sur l’apprentissage automatique ont montré des dérives de modèle, des erreurs algorithmiques, des biais involontaires et un surajustement, entraînant une diminution de la précision, des erreurs de classification ou de prédiction et une capacité réduite à généraliser.

Les applications d’IA générative peuvent rencontrer tous ces problèmes ainsi que des « hallucinations », conduisant à des informations manifestement incorrectes ou difficiles à détecter qui peuvent nuire aux patients.

Dans ce point de vue, nous fournissons des recommandations et des conseils de mise en œuvre aux établissements de santé et aux cliniciens pour faciliter l'utilisation de systèmes basés sur l'IA, y compris l'utilisation de dossiers médicaux électroniques (DME) dotés de fonctionnalités ou de fonctions d'IA améliorées, dans les soins cliniques de routine.

Nous fournissons des recommandations pratiques et exploitables que tous les établissements de santé et cliniciens devraient suivre avant, pendant et après la mise en œuvre de l'IA. Nous avons utilisé une approche sociotechnique pour élaborer ces recommandations, c'est-à-dire en nous concentrant sur les activités techniques et non techniques (telles que les personnes et les processus), similaire à l'approche que nous avons utilisée pour élaborer des directives nationales antérieures pour la mise en œuvre et l'utilisation sûres des DME .

Préparer le terrain grâce à la responsabilité partagée

L’IA est définie comme « un système basé sur une machine qui peut, pour un ensemble donné d’objectifs définis par l’homme, faire des prédictions, des recommandations ou des décisions influençant les environnements réels ou virtuels.

Les systèmes d’IA utilisent des entrées basées sur la machine et l’homme pour percevoir les environnements réels et virtuels ; abstraire ces perceptions dans des modèles par le biais d’une analyse de manière automatisée ; et utiliser l’inférence de modèle pour formuler des options d’information ou d’action ».

Dans de nombreux cas, ces systèmes d’IA s’appuient sur des données provenant de DSE existants ou y sont intégrées.

Les développeurs d’applications compatibles avec l’IA, les fournisseurs de DSE et les établissements de santé utilisant des systèmes compatibles avec l’IA ou des DSE dotés de fonctionnalités ou de fonctions d’IA améliorées partagent la responsabilité (en fonction de leurs capacités et des ressources disponibles) de garantir la sécurité de l’IA.

Cette responsabilité partagée comprend une gouvernance clinique, technique et administrative appropriée, des politiques, des procédures de gestion des risques, des personnes et des technologies pour garantir que l’IA est surveillée et que son utilisation est sûre, sécurisée, efficace, privée, éthique et équitable .

Recommandations préalables à la mise en œuvre

Assurer la qualité des performances de l'IA

Les établissements de santé doivent effectuer ou attendre des évaluations cliniques en situation réelle publiées dans des revues médicales de haute qualité (par exemple, la nouvelle liste des revues cliniquement utiles de la National Library of Medicine [ https://jmla.mlanet.org/ojs/jmla/article/view/1631 ]) avant de mettre en œuvre des systèmes basés sur l'IA dans les soins de routine. Bien qu'une publication évaluée par des pairs ne garantisse pas la sécurité ou l'efficacité d'une intervention clinique ou administrative, elle peut fournir une évaluation externe, indépendante et impartiale du développement, des tests, de la mise en œuvre ou de l'utilisation d'un système, d'un outil ou d'une intervention basés sur l'IA. Alors que ces nouveaux systèmes basés sur l'IA arrivent à maturité, nous recommandons à tous les établissements de santé de procéder à des tests et à une surveillance indépendants en situation réelle avec des données locales afin de minimiser le risque pour la sécurité des patients. Des évaluations itératives doivent accompagner ces tests basés sur les risques pour garantir que les applications basées sur l'IA bénéficient aux patients et aux cliniciens, sont financièrement viables tout au long de leur cycle de vie et respectent les principes éthiques fondamentaux .

Tous les établissements de santé devraient créer un nouveau comité de gouvernance et de sécurité de l’IA ou ajouter des experts en IA, tels que des scientifiques des données, des informaticiens, des spécialistes de l’apprentissage automatique et du personnel opérationnel de l’IA, des experts en facteurs humains et des experts cliniques à leurs comités de surveillance multidisciplinaires existants en matière de DSE ou d’aide à la décision clinique.

Ces personnes, en tant que groupe, devraient être capables de comprendre et d’évaluer les performances des systèmes basés sur l’IA et de créer une structure de gouvernance pour assurer la sécurité. Les membres du comité devraient se réunir régulièrement pour examiner les demandes de nouvelles applications d’IA, examiner les preuves de sécurité et d’efficacité avant la mise en œuvre et créer des processus pour surveiller de manière proactive les performances des applications basées sur l’IA qu’ils prévoient d’utiliser.

Mobiliser les cliniciens et les patients

Avant que les établissements de santé n’utilisent des systèmes basés sur l’IA pour les soins aux patients (par exemple, pour répondre aux messages des patients ou générer des diagnostics différentiels, des plans de traitement ou des notes décrivant les résultats des visites des patients), ils doivent créer des politiques et des procédures pour garantir que les patients et les cliniciens sont conscients, lorsque cela est possible, que les systèmes basés sur l’IA sont utilisés pour la prise de décisions cliniques et administratives .

Recommandations pendant et après la mise en œuvre

Enregistrement et surveillance des performances de l'IA

Le comité d'IA doit tenir à jour un inventaire des systèmes d'IA déployés en clinique, avec des informations de suivi complètes.

Les éléments à suivre doivent inclure la date de déploiement, la version actuelle, le personnel responsable, la date de la dernière révision, les utilisateurs autorisés, l'objectif autorisé, la source des données utilisées pour générer ou former le système d'IA, et les sources externes de validation, de vérification et de comparaison des performances. Les HCO doivent tenir à jour et examiner régulièrement un journal des transactions de l'utilisation du système d'IA (similaire au journal d'audit du DSE) qui comprend la version de l'IA utilisée, la date/heure d'utilisation du système d'IA, l'identifiant du patient, l'identifiant de l'utilisateur clinique responsable, les données d'entrée utilisées par le système d'IA et la recommandation ou la sortie de l'IA. Les HCO doivent développer un processus interne pour évaluer les performances du système activé par l'IA sur les données locales avant l'utilisation clinique de routine et évaluer périodiquement la mise en œuvre pour vérifier la dérive, le biais ou la dégradation. Le comité doit superviser les tests continus des applications d'IA dans le système de production en direct pour garantir la sécurité des performances et de l'utilisation de ces programmes.

Mobiliser les cliniciens et les patients

Les établissements de santé devraient créer des programmes de formation de haute qualité pour les cliniciens intéressés par l’utilisation des systèmes d’IA, ce qui inclut la sensibilisation aux risques connus et potentiels qui pourraient survenir avec l’utilisation de l’IA.

La formation initiale et l’engagement ultérieur des cliniciens devraient inclure un processus formel de type consentement, avec signatures, pour garantir que les cliniciens comprennent les risques et les avantages de l’utilisation des outils d’IA avant que leur accès ne soit autorisé. En outre, des mesures doivent être prises pour garantir que les patients comprennent quand et où les systèmes basés sur l’IA ont été développés, comment ils peuvent être utilisés et le rôle des cliniciens dans l’examen des résultats du système d’IA avant de donner leur consentement. 5 Les recommandations générées par l’IA doivent être examinées et approuvées par des humains, qui peuvent assumer la responsabilité de la ou des recommandations avant qu’elles ne soient envoyées aux patients.

Les établissements de santé devraient élaborer un processus clair permettant aux patients et aux cliniciens de signaler les problèmes de sécurité liés à l’IA et mettre en œuvre un processus rigoureux et multidisciplinaire pour analyser ces problèmes et atténuer les risques. Les établissements de santé devraient également participer à des systèmes nationaux de surveillance post-commercialisation qui regroupent des données de sécurité anonymisées à des fins d’analyse et de reporting. 6 Cela obligerait les établissements de santé à signaler un sous-ensemble d’informations anonymisées et standardisées à un référentiel national, tel que le Réseau de bases de données sur la sécurité des patients, qui décrit la nature sociotechnique du problème de sécurité, y compris les détails techniques et non techniques sur l’événement, le système d’IA impliqué, les facteurs contributifs et l’impact sur les soins aux patients ou l’établissement de santé.

Anticiper et atténuer les risques post-mise en œuvre

Les établissements de santé doivent fournir des instructions écrites claires et donner l’autorisation au personnel autorisé de désactiver, d’arrêter ou de désactiver les systèmes d’IA 24 heures sur 24, 7 jours sur 7, en cas de dysfonctionnement urgent.

De la même manière qu’une organisation se prépare à une période d’indisponibilité du DSE, les établissements de santé doivent avoir établi des politiques et des procédures pour gérer de manière transparente les processus cliniques et administratifs qui sont devenus dépendants de l’automatisation de l’IA lorsque celle-ci n’est pas disponible. Enfin, les établissements de santé doivent évaluer régulièrement l’impact de leurs systèmes d’IA sur les résultats des patients, les flux de travail des cliniciens et la qualité à l’échelle du système. Si les systèmes d’IA ne répondent pas aux objectifs de pré-implémentation, les modèles d’IA doivent être révisés ou l’ensemble du système doit être mis hors service si les améliorations ne sont pas réalisables.

Conclusions

À mesure que les établissements de santé adaptent leurs flux de travail cliniques et administratifs aux nouvelles technologies axées sur l’IA, des conséquences néfastes imprévues se produiront inévitablement, en particulier lors des transitions. Pour faire face à ces risques, les établissements de santé et les développeurs d’IA/DSE doivent collaborer pour garantir la robustesse, la fiabilité et la transparence des systèmes d’IA. Les établissements de santé doivent élaborer de manière proactive des programmes d’assurance de la sécurité de l’IA qui s’appuient sur les principes de responsabilité partagée, mettre en œuvre une approche multidimensionnelle pour aborder la mise en œuvre de l’IA, surveiller l’utilisation de l’IA et impliquer les cliniciens et les patients. La surveillance des risques est essentielle pour maintenir l’intégrité du système, donner la priorité à la sécurité des patients et garantir la sécurité des données. Les recommandations fournies ici identifient et atténuent ces risques, renforcent la confiance entre les utilisateurs et les parties prenantes et favorisent une adoption sûre et efficace de l’IA dans les soins de santé.

Auteur correspondant : Dean F. Sittig, PhD, Département d'informatique clinique et de santé, McWilliams School of Biomedical Informatics, University of Texas Health Sciences Center, 6410 Fannin St, UTPB 1100.43, Houston, TX 77030 (

Publié en ligne : 27 novembre 2024. doi:10.1001/jama.2024.24598

Commentaire

Article très intéressant , l'IA comme tous les outils informatique nécessitent d'être encadrée. En matière de santé la sécurité des données est notamment un point majeur dans cette réflexion. L'éthique par rapport aus données doit être respectée.

L'avis de GEMINI/IA

Recommandations pour garantir la sécurité de l'IA dans les soins cliniques

L'intégration de l'intelligence artificielle (IA) dans le domaine des soins cliniques présente un potentiel immense pour améliorer la précision des diagnostics, personnaliser les traitements et optimiser la gestion des patients.

Cependant, cette révolution technologique soulève également des préoccupations majeures en matière de sécurité. Pour exploiter pleinement les avantages de l'IA tout en minimisant les risques, il est essentiel de mettre en place un cadre rigoureux de recommandations.

Principales recommandations :

-

Transparence et explicabilité:

- Modèles interprétables: Privilégier des modèles d'IA dont les décisions peuvent être expliquées et justifiées, afin de permettre aux professionnels de santé de comprendre les raisons sous-jacentes à une recommandation.

- Documentation détaillée: Maintenir une documentation complète des algorithmes, des données utilisées et des processus de développement, facilitant ainsi la vérification et l'audit.

-

Qualité des données:

- Données représentatives: S'assurer que les données utilisées pour entraîner les modèles d'IA sont de haute qualité, représentatives de la population cible et exemptes de biais.

- Nettoyage et validation: Mettre en place des processus rigoureux de nettoyage et de validation des données pour éliminer les erreurs, les incohérences et les valeurs aberrantes.

-

Validation et évaluation:

- Tests rigoureux: Soumettre les modèles d'IA à des tests rigoureux avant leur déploiement en environnement clinique, en évaluant leur performance sur des jeux de données indépendants.

- Surveillance continue: Mettre en place des systèmes de surveillance continue pour détecter d'éventuelles dégradations des performances ou des biais émergents.

-

Sécurité des données:

- Protection des données personnelles: Respecter les réglementations en vigueur en matière de protection des données personnelles et mettre en œuvre des mesures de sécurité robustes pour prévenir les fuites et les accès non autorisés.

- Anonymisation des données: Anonymiser les données au maximum tout en préservant leur utilité pour l'entraînement des modèles.

-

Collaboration entre les professionnels de la santé et les informaticiens:

- Équipe multidisciplinaire: Former des équipes multidisciplinaires réunissant des professionnels de la santé, des informaticiens et des experts en éthique pour collaborer à toutes les étapes du développement et du déploiement des systèmes d'IA.

- Transfert de connaissances: Faciliter le transfert de connaissances entre les différentes disciplines pour garantir une compréhension mutuelle des enjeux et des besoins.

-

Éthique et responsabilité:

- Enjeux éthiques: Identifier et adresser les enjeux éthiques liés à l'utilisation de l'IA dans les soins cliniques, tels que la discrimination, la responsabilité en cas d'erreur et l'autonomie du patient.

- Responsabilité humaine: Préserver le rôle central du professionnel de santé dans la prise de décision et ne pas déléguer entièrement cette responsabilité à l'IA.

-

Réglementation et certification:

- Cadre réglementaire clair: Développer un cadre réglementaire clair et adapté à l'évolution rapide des technologies d'IA, tout en favorisant l'innovation.

- Certification des systèmes d'IA: Mettre en place des processus de certification pour garantir la qualité, la sécurité et la conformité des systèmes d'IA utilisés en milieu médical.

En résumé

la sécurité de l'IA dans les soins cliniques repose sur une approche multidimensionnelle qui intègre des considérations techniques, éthiques et réglementaires. En suivant ces recommandations, il est possible de tirer pleinement parti du potentiel de l'IA pour améliorer la qualité des soins tout en préservant la sécurité des patients.

ETHIQUE SUITE par PERPLEXITY/IA

L'éthique de l'intelligence artificielle (IA) est un domaine qui étudie les valeurs, principes et règles devant guider le développement et l'utilisation de l'IA de manière responsable et bénéfique pour la société. Elle vise à garantir que les systèmes d'IA respectent la dignité humaine, les droits fondamentaux, et contribuent au bien commun

Principes clés de l'éthique de l'IA

Respect des droits humains: Les systèmes d'IA doivent être conçus et utilisés dans le respect des droits fondamentaux et de la dignité humaine

.Équité et non-discrimination: L'IA doit être développée et déployée de manière à éviter les biais injustes et la discrimination

.Sécurité et fiabilité: Les systèmes d'IA doivent être robustes, sûrs et capables de gérer les erreurs de manière appropriée

.Respect de la vie privée: La protection des données personnelles et le contrôle des individus sur leurs informations sont essentiels

.Responsabilité: Des mécanismes doivent être mis en place pour garantir la responsabilité des développeurs et utilisateurs de l'IA

Importance de l'éthique dans l'IA

L'éthique de l'IA est cruciale pour plusieurs raisons:

- Elle permet de s'assurer que l'IA bénéficie à l'humanité plutôt que de lui nuire.

- Elle aide à établir la confiance du public dans les technologies d'IA.

- Elle guide les développeurs et les entreprises dans la création de systèmes d'IA responsables.

- Elle contribue à prévenir les utilisations abusives ou dangereuses de l'IA.

En définitive, l'éthique de l'IA vise à créer un cadre qui maximise les avantages de l'IA tout en minimisant ses risques potentiels pour la société

A LIRE

L’éthique de l’intelligence artificielle dans l’expérience client

"L’éthique dans l’IA n’est pas une considération ponctuelle ; c’est un engagement permanent. Les entreprises doivent mettre en œuvre des mécanismes de contrôle continu pour suivre les performances des systèmes d’IA, identifier les problèmes potentiels et procéder aux ajustements nécessaires. Des audits réguliers, des cycles de retour d’information et des améliorations itératives sont essentiels pour garantir que les expériences client basées sur l’IA restent éthiques et efficaces."

https://fr.diabolocom.com/blog/ethique-intelligence-artificielle-experience-client/

Pages 9 à 27

https://shs.cairn.info/revue-reseaux-2023-4-page-9?lang=fr

Les enjeux éthiques de l'IA en 2024

https://www.upmynt.com/les-enjeux-ethiques-de-ia/

https://www.upmynt.com/les-enjeux-ethiques-de-ia/

Copyright : Dr Jean Pierre Laroche / 2024