"Je ne vois pas que l'intelligence humaine est quelque chose que les humains ne peuvent jamais comprendre." John McCarthy, mars 1989

“L’intelligence est, hélas ! toujours une énigme, mais pas plus que la bêtise...” Alan Turing

“Les tentatives de création de machines pensantes nous seront d’une grande aide pour découvrir comment nous pensons nous-mêmes.” Alan Turing , 1951

Haug CJ, Drazen JM. Artificial Intelligence and Machine Learning in Clinical Medicine, 2023. N Engl J Med. 2023 Mar 30;388(13):1201-1208. doi: 10.1056/NEJMra2302038. PMID: 36988595.

Intelligence artificielle et apprentissage automatique en médecine clinique, 2023

https://pubmed.ncbi.nlm.nih.gov/36988595/

Un article passionnant et très important que je vous conseille de lire car la médecine et l'IA vont devenir de plus en plus proche. Mais à la condition ques les médecins en restent les maitres d'oeuvre.

Préambule

Un article passionnant et très important que je vous conseille de lire car la médecine et l'IA vont devenir de plus en plus proche. Mais à la condition ques les médecins en restent les maitres d'oeuvre.

Préambule

La paternité du terme « IA » pourrait être attribué à John McCarthy du MIT (Massachusetts Institute of Technology), terme que Marvin Minsky (université de Carnegie-Mellon) définit comme « la construction de programmes informatiques qui s’adonnent à des tâches qui sont, pour l’instant, accomplies de façon plus satisfaisante par des êtres humains car elles demandent des processus mentaux de haut niveau tels que : l’apprentissage perceptuel, l’organisation de la mémoire et le raisonnement critique ».*

La conférence durant l’été 1956 au Dartmouth College (financée par le Rockefeller Institute) est considérée comme fondatrice de la discipline. De manière anecdotique, il convient de relever le grand succès d’estime de ce qui n’était pas une conférence mais plutôt un atelier de travail. Seulement six personnes, dont McCarthy et Minsky, étaient restées présentes de manière constante tout au long de ces travaux (qui s’appuyaient essentiellement sur des développements basés sur de la logique formelle).

https://www.coe.int/fr/web/artificial-intelligence/history-of-ai#:~:text=La%20paternit%C3%A9%20du%20terme%20%C2%AB%20IA,instant%2C%20accomplies%20de%20fa%C3%A7on%20plus

Le fondateur

AM TURING, I.—COMPUTING MACHINERY AND INTELLIGENCE, Mind , Volume LIX, Numéro 236, Octobre 1950, Pages 433–460, https://doi.org/10.1093/mind/LIX.236.433

MACHINES INFORMATIQUES ET RENSEIGNEMENT

https://academic.oup.com/mind/article/LIX/236/433/986238?login=true

https://www.coe.int/fr/web/artificial-intelligence/history-of-ai#:~:text=La%20paternit%C3%A9%20du%20terme%20%C2%AB%20IA,instant%2C%20accomplies%20de%20fa%C3%A7on%20plus

Le fondateur

AM TURING, I.—COMPUTING MACHINERY AND INTELLIGENCE, Mind , Volume LIX, Numéro 236, Octobre 1950, Pages 433–460, https://doi.org/10.1093/mind/LIX.236.433

MACHINES INFORMATIQUES ET RENSEIGNEMENT

https://academic.oup.com/mind/article/LIX/236/433/986238?login=true

Article libre d'accés

Article à lire, publié en 1950

Article à lire, publié en 1950

"Je PROPOSE d'examiner la question : « Les machines peuvent-elles penser ? Cela devrait commencer par des définitions de la signification des termes « machine » et « penser ». Les définitions pourraient être rédigées de manière à refléter autant que possible l'usage normal des mots, mais cette attitude est dangereuse. Si la signification des mots « machine » et « penser » doit être trouvée en examinant comment ils sont couramment utilisés, il est difficile d'échapper à la conclusion que la signification et la réponse à la question : « Les machines peuvent-elles penser ? » est à rechercher dans une enquête statistique comme un sondage Gallup. Mais c'est absurde. Au lieu de tenter une telle définition, je remplacerai la question par une autre, qui lui est étroitement liée et qui s'exprime en termes relativement non ambigus."

Ils ont anticipé !

"Reconnaissant que les machines dans la pratique de la médecine sont là pour rester, les médecins ont l'obligation d'en apprendre le plus possible sur leurs avantages et leurs limites. La machine décrite ici ne fait que corréler les symptômes posés par le patient et tire des conclusions sur la base de ce qu'elle a « appris » des médecins. Par conséquent, il commet les mêmes erreurs que le cerveau humain qui lui a "enseigné" plus d'autres qui sont inhérentes à son incapacité à initier le processus de réflexion. Un critique de l'article présenté ci-dessous a posé cette question importante : "Quel est le caractère de l'erreur lorsqu'un diagnostic est posé qui n'est pas correct ? Si un patient aux pieds plats n'est tout simplement pas diagnostiqué, il s'agit d'un type d'erreur, mais si la machine affiche "tuberculose respiratoire inactive", c'en est une autre"."

Schwartz WB. Medicine and the computer. The promise and problems of change. N Engl J Med. 1970 Dec 3;283(23):1257-64. doi: 10.1056/NEJM197012032832305. PMID: 4920342.

La médecine et l'ordinateur. La promesse et les problèmes du changement

"Les progrès rapides des sciences de l'information, associés à l'engagement politique en faveur d'une large extension des soins de santé, promettent d'apporter des changements fondamentaux dans la structure de la pratique médicale. L'informatique exercera probablement ses principaux effets en augmentant et, dans certains cas, en remplaçant largement les fonctions intellectuelles du médecin. Comme l'utilisation "intellectuelle" de l'ordinateur influence de façon fondamentale les problèmes de main-d'œuvre médicale et de qualité des soins médicaux, elle entraînera aussi inévitablement des coûts sociaux importants — psychologiques, organisationnels, juridiques, économiques et techniques. Ce n'est qu'en tenant compte de ces coûts potentiels qu'il sera possible d'introduire la nouvelle technologie d'une manière efficace et acceptable. Pour atteindre cet objectif, il faudra de nouvelles interactions entre la médecine,"

L'article du NEJM illustré

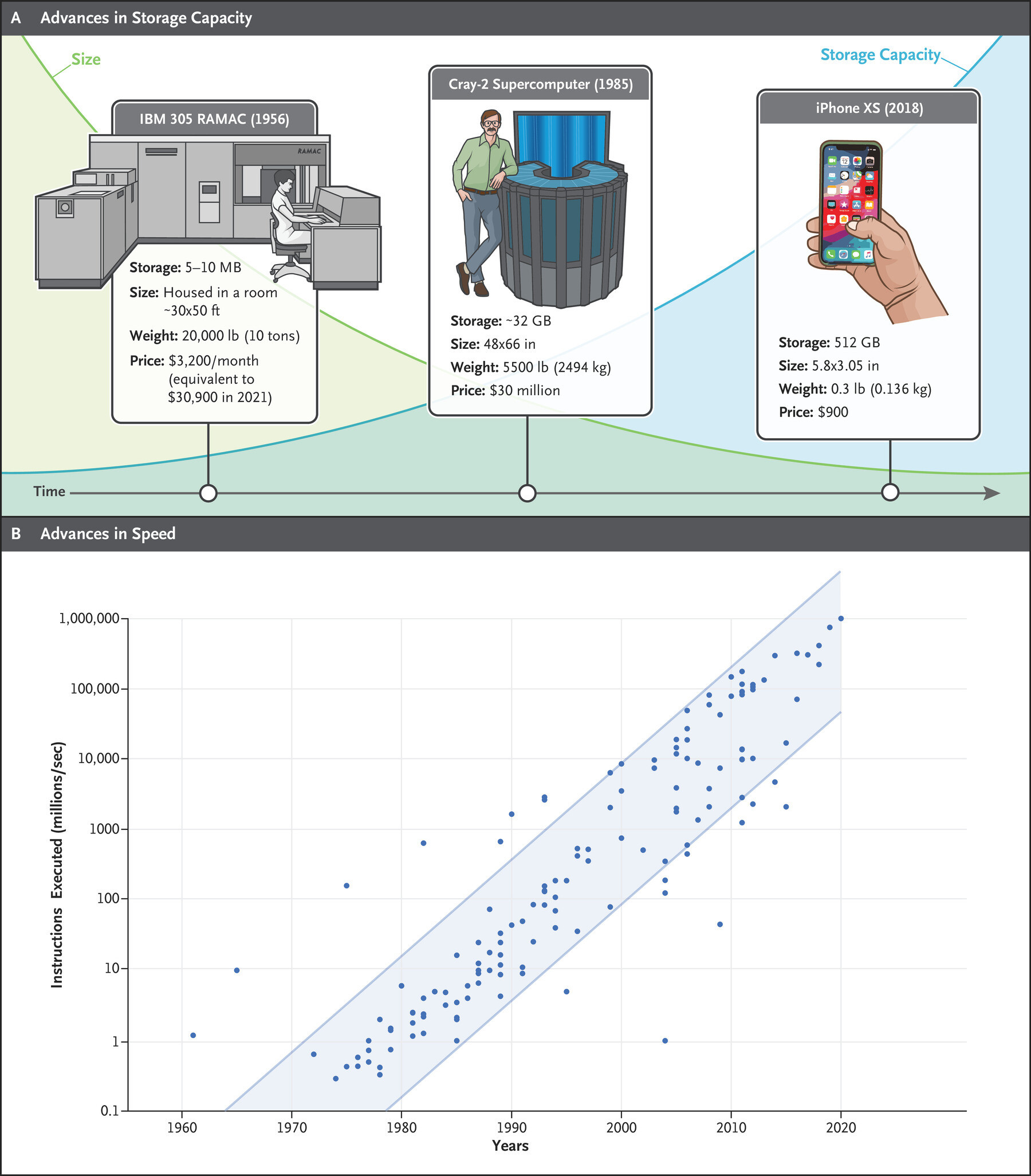

Améliorations sur 50 ans de la capacité des ordinateurs à stocker et traiter les données.

Le panneau A montre les progrès du stockage de données, en termes de taille physique et de coût par unité de stockage. RAMAC désigne la méthode d'accès aléatoire de comptabilité et de contrôle. Le panneau B montre les progrès de la vitesse de calcul. Chaque point représente un type de machine individuel et l'année approximative de son introduction. Ces améliorations du stockage et de la vitesse ont permis à l'apprentissage automatique de passer du rêve à la réalité. Les données des deux panels sont des estimations de nombreux types d'architecture de système et proviennent de plusieurs sources publiques.

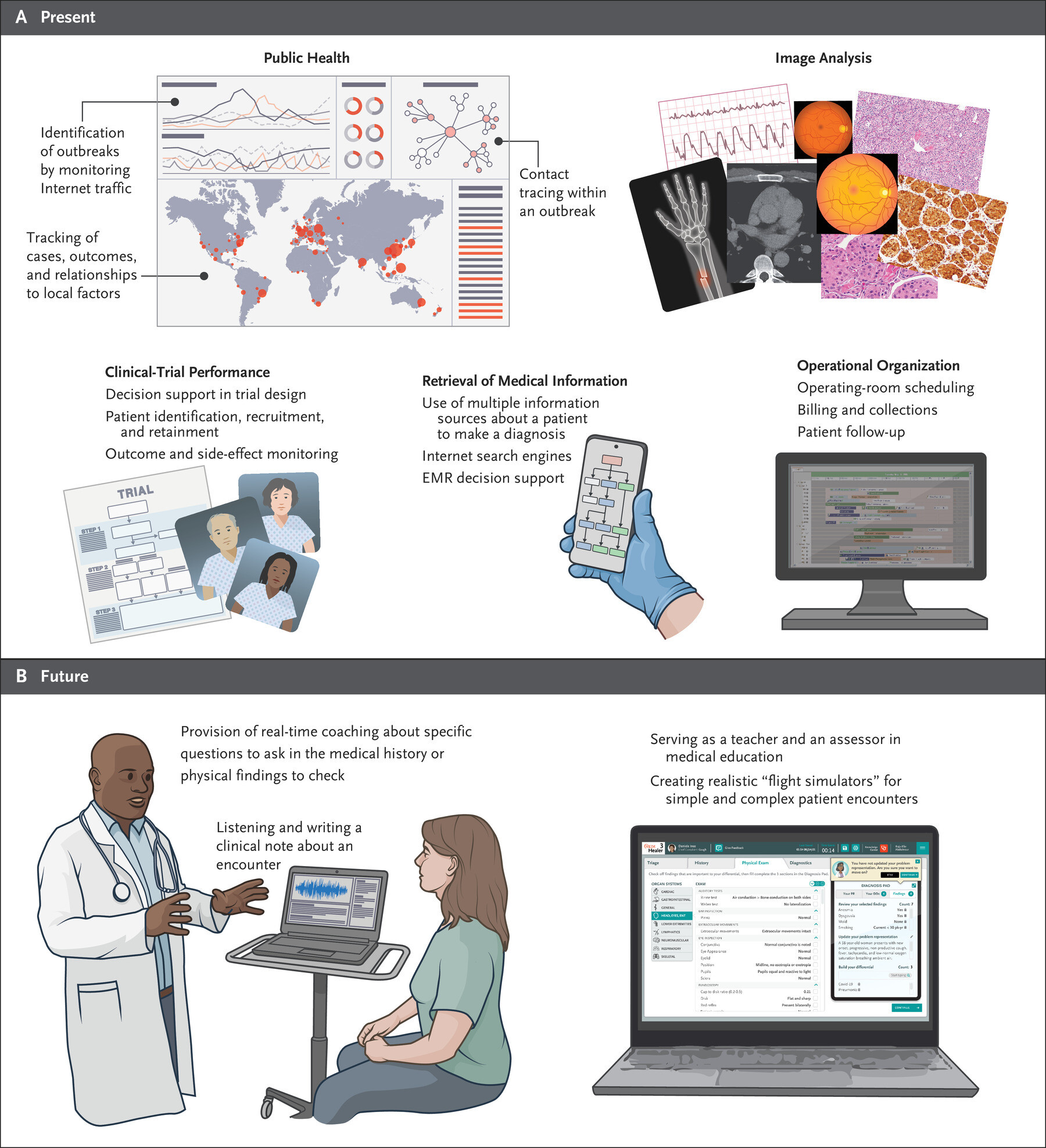

Spectre de l'intelligence artificielle (IA) en médecine.

Le panneau A montre des domaines sélectionnés de la santé publique et de la médecine dans lesquels l'IA a un rôle établi mais en évolution. Ces outils aident déjà les professionnels de la santé à faire leur travail en tant que partenaires dans la pratique. EMR désigne le dossier médical électronique. Le panneau B montre les domaines de la pratique médicale dans lesquels l'IA a commencé à avoir une influence mais n'a pas encore atteint le stade d'utilisation courante.

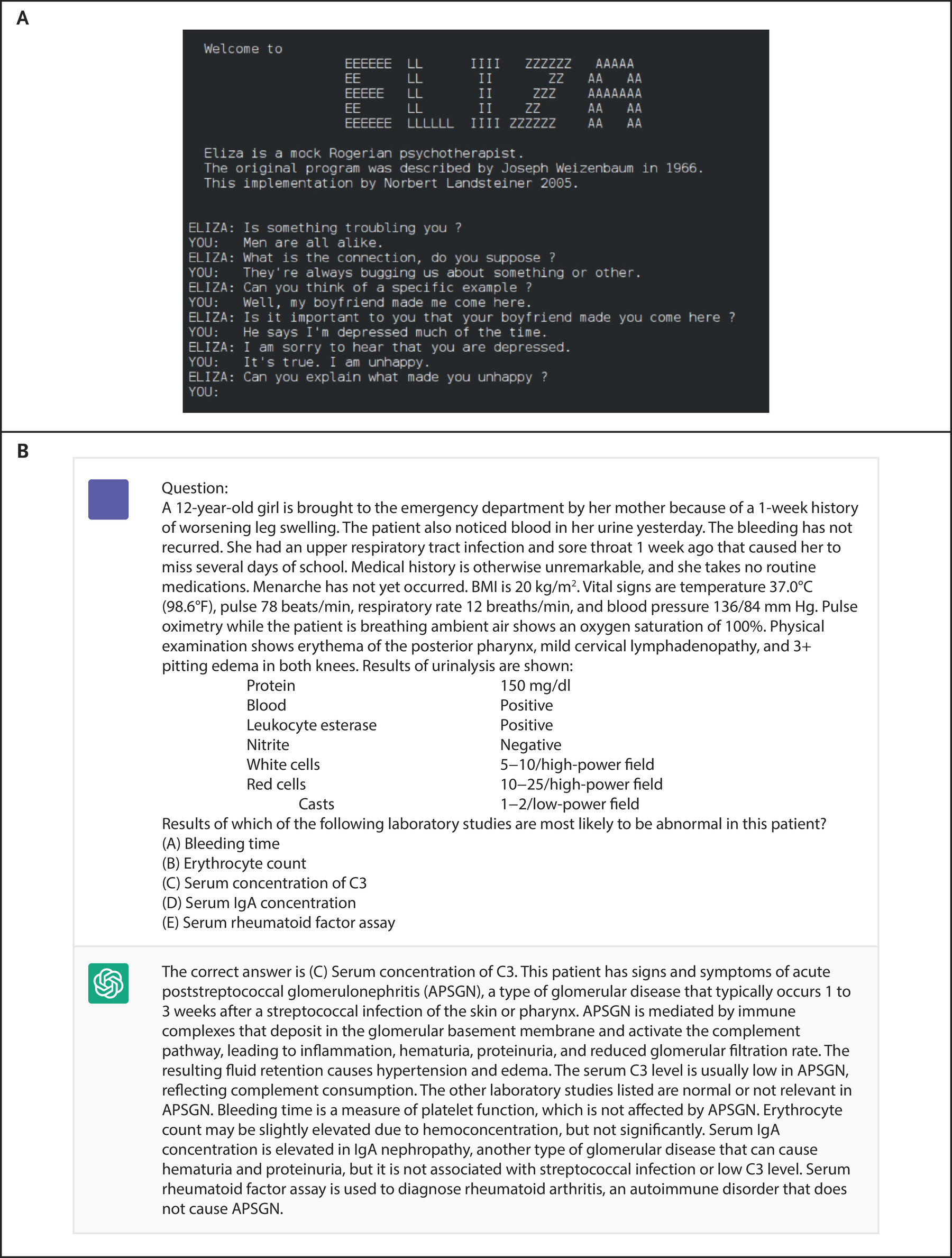

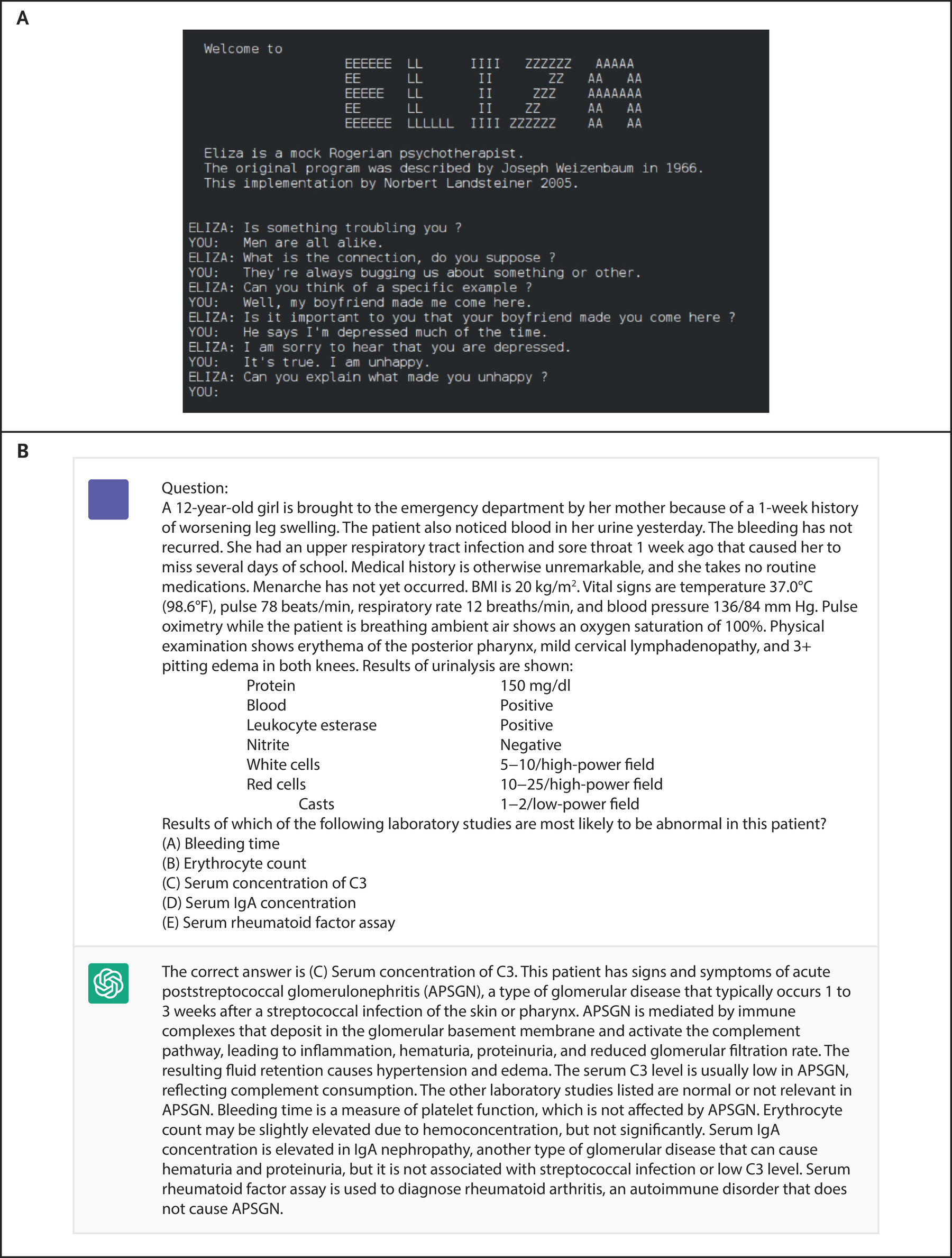

Chatbots en médecine.Le panneau A montre des domaines sélectionnés de la santé publique et de la médecine dans lesquels l'IA a un rôle établi mais en évolution. Ces outils aident déjà les professionnels de la santé à faire leur travail en tant que partenaires dans la pratique. EMR désigne le dossier médical électronique. Le panneau B montre les domaines de la pratique médicale dans lesquels l'IA a commencé à avoir une influence mais n'a pas encore atteint le stade d'utilisation courante.

Le panneau A montre une capture d'écran de la sortie d'un tout premier chatbot médical appelé ELIZA, qui a été développé par Joseph Weizenbaum au laboratoire d'intelligence artificielle du Massachusetts Institute of Technology entre 1964 et 1966. Panneau B (avec la permission de Lee et al. 11 ) montre l'entrée et la sortie du GPT-4, un chatbot qui devrait être introduit en 2023. L'IMC indique l'indice de masse corporelle.

Pour aller plus loin en médecine

Lee P, Bubeck S, Petro J. Benefits, Limits, and Risks of GPT-4 as an AI Chatbot for Medicine. N Engl J Med. 2023 Mar 30;388(13):1233-1239. doi: 10.1056/NEJMsr2214184. PMID: 36988602

https://www.nejm.org/doi/10.1056/NEJMsr2214184?url_ver=Z39.88-2003&rfr_id=ori:rid:crossref.org&rfr_dat=cr_pub%20%200pubmed

Législation européenne, en cours

ChatGPT, un phénomène au fonctionnement encore mal connu

Certes, le fonctionnement de ChatGPT demeure très mal connu, et est sujet à beaucoup de contre-sens : sa seule fonction est en effet de compléter des textes en fonction de son apprentissage, il n’est ni capable de déduction, ni même de vérifier la moindre information par lui-même, simplement de rédiger les suites de mots qui lui semblent le plus probables en fonction d’un contexte."

https://www.rudebaguette.com/2023/02/loi-sur-ia-union-europeenne-reponse-aux-craintes-nees-chatgpt/

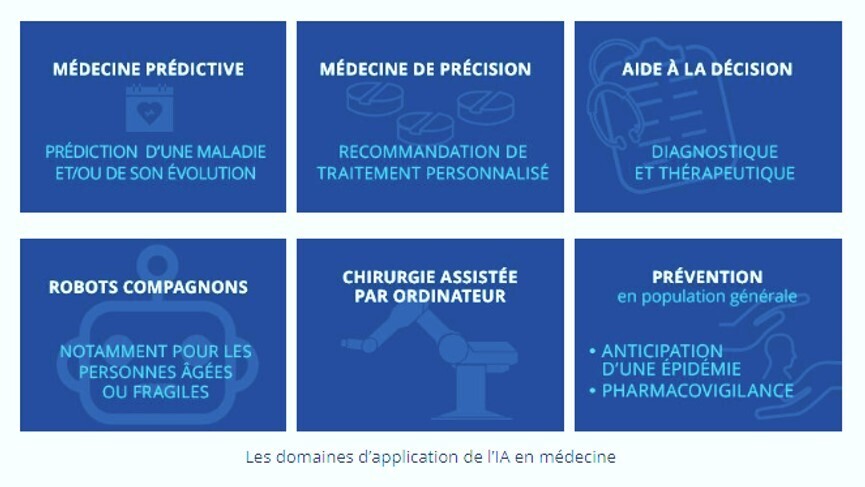

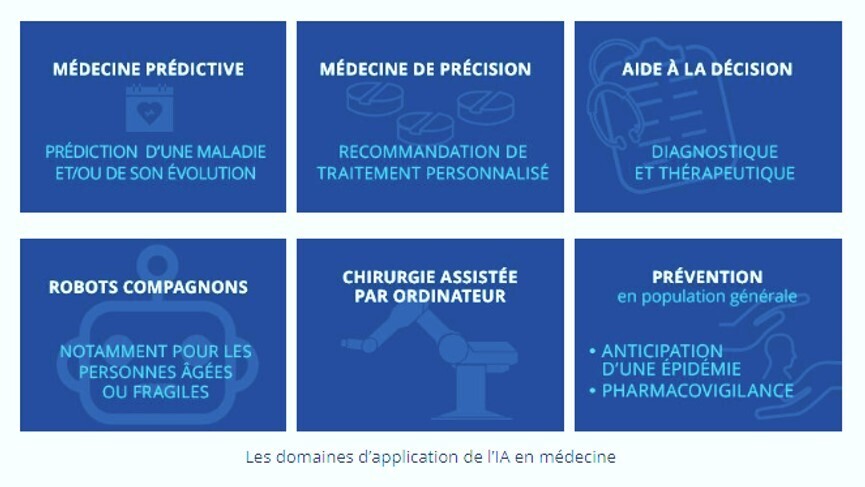

IA en Médecine , données INSERM

https://www.inserm.fr/dossier/intelligence-artificielle-et-sante/

Article très complet à lire ++++

"L’intelligence artificielle (IA) est un domaine de recherche en pleine expansion et promis à un grand avenir. Ses applications, qui concernent toutes les activités humaines, permettent notamment d’améliorer la qualité des soins. L’IA est en effet au cœur de la médecine du futur avec les opérations assistées, le suivi des patients à distance, les prothèses intelligentes, ou encore les traitements personnalisés grâce au recoupement de données (big data)… Dans ce cadre, les chercheurs développent des approches et techniques multiples, du traitement des langues et de la construction d’ontologies, à la fouille de données et à l’apprentissage automatique. Il est toutefois indispensable que le grand public comprenne comment fonctionnent ces systèmes pour savoir ce qu’ils font et surtout ce qu’ils ne font pas. Le robot omniscient, qui pour beaucoup symbolise l’IA, n’est pas pour demain !"

Lee P, Bubeck S, Petro J. Benefits, Limits, and Risks of GPT-4 as an AI Chatbot for Medicine. N Engl J Med. 2023 Mar 30;388(13):1233-1239. doi: 10.1056/NEJMsr2214184. PMID: 36988602

https://www.nejm.org/doi/10.1056/NEJMsr2214184?url_ver=Z39.88-2003&rfr_id=ori:rid:crossref.org&rfr_dat=cr_pub%20%200pubmed

"Bien que nous admettions notre parti pris en tant qu'employés des entités qui ont créé GPT-4, nous prévoyons que les chatbots seront utilisés par les professionnels de la santé, ainsi que par les patients, avec une fréquence croissante. Le point le plus important est peut-être que le GPT-4 n'est pas une fin en soi. C'est l'ouverture d'une porte à de nouvelles possibilités ainsi qu'à de nouveaux risques. Nous supposons que GPT-4 sera bientôt suivi de systèmes d'IA encore plus puissants et capables - une série de machines de plus en plus puissantes et généralement intelligentes. Ces machines sont des outils et, comme tous les outils, elles peuvent être utilisées à bon escient, mais elles ont le potentiel de causer des dommages. "

Législation européenne, en cours

"Le commissaire européen au Marché intérieur Thierry Breton a récemment indiqué que la loi européenne sur l’intelligence artificielle, en cours de finalisation, répondrait aux craintes nées de la démocratisation des chatbots dopés à l’IA comme ChatGPT.

Si le phénomène ChatGPT attise la curiosité, la stupéfaction et la peur devant ses capacités étonnantes, l’outil de complétion de texte d’OpenAI a mis au cœur du débat public les inquiétudes légitimes liées au développement de l’IA.

ChatGPT, un phénomène au fonctionnement encore mal connu

Certes, le fonctionnement de ChatGPT demeure très mal connu, et est sujet à beaucoup de contre-sens : sa seule fonction est en effet de compléter des textes en fonction de son apprentissage, il n’est ni capable de déduction, ni même de vérifier la moindre information par lui-même, simplement de rédiger les suites de mots qui lui semblent le plus probables en fonction d’un contexte."

« Les gens devraient être informés qu’ils ont affaire à un chatbot et non à un être humain. La transparence est également importante au regard du risque de partialité et de fausses informations », ajoute Thierry Breton.

"Comment « garantir une IA digne de confiance basée sur des données de haute qualité » ?

Mais c’est sans doute sur la fin de la déclaration de Thierry Breton qu’il faut chercher la grande question de fond : « c’est pourquoi nous avons besoin d’un cadre réglementaire solide pour garantir une IA digne de confiance basée sur des données de haute qualité », déclare-t-il.

Mais c’est sans doute sur la fin de la déclaration de Thierry Breton qu’il faut chercher la grande question de fond : « c’est pourquoi nous avons besoin d’un cadre réglementaire solide pour garantir une IA digne de confiance basée sur des données de haute qualité », déclare-t-il.

"Car oui, les capacités d’une IA dépendent exclusivement de son apprentissage. Dans le cas d’un agent conversationnel, ses orientations idéologiques, politiques et morales dépendent ainsi presque exclusivement de la méthode d’apprentissage (les données et l’accompagnement humain pour orienter le point de vue à avoir sur ces données)."

https://www.rudebaguette.com/2023/02/loi-sur-ia-union-europeenne-reponse-aux-craintes-nees-chatgpt/

IA en Médecine , données INSERM

https://www.inserm.fr/dossier/intelligence-artificielle-et-sante/

Article très complet à lire ++++

"L’intelligence artificielle (IA) est un domaine de recherche en pleine expansion et promis à un grand avenir. Ses applications, qui concernent toutes les activités humaines, permettent notamment d’améliorer la qualité des soins. L’IA est en effet au cœur de la médecine du futur avec les opérations assistées, le suivi des patients à distance, les prothèses intelligentes, ou encore les traitements personnalisés grâce au recoupement de données (big data)… Dans ce cadre, les chercheurs développent des approches et techniques multiples, du traitement des langues et de la construction d’ontologies, à la fouille de données et à l’apprentissage automatique. Il est toutefois indispensable que le grand public comprenne comment fonctionnent ces systèmes pour savoir ce qu’ils font et surtout ce qu’ils ne font pas. Le robot omniscient, qui pour beaucoup symbolise l’IA, n’est pas pour demain !"

"Aider le médecin et non le remplacer

Certains voient dans les applications médicales de l’IA la possibilité de remplacer le médecin, que ce soit pour pallier les déserts médicaux ou bien pour filtrer les patients et les orienter. Mais l’utilisation par le public de ces logiciels sans supervision médicale soulève des questions éthiques importantes. Le système réduit la relation au médecin à un acte technique. Il laisse le patient à ses interrogations et ses angoisses.

Certains voient dans les applications médicales de l’IA la possibilité de remplacer le médecin, que ce soit pour pallier les déserts médicaux ou bien pour filtrer les patients et les orienter. Mais l’utilisation par le public de ces logiciels sans supervision médicale soulève des questions éthiques importantes. Le système réduit la relation au médecin à un acte technique. Il laisse le patient à ses interrogations et ses angoisses.

Par ailleurs, le risque que le médecin abdique devant la machine « qui sait mieux que lui » est réel. Il peut être amené à endosser une décision qui n’est pas la sienne et découvrir après coup que la machine s’est trompée. Pour éviter cet écueil, le médecin, seul habilité à porter un diagnostic, doit pouvoir garder son autonomie face à la machine. Il doit être en mesure de comprendre le pourquoi et le comment des décisions affichées, et de les contourner si besoin.

Dans cet objectif la commission de réflexion sur l’éthique de la recherche en sciences et technologie du numérique d’Allistene (Cerna) a souligné la nécessité de concevoir des systèmes dont le fonctionnement est transparent, explicité et traçable, et qui effectuent les tâches spécifiées en respectant des contraintes explicites. Cette initiative est englobée maintenant au niveau international par l’UNESCO. Pour des systèmes d’aide à la décision fondés sur des algorithmes d’apprentissage, le respect de ces conformités n’est pas évident "

Les questions éthiques soulevée par l’intelligence artificielle

https://www.frm.org/recherches-financees/intelligence-artificielle/tout-savoir-ia#applications

Si l’on délègue à des machines des décisions habituellement prises par des médecins, ces derniers ne vont-ils pas perdre leurs compétences ? À cette question, le Comité consultatif national d’éthique (CCNE) a répondu en novembre 2018 : « Une place trop grande accordée à ces systèmes risquerait de déshumaniser la médecine. La relation entre personnel soignant et patient reste primordiale. L’homme “doit garder la main“, le contrôle, la décision finale. » Un avis partagé par le Conseil de l’Europe et l’Académie de médecine américaine dans des rapports publiés en 2020.

Commentaire

L'IA s'est démocratisée récemment avec OPEN/AI.

Est ce une révolution ? Non

Les questions éthiques soulevée par l’intelligence artificielle

https://www.frm.org/recherches-financees/intelligence-artificielle/tout-savoir-ia#applications

Si l’on délègue à des machines des décisions habituellement prises par des médecins, ces derniers ne vont-ils pas perdre leurs compétences ? À cette question, le Comité consultatif national d’éthique (CCNE) a répondu en novembre 2018 : « Une place trop grande accordée à ces systèmes risquerait de déshumaniser la médecine. La relation entre personnel soignant et patient reste primordiale. L’homme “doit garder la main“, le contrôle, la décision finale. » Un avis partagé par le Conseil de l’Europe et l’Académie de médecine américaine dans des rapports publiés en 2020.

Autres questionnements éthiques soulevés par le CCNE : « Comment s’assurer, en face de systèmes aussi complexes, que le patient donne un consentement éclairé à leur usage ? Qui est responsable en cas d’erreur ou de dérèglement de la machine ? La gestion des données massivement collectées par ces systèmes inquiète : que deviennent-elles et que reste-t-il du secret médical ? » Face à ces questions, sur lesquelles travaillent déjà de nombreux experts, les sages du CCNE insistent surtout sur le fait que « le risque principal serait de ne pas avoir suffisamment recours à l’IA, explique David Gruson, co-directeur du groupe de travail du CCNE. Nous avons beaucoup de données de santé en France, il ne faudrait pas les sous-exploiter. »

Enfin, la formation des médecins et soignants à ces outils ainsi que l’information des patients restent des sujets capitaux au cœur du développement de l’IA médicale.

Commentaire

L'IA s'est démocratisée récemment avec OPEN/AI.

Est ce une révolution ? Non

Est ce un e évolution de nos connaissances ? Oui

Est ce la solution aux manques de médecins ? Non

Est ce que les patients bénéficieront de l'IA ? Oui, par une médecine de précision, une médecine "sur mesure". Mais attention l'irruption de l'IA en médecine ne doit pas transformer la médecine en médecine des riches et médecin des pauvres.

L'accessibilté à l'IA devra être universelle, elle soit en médecine devenir un nouvel enjeu de Santé Publique

Non les diagnostics de demain en médecine ne seront pas "robotisés" .

Oui les algorithme en médecine seront plus précis et plus efficaces, la médecine prédictive sera enfin une réalité. Par exemple la prédiction du risque hémorragique, la prédiction du risque de récidive de MTEV seront augmentés. Les interactions médicamenteuses seront plus facilement repérés. Les robots assisteront les chirurgiens, les radiologues pour des tâches spécifiques. L'évaluation du risque CV primaire sera grandement facilités. Les patients auront accès à des chatbots construits à partir de sites médicaux fiables ce qui leur permettra ainsi d'obtenir des renseignements fiables. Enfin des procédures de dépistage seront amplifiés par une meilleur sélection des patients.

L'IA decra être encadrée afin d'éviter tout dérapage , les fake news etc. L'IA devra être maîtrisée.

A lire : https://www.ncbi.nlm.nih.gov/pmc/articles/PMC5210443/

In fine l'IA en médecine devra aider les médecins à mieux diagnostiquer, mieux soigner et mieux anticiper les risques.

Le patient doit rester au centre de nos préoccupations, ce ne devra pas être le cas de l'IA.

Terminons par lea "dernière " d'Elon Musk : le moratoire sur l'IA

Article à lire, le chantre de l'IA (NEURALYNK, voitrures autonomes, conquête de l'espacve)

Est ce la solution aux manques de médecins ? Non

Est ce que les patients bénéficieront de l'IA ? Oui, par une médecine de précision, une médecine "sur mesure". Mais attention l'irruption de l'IA en médecine ne doit pas transformer la médecine en médecine des riches et médecin des pauvres.

L'accessibilté à l'IA devra être universelle, elle soit en médecine devenir un nouvel enjeu de Santé Publique

Non les diagnostics de demain en médecine ne seront pas "robotisés" .

Oui les algorithme en médecine seront plus précis et plus efficaces, la médecine prédictive sera enfin une réalité. Par exemple la prédiction du risque hémorragique, la prédiction du risque de récidive de MTEV seront augmentés. Les interactions médicamenteuses seront plus facilement repérés. Les robots assisteront les chirurgiens, les radiologues pour des tâches spécifiques. L'évaluation du risque CV primaire sera grandement facilités. Les patients auront accès à des chatbots construits à partir de sites médicaux fiables ce qui leur permettra ainsi d'obtenir des renseignements fiables. Enfin des procédures de dépistage seront amplifiés par une meilleur sélection des patients.

L'IA decra être encadrée afin d'éviter tout dérapage , les fake news etc. L'IA devra être maîtrisée.

A lire : https://www.ncbi.nlm.nih.gov/pmc/articles/PMC5210443/

In fine l'IA en médecine devra aider les médecins à mieux diagnostiquer, mieux soigner et mieux anticiper les risques.

Le patient doit rester au centre de nos préoccupations, ce ne devra pas être le cas de l'IA.

Terminons par lea "dernière " d'Elon Musk : le moratoire sur l'IA

Article à lire, le chantre de l'IA (NEURALYNK, voitrures autonomes, conquête de l'espacve)

Extrait "Pour ce qui concerne les véritables problèmes actuels, il est bien entendu frivole de demander un quelconque moratoire. Pourtant la désinformation exige déjà, les jobs sont déjà supplantés par des algorithmes pourris et incontrôlables, notre «civilisation» est déjà menacée par des idéologues narcissiques, la richesse est déjà concentrée entre les mains d’une minorité irresponsable aux idées creuses, la démocratie est déjà soumise aux lubies d’une clique qui lui doit tout et ne lui rend rien.

Position de l'Europe : https://www.bfmtv.com/tech/intelligence-artificielle/ce-que-prevoit-le-parlement-europeen-pour-encadrer-chat-gpt-et-l-intelligence-artificielle_AV-202303150315.html

"Le degré d'intelligence dont un homme ou une machine peut faire preuve dépend de nombreuses qualités de la manière dont les connaissances, les objectifs et les techniques de résolution de problèmes sont représentés et assemblés, et non pas tant des détails fins. " Marvin Minski

Mais non, le vrai danger, c’est que leurs robots arrivent, et que nous n’avons pas encore de «lois de la robotique». Laissez-leur six mois, et le futur de l’humanité sera assuré... Peut-être devrions-nous rebondir sur cette idée, et exiger un moratoire définitif sur le techno-bullshit des fossoyeurs de notre présent."

https://www.heidi.news/cyber/moratoire-sur-les-ia-arretons-plutot-le-techno-bullshit-pour-toujoursPosition de l'Europe : https://www.bfmtv.com/tech/intelligence-artificielle/ce-que-prevoit-le-parlement-europeen-pour-encadrer-chat-gpt-et-l-intelligence-artificielle_AV-202303150315.html

"Le règlement prévoit d’encadrer des systèmes dits "à haut risque", tels que ChatGPT, ou sa nouvelle version encore plus performante GPT-4. Il est également question de modèles d’intelligence artificielle utilisés dans la reconnaissance faciale, ou encore dans les transports et l’éducation.

Dans cette première version du texte de compromis, les utilisateurs, les importateurs, les distributeurs mais aussi les parties tierces seront considérés comme des fournisseurs d’intelligence artificielle à haut risque

Afin de sécuriser au maximum leur usage, les intelligences artificielles devraient faire face à des essais préalables à leur mise sur le marché. L’Europe insiste sur le besoin d'identifier les potentiels risques d’un système et d’assurer une bonne gestion des données."

Une novelle affaire à suivre

"Le degré d'intelligence dont un homme ou une machine peut faire preuve dépend de nombreuses qualités de la manière dont les connaissances, les objectifs et les techniques de résolution de problèmes sont représentés et assemblés, et non pas tant des détails fins. " Marvin Minski